Per molto tempo, l’intelligenza artificiale per i viaggi è sembrata più un concetto futuro che una necessità del presente. Questo è cambiato. Oggi rappresenta un aggiornamento architetturale critico—uno che è essenziale per la sopravvivenza e la crescita.

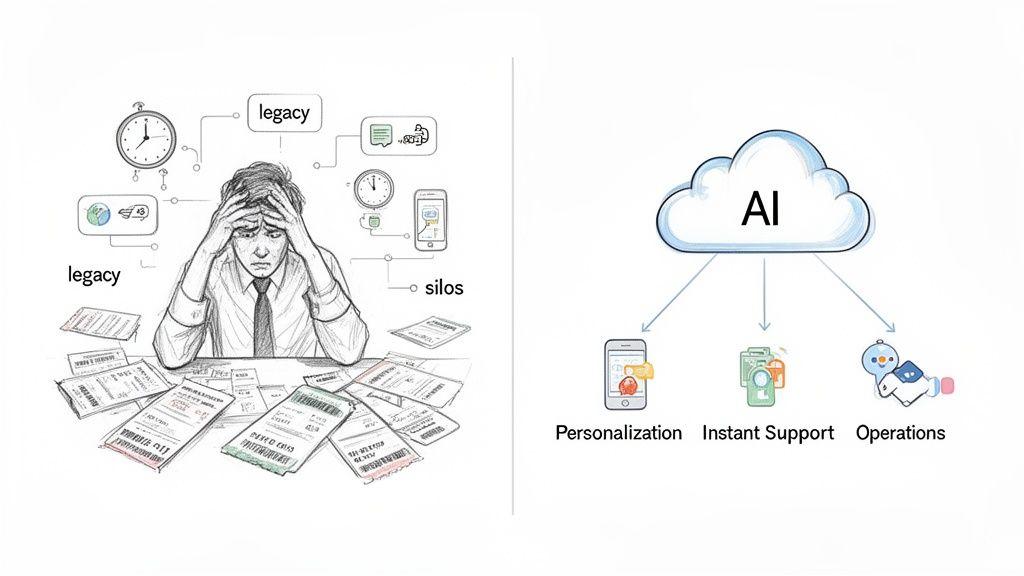

Per i leader tecnici, non si tratta solo di aggiungere una nuova funzionalità. Si tratta di ripensare in modo fondamentale come i servizi di viaggio vengono progettati e distribuiti per risolvere i problemi centrali del settore: sovraccarico di dati, esperienze utente frammentate e un’enorme pressione operativa che i sistemi legacy semplicemente non riescono più a gestire.

Il problema: sistemi legacy contro le esigenze moderne del travel

Il settore dei viaggi opera su una base di complessità enorme e incessante. I sistemi tecnici devono destreggiarsi tra dataset vastissimi e volatili—orari dei voli, disponibilità degli hotel, prezzi che cambiano di secondo in secondo e un flusso costante di preferenze degli utenti. Tutto questo avviene sullo sfondo di margini sottilissimi e di una concorrenza feroce.

L’approccio tradizionale, con sistemi legacy rigidi e a silos, non è più sostenibile. Questi sistemi non sono mai stati progettati per il servizio in tempo reale, iper-personalizzato, che i viaggiatori moderni si aspettano.

Questo divario architetturale crea sfide di business significative che incidono direttamente su fatturato ed efficienza operativa. Per founder e CTO, il problema non è la mancanza di dati; è l’incapacità di elaborarli e agire su di essi in tempo reale. Questo porta direttamente a opportunità di ricavo mancate, esperienze cliente scadenti e costi operativi gonfiati.

Principali driver di business per l’adozione dell’AI

L’intelligenza artificiale offre un pattern architetturale pragmatico per elaborare informazioni e automatizzare decisioni su larga scala. Adottarla non è una questione di hype; è una risposta diretta a pressioni di business concrete.

- Sovraccarico operativo: I processi manuali per il supporto clienti, la gestione delle disruption (come la riprenotazione dei passeggeri dopo una cancellazione) e la pianificazione delle risorse sono lenti, costosi e soggetti a errori. L’automazione guidata dall’AI esegue questi compiti su larga scala, 24/7, con elevata affidabilità.

- La domanda di vera personalizzazione: Le offerte generiche non sono sufficienti. I viaggiatori oggi si aspettano servizi che comprendano le loro esigenze specifiche—from restrizioni alimentari su un volo ai requisiti di accessibilità in un hotel—e che costruiscano itinerari che riflettano tale comprensione. La segmentazione ingenua non soddisfa più le aspettative degli utenti.

- Necessità competitiva: I concorrenti più agili stanno già usando l’AI per ottimizzare i prezzi, migliorare il coinvolgimento degli utenti e snellire le operazioni. In un mercato in cui l’efficienza è un motore primario della redditività, la stagnazione architetturale significa perdere terreno.

I dati di mercato confermano questo cambiamento. Per esempio, una maggioranza significativa di viaggiatori utilizza ormai l’AI per pianificare i viaggi, con un aumento drastico rispetto a pochi anni fa. Questa tendenza è particolarmente forte tra le fasce più giovani, con report del 2026 che mostrano che una larga percentuale di millennial e Gen Z sfrutta l’AI generativa per la scoperta di viaggi. Puoi esplorare i dati di base su piattaforme come Statista.com.

Costruire con l’intelligenza artificiale per i viaggi non significa aggiungere una funzionalità “smart”. È una decisione strategica per ristrutturare i sistemi in chiave di agilità, efficienza e un’esperienza cliente profondamente migliore—trattando privacy e affidabilità come scelte architetturali, non come ripensamenti successivi.

Comprendere la strategia ad alto livello è il primo passo. Tuttavia, il vero valore dell’intelligenza artificiale per i viaggi si realizza non nelle presentazioni, ma nelle applicazioni specifiche e pratiche che risolvono problemi operativi del mondo reale.

Per un leader tecnico, questo significa andare oltre termini generici come “chatbot” per identificare casi d’uso ad alto impatto che correggono un processo guasto o sbloccano nuovo fatturato. Non si tratta di concetti speculativi; sono soluzioni pragmatiche che si stanno costruendo ora e che offrono un ritorno sull’investimento misurabile.

Casi d’uso pragmatici dell’AI per il settore travel

Prezzi dinamici e ottimizzazione dei ricavi

Il problema: I sistemi di pricing statici, basati su regole, non riescono a tenere il passo con le dinamiche di mercato in tempo reale. Non considerano improvvisi picchi di domanda, le azioni dei concorrenti o gli eventi locali, con conseguente perdita di ricavi—sia perché i prezzi sono troppo bassi quando la domanda è alta, sia perché sono troppo alti durante un rallentamento.

La soluzione: Un motore di pricing dinamico basato su modelli di machine learning offre un approccio proattivo. Ingerisce e analizza un flusso continuo di dati per ottimizzare la strategia di pricing.

- Segnali di input: Il motore elabora i prezzi dei concorrenti, i pattern storici di prenotazione, la disponibilità di voli e hotel, i calendari degli eventi locali e gli indicatori macroeconomici.

- Output predittivo: Prevede la domanda e raccomanda i punti prezzo ottimali per voli, camere d’albergo o auto a noleggio per massimizzare sia i ricavi sia il tasso di occupazione.

Questo rappresenta un cambiamento fondamentale: dal reagire al mercato al modellare in modo proattivo la strategia dei ricavi sulla base dell’analisi predittiva dei dati.

Personalizzazione avanzata con gli embedding

Il problema: Raccomandazioni generiche come “chi ha prenotato questo ha prenotato anche…” sono obsolete e inefficaci. La sfida è andare oltre la segmentazione grossolana verso una vera iper-personalizzazione che comprenda l’intento sfumato di ciascun viaggiatore. Un approccio superficiale è una delle principali ragioni per cui molti progetti di personalizzazione AI falliscono, un tema che analizziamo nella nostra guida su AI nel settore retail.

La soluzione: Il principale abilitatore tecnico sono gli embedding. Un embedding è un vettore (un elenco di numeri) che rappresenta un’entità complessa come la cronologia di viaggio di un utente, i servizi di un hotel o le recensioni di una destinazione. Convertendo elementi eterogenei in uno spazio matematico condiviso, è possibile calcolare la “distanza” o la similarità semantica tra di essi.

Per esempio, un utente che prenota costantemente boutique hotel con servizi specifici e visita città note per la loro scena artistica ha un vettore di profilo distinto. Un sistema basato su embedding può associare questo vettore ai vettori di destinazioni ancora inesplorate o di nuovi hotel che condividono esattamente quelle caratteristiche latenti. Questo va oltre la corrispondenza per parole chiave e cattura l’essenza semantica delle preferenze di un viaggiatore, abilitando raccomandazioni uniche e approfondite.

Workflow agentici per l’automazione operativa

Il problema: Molti compiti operativi critici nel travel sono processi complessi e multi-step eseguiti manualmente. Si pensi a un agente di viaggio aziendale che prenota un viaggio con specifici vincoli di compliance, o a un dipendente di una compagnia aerea che riprenota centinaia di passeggeri dopo la cancellazione di un volo. Questi workflow sono lenti, costosi e terreno fertile per errori umani costosi.

La soluzione: Un’AI agentica offre un potente pattern architetturale per l’automazione. Un agente AI è un sistema autonomo in grado di eseguire azioni per raggiungere un obiettivo. Utilizzando una capacità nota come tool calling, l’agente può interagire con altri sistemi interni ed esterni tramite API per:

- Interrogare la disponibilità dei voli in tempo reale.

- Verificare il sistema di prenotazione di un hotel.

- Controllare lo status loyalty di un cliente.

- Inviare una richiesta a un fornitore di servizi terzo.

Concatenando queste azioni, un agente può automatizzare un intero workflow, come trovare e prenotare un volo alternativo, riservare un hotel e notificare il passeggero—tutto senza intervento umano. Questo offre un’efficienza operativa significativa e libera gli esperti umani per gestire i veri casi limite.

Pattern architetturali fondamentali per l’integrazione dell’AI

Implementare l’AI in un’azienda travel richiede un approccio architetturale deliberato. Collegarsi semplicemente a un’API di Large Language Model (LLM) senza un piano solido porta a sistemi inaffidabili, insicuri e proibitivamente costosi.

Il valore sta nella scelta del pattern architetturale giusto per il giusto problema di business. Questo implica progettare un sistema resiliente che orchestri LLM, dati proprietari, API esterne e interfaccia utente in un insieme coerente e gestibile. Fallire in questo è una delle ragioni principali per cui molti piloti AI non arrivano mai in produzione.

Alimentare i chatbot con Retrieval-Augmented Generation (RAG)

Il problema: Un LLM standard, pronto all’uso, non conosce le operazioni specifiche della tua azienda. Non può rispondere a domande sulla policy pet-friendly del tuo hotel o sulle regole di cancellazione dei voli. Senza grounding, è incline a “hallucination”—inventare informazioni plausibili ma errate.

La soluzione: Retrieval-Augmented Generation (RAG) è il pattern architetturale essenziale che ancora un LLM ai dati proprietari della tua azienda, garantendo accuratezza fattuale.

RAG è un sistema progettato per iniettare contesto rilevante e in tempo reale nel prompt di un LLM prima che generi una risposta. Trasforma un modello generico in un esperto aziendale competente.

L’implementazione prevede un processo chiaro, articolato in più fasi:

- Ingestione dei dati: I documenti proprietari (PDF di policy, articoli della knowledge base, regole di prenotazione) vengono raccolti, segmentati in blocchi di testo più piccoli ed elaborati.

- Vettorizzazione: Ogni blocco viene convertito in un embedding numerico e memorizzato in un database vettoriale specializzato, ottimizzato per la ricerca semantica.

- Recupero in tempo reale: Quando un utente pone una domanda (ad es. “Qual è la tariffa per un bagaglio extra?”), la query viene convertita in un vettore. Il sistema cerca quindi nel database vettoriale i blocchi di testo semanticamente più rilevanti dai tuoi documenti.

- Prompting aumentato: Questi blocchi recuperati vengono iniettati nel prompt insieme alla domanda originale. L’istruzione all’LLM è, in pratica: “Usando solo queste informazioni fornite, rispondi alla domanda dell’utente.”

Questo pattern è fondamentale per costruire assistenti affidabili rivolti al cliente, ma richiede un’ingegneria accurata per mantenere la freschezza dei dati, garantire l’accuratezza del retrieval e gestire i costi degli embedding e delle chiamate API.

Workflow agentici con tool calling

Il problema: Rispondere alle domande non è sufficiente per attività complesse come prenotare un viaggio multi-tratta o riprenotare un volo cancellato. Questi processi richiedono che l’AI agisca, interagisca con altri sistemi e prenda decisioni sequenziali.

La soluzione: I workflow agentici che sfruttano il tool calling sono progettati per questo scopo. Un agente AI viene ingegnerizzato per raggiungere un obiettivo eseguendo una sequenza di azioni. Gli viene dato accesso a un insieme predefinito di “tool”, che sono funzioni che interfacciamo con le tue API interne o esterne.

Considera una richiesta dell’utente: “Trova e prenota un hotel pet-friendly a Londra per il prossimo weekend sotto le £200.” Un agente AI scomporrebbe questo compito:

- Tool 1 (Search API): Chiamare l’API interna di ricerca hotel con i parametri

city=London,dates=next_weekendepet_friendly=true. - Tool 2 (Logica di filtro): Elaborare la risposta dell’API, escludendo le opzioni che superano il vincolo di prezzo di £200.

- Tool 3 (Booking API): Dopo la conferma dell’utente, chiamare l’API di prenotazione con l’ID corretto dell’hotel e i dettagli della prenotazione per completare la transazione.

Costruire un agente affidabile è un’impresa architetturale significativa. Richiede una gestione robusta degli errori, guardrail di sicurezza per prevenire azioni indesiderate e un’osservabilità completa. Un agente implementato male potrebbe prenotare una camera due volte o fallire silenziosamente, creando una grave interruzione del servizio. La chiave è progettare agenti che siano verificabili e che mantengano un human-in-the-loop per l’approvazione finale delle azioni critiche.

Pattern di integrazione dell’AI: panoramica comparativa

| Pattern di integrazione | Caso d’uso primario | Componenti chiave | Trade-off di implementazione |

|---|---|---|---|

| Chiamata LLM Semplice | Generazione di contenuti creativi, sintesi di testi, classificazione semplice. | API LLM (ad esempio, OpenAI, Anthropic), modelli di prompt. | Pro: Semplice, rapida da prototipare. Contro: Nessun accesso ai dati privati, soggetta a allucinazioni, manca il contesto in tempo reale. |

| Generazione Aumentata dal Recupero (RAG) | Q&A fattuali, chatbot per l’assistenza clienti, ricerca nella knowledge base interna. | API LLM, database vettoriale (ad esempio, Pinecone, Chroma), modello di embedding, pipeline di ingestione dei dati. | Pro: Basata sui fatti, riduce le allucinazioni, può usare dati proprietari. Contro: Più complessa, richiede gestione della pipeline dei dati, la qualità del recupero è critica. |

| Workflow Agentico (Chiamata di Strumenti) | Attività complesse in più passaggi come prenotazioni, pianificazione di viaggi e gestione delle prenotazioni. | LLM con capacità di chiamata di strumenti, un insieme di “strumenti” definiti (funzioni API), gestore di stato, logica di pianificazione/ragionamento. | Pro: Può eseguire azioni e interagire con sistemi esterni. Contro: Alta complessità, rischi di sicurezza significativi, richiede una gestione robusta degli errori e guardrail. |

| Fine-Tuning | Attività specializzate che richiedono uno stile, un tono o un formato specifico difficile da ottenere solo con il prompting. | Modello base, dataset di training curato, infrastruttura di training. | Pro: Comportamento del modello altamente specializzato. Contro: Costoso, richiede molto tempo, necessita di un grande dataset di alta qualità e comporta il rischio di “catastrophic forgetting”. |

Scegliere il pattern giusto implica allineare la complessità della soluzione con la complessità del problema. Una semplice chiamata LLM è sufficiente per sintetizzare le recensioni degli hotel, ma useresti un workflow agentico per la riprenotazione di un volo. RAG è ideale per un bot di help desk, ma un agente è necessario per un pianificatore di viaggi a servizio completo. Una chiara comprensione di questi pattern garantisce la costruzione di un sistema potente, affidabile e sicuro.

La roadmap di un CTO: dal concetto di AI alla produzione

Portare un progetto di AI per i viaggi dal concetto a un sistema di produzione affidabile richiede un approccio strutturato e incrementale. Inseguire il modello più recente o tentare un lancio “big bang” è un anti-pattern comune che porta a scope creep, sforamenti di budget e debito tecnico.

Questa roadmap in cinque fasi è pensata per i leader tecnici responsabili della costruzione e dell’esercizio di sistemi software reali. Si concentra sulla fornitura di valore tangibile, gestendo al contempo il rischio in ogni fase.

Fase 1: Discovery e definizione dell’ambito

Il primo passo è identificare un progetto pilota ad alto valore e basso rischio che risolva un reale problema di business. Evita di costruire per il gusto della tecnologia. Un pilota di successo crea slancio e ottiene il consenso degli stakeholder per progetti futuri, più ambiziosi.

Concentrati su un processo attualmente manuale, ripetitivo e costoso. Tra i candidati più validi ci sono:

- Automatizzare le risposte alle 10 domande di assistenza clienti più frequenti.

- Classificare le recensioni degli ospiti in arrivo per identificare problemi di servizio ricorrenti.

- Generare bozze iniziali di descrizioni delle destinazioni per contenuti di marketing.

Definisci metriche di successo chiare, come ridurre del 20% il tempo medio di risposta degli operatori o abbattere i costi di creazione dei contenuti. Per la prima iterazione, evita integrazioni complesse tra più sistemi che aumentano il rischio.

Fase 2: Progettazione architetturale pragmatica

Con un ambito ben definito, puoi progettare un’architettura pragmatica. Ciò significa selezionare i modelli e gli strumenti giusti per il lavoro, senza sovra-progettare per un futuro ipotetico.

La decisione di usare un’API proprietaria rispetto a un modello open source dovrebbe basarsi su un’analisi chiara di prestazioni, costi e controllo. Un confronto dettagliato tra deployment on-premises e cloud può fornire contesto per questa scelta infrastrutturale. Per molte attività, un modello più piccolo e veloce è più conveniente e offre qualità sufficiente. Progetta per la modularità per consentire in seguito la sostituzione di modelli o fonti di dati senza una riscrittura completa del sistema.

Fase 3: Delivery incrementale e test

Adotta un modello di delivery agile basato su sprint. Costruisci e testa il sistema in piccoli incrementi misurabili. Ogni sprint dovrebbe consegnare un componente funzionale che possa essere validato con dati reali e, idealmente, con un piccolo gruppo di utenti.

Ad esempio, nella costruzione di un chatbot basato su RAG, il primo sprint potrebbe concentrarsi solo sulla pipeline di ingestione dei dati. Il successivo potrebbe realizzare il meccanismo di retrieval, e un terzo potrebbe integrare l’LLM. Questo processo iterativo ti permette di individuare precocemente difetti architetturali e colli di bottiglia nelle prestazioni, quando sono meno costosi da correggere.

Fase 4: Integrazione Human-in-the-Loop (HITL)

Per qualsiasi processo con conseguenze nel mondo reale—come prenotare un volo non rimborsabile o gestire un reclamo sensibile di un cliente—un design human-in-the-loop (HITL) è imprescindibile. Questo è un principio fondamentale dell’ingegneria AI responsabile.

Un sistema HITL è progettato per consentire a esperti umani di convalidare, sovrascrivere o correggere le decisioni generate dall’AI prima che diventino definitive. Ciò crea una rete di sicurezza critica, riduce il rischio operativo e fornisce un prezioso meccanismo di feedback per il miglioramento continuo del modello.

Ad esempio, un agente AI potrebbe proporre un nuovo itinerario per un cliente il cui volo è stato cancellato, ma un operatore umano fornisce l’approvazione finale prima dell’emissione dei biglietti. Questo combina la velocità dell’AI con il giudizio e la responsabilità di un esperto umano.

Fase 5: Go-live e osservabilità

Distribuisci inizialmente il sistema validato a un gruppo limitato di utenti. Il lavoro non termina con il go-live. Un monitoraggio e un’osservabilità robusti devono essere presenti fin dal primo giorno per tracciare prestazioni, costi e soddisfazione degli utenti rispetto al business case iniziale.

Monitora continuamente metriche come la latenza dell’API, il consumo di token e il tasso di risposte errate (“allucinazioni”). Ad esempio, con rapporti che suggeriscono che la personalizzazione guidata dall’AI possa portare a un aumento significativo delle prenotazioni—come illustrato in questi approfondimenti sulla pianificazione dei viaggi con l’AI—l’affidabilità del sistema è fondamentale. I dati raccolti dal monitoraggio convalidano la roadmap e forniscono il business case per futuri investimenti ed espansione.

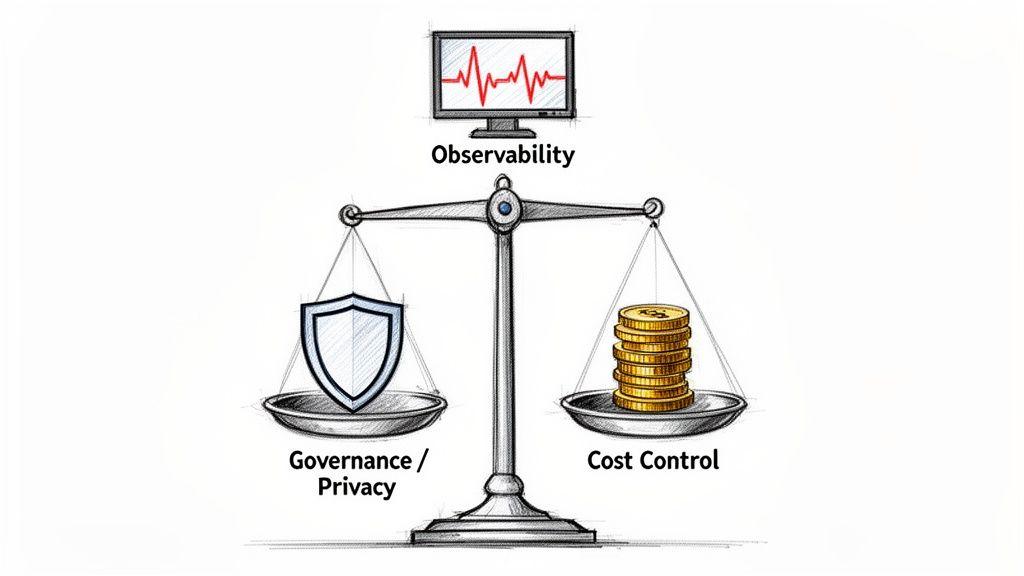

Governance, costi e affidabilità nei sistemi AI

Lanciare un sistema AI per i viaggi senza una governance robusta, controlli dei costi e misure di affidabilità rappresenta un rischio aziendale inaccettabile. Per i leader tecnici, questi requisiti non funzionali sono importanti quanto il modello AI stesso. Un approccio ingenuo porta a bollette API fuori controllo, fallimenti di conformità che erodono la fiducia degli utenti e servizi inaffidabili che creano più problemi di quanti ne risolvano.

Governance e conformità by design

Le aziende di viaggi custodiscono dati personali altamente sensibili, inclusi nomi, numeri di passaporto, dettagli di pagamento e cronologie di viaggio. Questo rende la conformità a normative come il GDPR un requisito architetturale assoluto, non una funzione opzionale. Una violazione dei dati o un modello AI distorto rappresentano una minaccia diretta alla continuità operativa.

Una governance efficace significa incorporare privacy ed equità nella progettazione del sistema fin dall’inizio. Questo si traduce in pratiche ingegneristiche concrete:

- Minimizzazione dei dati: Raccogli e processa solo i dati strettamente necessari per il compito da svolgere. Se un’AI non ha bisogno dell’intera cronologia di viaggio di un utente per suggerire un hotel, non fornirle quei dati.

- Anonimizzazione e pseudonimizzazione: Implementa processi per de-identificare i dati degli utenti prima che vengano inviati a un modello di terze parti o utilizzati per il training.

- Mitigazione dei bias: Verifica attivamente la presenza di bias nascosti nei modelli. Un modello che offre sistematicamente prezzi più alti o opzioni peggiori a determinati gruppi demografici non è solo ingiusto: è una responsabilità significativa.

La portata dell’adozione dell’AI rende tutto ciò urgente. Con la pianificazione dei viaggi guidata dall’AI ormai mainstream—come puoi scoprire in queste insight chiave per il 2026—enormi quantità di dati fluiscono attraverso questi sistemi. Mantenere la fiducia è fondamentale.

Implementare controlli pratici dei costi

I costi dell’AI, in particolare quelli delle API LLM, possono aumentare rapidamente senza una gestione proattiva. Ogni chiamata API è misurata in token e un sistema mal ottimizzato può generare migliaia di euro di spese impreviste.

Controllare i costi richiede una strategia architetturale a più livelli:

- Selezione del modello dimensionata correttamente: Usa il modello più piccolo ed efficiente che possa svolgere il compito in modo efficace. Utilizzare un modello costoso e di grandi dimensioni per una semplice attività di classificazione è un uso inefficiente delle risorse.

- Caching intelligente: Per richieste frequenti e ripetitive, memorizza nella cache la risposta generata dall’AI. Questa semplice tecnica riduce le chiamate API ridondanti, la latenza e i costi.

- Batching delle richieste: Dove applicabile, raggruppa più richieste utente in una singola chiamata API. Questo è spesso più efficiente di numerose chiamate singole e piccole.

Garantire osservabilità e affidabilità

I sistemi AI introducono modalità di guasto uniche, incluse allucinazioni, degrado delle prestazioni e dipendenze da servizi esterni. Il sistema deve essere progettato per la resilienza.

Una robusta osservabilità è la base dell’affidabilità, fornendo la visibilità necessaria per diagnosticare i problemi prima che impattino i clienti. Per costruire un sistema AI per i viaggi affidabile, devi implementare:

- Logging completo: Registra tutte le interazioni critiche, inclusi prompt, risposte, latenza, conteggio dei token ed errori.

- Monitoraggio delle prestazioni: Traccia in tempo reale le metriche chiave, come tempi di risposta, tassi di errore e rapporti di hit della cache.

- Meccanismi di fallback: Progetta vie di uscita chiare. Se il modello AI fallisce o restituisce un errore, il sistema deve degradare in modo elegante, ad esempio reindirizzando l’utente a un operatore umano o a un’interfaccia di ricerca standard.

Molti team non riescono a integrare queste reti di sicurezza. Un sistema affidabile anticipa i guasti ed è progettato per gestirli, garantendo un’esperienza utente coerente e affidabile. Per un approfondimento, consulta la nostra guida su software di governance, risk e compliance.

Conclusione: principali insegnamenti architetturali per i leader

Per founder, CTO e leader di prodotto, implementare con successo l’intelligenza artificiale per i viaggi non significa inseguire l’hype. Si ottiene applicando metodicamente pattern tecnici collaudati per risolvere problemi di business specifici e ad alto valore. I sistemi più efficaci sono il risultato di una strategia chiara e di un’ingegneria disciplinata.

Fondamentalmente, il successo dell’AI per i viaggi è il prodotto della disciplina architetturale. Privacy, affidabilità e controllo dei costi non sono funzionalità da aggiungere in seguito. Sono decisioni fondamentali da prendere fin dal primo giorno. Questa mentalità è ciò che separa sistemi duraturi e di valore da esperimenti costosi e fragili.

Man mano che passi dal concetto alla produzione, questi principi forniscono una bussola affidabile per le decisioni tecniche e strategiche.

-

Inizia dal problema di business, non dalla tecnologia: Individua un problema operativo concreto, come ridurre lo sforzo manuale di riprenotazione o migliorare la personalizzazione per i nuovi clienti. Un problema ben definito determina l’architettura appropriata e fornisce metriche chiare per il successo.

-

Scegli il giusto modello architetturale: Non partire automaticamente dalla soluzione più complessa. Una semplice chiamata a un LLM è efficace per riassumere le recensioni. Un pattern RAG è ideale per domande e risposte fattuali. Riserva i flussi di lavoro agentici complessi per attività in più fasi come la pianificazione di un itinerario. L’eccesso di progettazione porta a costi più elevati e a un maggiore carico di manutenzione.

-

Integra governance e controlli dei costi fin dal primo giorno: Progetta l’architettura in ottica di compliance minimizzando la gestione dei dati. Implementa controlli pratici sui costi tramite caching intelligente e una scelta del modello adeguata alle esigenze. Non sono elementi secondari; sono essenziali per la sostenibilità a lungo termine.

-

Dai priorità al coinvolgimento umano nei processi critici: Per qualsiasi azione con un impatto finanziario o reputazionale significativo, progetta un sistema human-in-the-loop (HITL). Questo approccio unisce la velocità dell’AI al giudizio umano, creando una rete di sicurezza fondamentale e un ciclo di feedback per il miglioramento continuo.

Aderire a questi principi ti aiuterà a costruire sistemi AI per il settore travel non solo potenti, ma anche robusti, sicuri ed اقتصادی?”