Un moderno sistema di gestione documentale (DMS) non è un armadietto digitale per l’archiviazione. È l’architettura fondamentale per la sicurezza, la resilienza operativa e le capacità di automazione di un’organizzazione. Un DMS progettato correttamente fornisce controllo delle versioni immutabile, gestione degli accessi granulare e flussi di lavoro verificabili—trasformando file statici in asset strategici.

Per i responsabili tecnici e aziendali, la distinzione è cruciale. Trattare un DMS come un semplice costo IT ignora il suo ruolo nel mitigare il rischio e nell’abilitare l’innovazione futura.

Il rischio operativo dei dati non strutturati

La dipendenza da unità condivise, fogli di calcolo e catene di email per informazioni critiche introduce un rischio aziendale significativo. Questo approccio legacy crea silos di dati, caos nelle versioni e vulnerabilità di sicurezza incompatibili con i requisiti operativi moderni.

Le conseguenze impattano sia le funzioni tecniche che quelle aziendali. I CTO non possono integrare dati frammentati in applicazioni coerenti. I responsabili della conformità affrontano fallimenti negli audit a causa dell’assenza di registri di accesso verificabili. I responsabili di prodotto non sono in grado di sfruttare documenti disorganizzati e di bassa qualità per addestrare modelli di IA affidabili, soffocando l’innovazione.

Il problema: mancanza di controllo e verificabilità

La questione centrale è una mancanza fondamentale di controllo e visibilità sugli asset informativi critici. Considerate uno scenario in cui un contratto di servizi principali esiste in tre posizioni diverse: il computer locale di un ingegnere, una cartella di progetto condivisa e l’archivio email del project manager. L’assenza di una singola fonte di verità crea una significativa attrito operativo.

Questo è un sintomo di carenze architetturali sistemiche, che portano a una cascata di problemi:

- Failure del controllo delle versioni: I team sprecano cicli di ingegneria a risolvere discrepanze tra le versioni dei documenti, causando errori costosi e rilavorazioni.

- Vulnerabilità di sicurezza: I dati sensibili memorizzati in unità ad uso generale spesso mancano dei controlli di accesso granulari necessari, esponendoli ad accessi non autorizzati interni o esterni.

- Deficienze di conformità e audit: Dimostrare la conformità a regolamenti come GDPR o NIS2 è quasi impossibile senza registri immutabili che traccino accessi e modifiche ai dati.

- Flussi di lavoro inefficienti: L’instradamento manuale dei documenti per le approvazioni crea colli di bottiglia che ritardano i progetti e ostacolano la velocità operativa.

Un cambiamento strategico di prospettiva

Un sistema di gestione documentale ben progettato affronta questi problemi imponendo struttura, sicurezza e automazione dei processi a livello architetturale. Non si tratta di aggiungere overhead; si tratta di abilitare operazioni digitali moderne. I dati di mercato riflettono questa comprensione. Il Nord America, per esempio, ha dominato il mercato globale dei DMS con una quota del 40.8% nel 2024, rappresentando USD 3.5 billion di ricavi.

Per le organizzazioni che sviluppano software personalizzato, la tendenza è chiara. Si prevede che il mercato statunitense crescerà a un 14.9% CAGR dal 2025 al 2030, guidato da settori regolamentati che richiedono infrastrutture dati sicure e conformi. L’imperativo tecnico è innegabile; puoi esplorare ulteriormente queste dinamiche di mercato per un’analisi più approfondita.

Un DMS robusto trasforma i documenti da file statici e passivi in asset attivi e intelligenti. Fornisce la base architetturale necessaria per costruire applicazioni B2B affidabili, sicure e scalabili, trasformando l’informazione in un vantaggio competitivo.

Lo schema architetturale di un DMS moderno

Un moderno sistema di gestione documentale è un assemblaggio complesso di componenti di ingegneria interconnessi, non un’applicazione monolitica. Per i leader tecnici, comprendere questa architettura è essenziale per valutare i compromessi e andare oltre le affermazioni di marketing per giudicare le capacità sottostanti. Questo schema scompone i pattern principali di un DMS robusto.

Il ciclo di vita del sistema inizia con l’ingestione—il processo di incorporamento sicuro di un documento nel sistema tramite una pipeline flessibile e verificabile.

Ingestione ed estrazione dei metadati

I documenti provengono da fonti diverse: upload degli utenti, output di sistemi automatizzati e documenti cartacei scansionati. Un livello di ingestione ben progettato deve accogliere questi flussi di lavoro vari in modo programmatico.

- APIs: Per l’integrazione sistema-a-sistema, le API RESTful o GraphQL sono imprescindibili. Servono come spina dorsale programmatica per i flussi di lavoro automatizzati, permettendo ad altre applicazioni di inviare documenti al DMS senza intervento manuale.

- Scansione e OCR: Per i documenti fisici è necessario il Riconoscimento Ottico dei Caratteri (OCR). I moderni motori OCR sfruttano la computer vision per convertire immagini scansionate in testo leggibile dalla macchina e ricercabile.

- Connettori diretti: Integrazioni con server di posta elettronica o fornitori di archiviazione cloud (es. Google Drive, Dropbox) consentono la cattura automatizzata dei documenti, eliminando processi manuali soggetti a errori.

Una volta ingerito, il documento deve essere compreso. L’estrazione dei metadati è il processo in cui il DMS analizza automaticamente il file per identificare attributi chiave: autore, data di creazione, tipo di documento e persino dati specifici del dominio come valori contrattuali o numeri di fattura. Questi metadati sono la base per una ricerca, un recupero e una governance precisi.

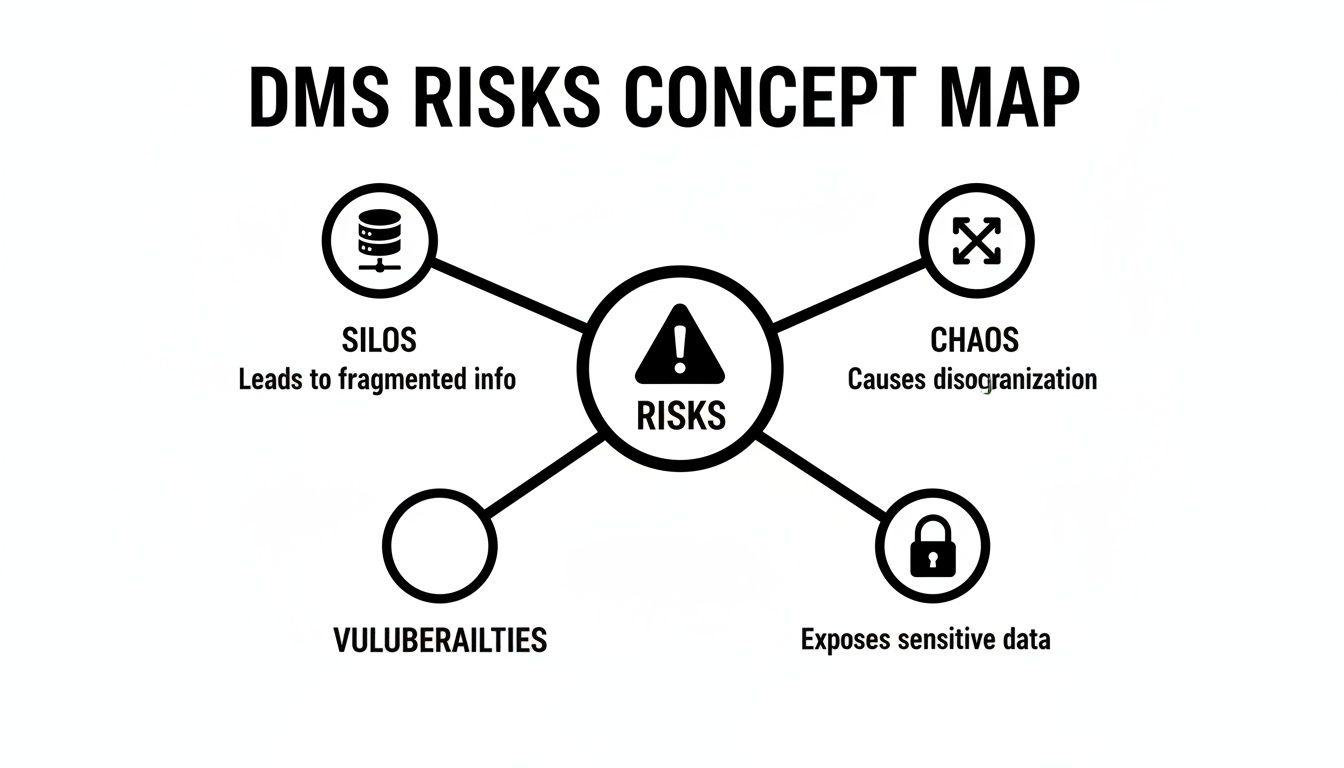

Senza un approccio architetturale coerente, il risultato è il caos dei dati. La seguente mappa dei rischi illustra le modalità di fallimento comuni di un sistema disorganizzato.

Questa visualizzazione evidenzia un legame causale diretto: i dati non strutturati portano a silos informativi, rotture nei flussi di lavoro e vulnerabilità critiche di sicurezza. Un’architettura DMS robusta è progettata specificamente per mitigare questi rischi.

Livelli di indicizzazione e archiviazione

Con contenuti e metadati pronti, la sfida architetturale successiva è abilitare un recupero efficiente. Un approccio ingenuo basato su semplici query di database non scalerà. Questo richiede motori di indicizzazione dedicati e ad alte prestazioni come Elasticsearch o Apache Solr.

Questi motori creano un indice invertito, che mappa il contenuto alla sua posizione all’interno dei documenti, abilitando la ricerca full-text quasi istantanea su milioni di file. Il compromesso primario è tra granularità dell’indicizzazione e consumo di risorse; un’indicizzazione più profonda fornisce capacità di ricerca superiori ma richiede maggiore elaborazione e spazio di archiviazione.

La scelta del livello di archiviazione è altrettanto critica, con implicazioni significative su costi, durabilità e sicurezza.

Il principio architetturale fondamentale è disaccoppiare i metadati e l’indice di ricerca dai file binari stessi. Questa separazione delle responsabilità consente a ciascun componente di essere ottimizzato per la propria funzione specifica—query veloci per l’indice e archiviazione durevole e conveniente per i file.

Le architetture moderne utilizzano prevalentemente soluzioni di object storage come Amazon S3 o Google Cloud Storage. Offrono scalabilità quasi infinita, ridondanza integrata e un modello di prezzo basato sul consumo conveniente. Tentare di conservare grandi volumi di file su un tradizionale file system di server introduce punti singoli di guasto e significative sfide di scalabilità.

Modelli di controllo delle versioni

Infine, un DMS deve fornire un controllo delle versioni robusto. Due pattern architetturali principali affrontano questo requisito:

- Snapshot del database: Questo modello salva una copia completa del documento per ogni revisione e tiene traccia della cronologia delle versioni in una tabella del database. Pur essendo semplice da implementare, può comportare un consumo significativo di spazio di archiviazione se non gestito con attenzione tramite policy di lifecycle.

- Modelli basati su Git: Ispirati allo sviluppo software, alcuni sistemi utilizzano un modello simile a Git per memorizzare solo le differenze (diff) tra le versioni. Questo approccio è molto efficiente per documenti testuali ma introduce una maggiore complessità architetturale.

La scelta ottimale dipende dai tipi di documento specifici gestiti e dalla granularità richiesta nella cronologia delle versioni.

Ogni decisione architetturale—from ingestion to versioning—involves compromessi critici che determinano le prestazioni, la sicurezza e la scalabilità del sistema. Per comprendere come questi componenti possano essere composti come servizi indipendenti, esplora la nostra Architettura orientata ai servizi nella nostra guida completa.

Orientarsi nella decisione Costruire vs Acquistare

L’implementazione di un sistema di gestione documentale presenta una decisione strategica fondamentale: acquisire un prodotto pronto all’uso o investire in una soluzione personalizzata. Questa scelta va oltre una semplice analisi costi-benefici; determina il controllo di un’organizzazione sulla propria architettura, l’esposizione al rischio e l’agilità operativa a lungo termine.

Una decisione pragmatica richiede una rigorosa valutazione delle capacità tecniche interne, dei requisiti di flusso di lavoro unici e degli obiettivi strategici. Un errore di valutazione può tradursi in vendor lock-in con uno strumento che vincola i processi aziendali, o peggio, in una costruzione personalizzata costosa e non manutenibile che diventa un drenaggio persistente sulle risorse di ingegneria.

Il caso per l’acquisto di un DMS pronto all’uso

Acquisire un DMS commerciale è tipicamente la via più rapida per la messa in produzione. Queste piattaforme forniscono accesso immediato a un set di funzionalità convalidato su una vasta base clienti.

I vantaggi principali sono:

- Distribuzione rapida: Un sistema commerciale può essere operativo in giorni o settimane, rispetto ai mesi o agli anni necessari per una soluzione personalizzata. Questo accelera il time-to-value.

- Conformità e sicurezza integrate: I fornitori affidabili investono molto per soddisfare standard normativi come GDPR, HIPAA e NIS2. Funzionalità di base come audit trail, policy di retention e controlli di accesso sono pre-costruite, riducendo l’onere interno della conformità.

- Costi prevedibili: I modelli di abbonamento forniscono una chiara spesa operativa (OpEx) piuttosto che una grande e incerta spesa in conto capitale (CapEx). Il fornitore è responsabile per la manutenzione, gli aggiornamenti e le patch di sicurezza.

Tuttavia, questa comodità comporta significativi compromessi. Il controllo sull’architettura e sulla roadmap del sistema viene ceduto a una terza parte. Il vendor lock-in rappresenta un rischio sostanziale, rendendo la migrazione futura verso un’altra piattaforma tecnicamente difficile e finanziariamente proibitiva. Inoltre, la funzionalità del sistema è vincolata al design del fornitore, che potrebbe non allinearsi perfettamente ai processi aziendali specifici.

La logica strategica per costruire un DMS personalizzato

Costruire un sistema di gestione documentale personalizzato è un investimento ingegneristico significativo che offre il beneficio ultimo: il controllo completo. Questo approccio è giustificabile per organizzazioni con flussi di lavoro altamente specializzati, requisiti di integrazione complessi o posture di sicurezza stringenti che non possono essere soddisfatti da prodotti pronti all’uso.

Una soluzione costruita su misura permette a un’organizzazione di:

- Raggiungere un allineamento perfetto dei flussi di lavoro: Il sistema può essere progettato per modellare con precisione i processi aziendali esistenti, evitando la necessità che i team adattino i loro flussi di lavoro a uno strumento generico. Questo può tradursi in significativi guadagni di efficienza a lungo termine.

- Mantenere il controllo architetturale completo: Il team interno determina lo stack tecnologico, l’implementazione della sicurezza e tutti i punti di integrazione. Questo è essenziale quando il DMS deve essere profondamente integrato in un ecosistema software proprietario.

- Possedere la proprietà intellettuale: Il sistema risultante è un asset strategico di proprietà dell’azienda, libero da costi di licenza ricorrenti e dalla dipendenza dalla sopravvivenza di un fornitore. I rischi, tuttavia, sono sostanziali. L’investimento iniziale nello sviluppo è significativo. Crucialmente, l’organizzazione assume la responsabilità totale per la manutenzione continua, le patch di sicurezza e la scalabilità. Un approccio ingenuo alla sicurezza in una soluzione personalizzata potrebbe esporre dati sensibili, portando a disastrose violazioni di conformità e danni reputazionali.

La decisione di costruire non è meramente tecnica; è un impegno a lungo termine a possedere, mantenere e mettere in sicurezza un componente infrastrutturale critico per la missione. Questo richiede risorse di ingegneria dedicate e una profonda competenza in materia di sicurezza.

La tabella seguente fornisce un confronto diretto di questi compromessi. La scelta della residenza dei dati ha inoltre un proprio insieme di implicazioni, che puoi esplorare nella nostra guida su Cloud Computing Vs On-Premise solutions.

Build Vs Buy: A Strategic Comparison For DMS Implementation

Scegliere tra costruire un DMS personalizzato e acquistare una soluzione pronta comporta una serie di compromessi critici. Questa tabella scompone le considerazioni chiave per aiutare a guidare il processo decisionale.

| Consideration | Off-the-Shelf (Buy) | Custom Solution (Build) |

|---|---|---|

| Time to Value | Veloce (giorni-settimane) | Lento (mesi-anni) |

| Initial Cost | Basso (canoni di abbonamento) | Alto (risorse di sviluppo) |

| Long-Term Cost | Prevedibile ma con spese operative (OpEx) continue | Variabile; include manutenzione, hosting e personale |

| Workflow Fit | Generica; potrebbe richiedere adattamenti dei processi | Su misura; adattata alle esigenze esatte |

| Control & Flexibility | Limitata alle offerte del fornitore | Controllo completo dell’architettura e delle funzionalità |

| Security Responsibility | Condivisa con il fornitore | Interamente interna |

| Vendor Lock-in | Alto rischio | Nessun rischio |

| Maintenance Burden | Gestito dal fornitore | Responsabilità interna |

Non esiste una risposta universalmente corretta. Il percorso ottimale dipende dal contesto specifico dell’organizzazione, dalle risorse e dalle priorità strategiche. L’acquisto offre velocità e prevedibilità, mentre la costruzione fornisce un controllo senza pari e un adattamento perfetto ai processi, ma a costi e rischi significativamente maggiori.

Integrare l’IA per l’elaborazione intelligente dei documenti

Un sistema tradizionale di gestione documentale memorizza i file ma non ne comprende il contenuto. Integrare l’Intelligenza Artificiale (IA) trasforma il DMS da un archivio passivo in una base di conoscenza attiva, permettendo al sistema di interpretare e agire sulle informazioni contenute nei documenti.

Questa non è una semplice funzionalità superficiale. È un cambiamento architetturale fondamentale che sblocca il valore incorporato in contratti, report e fatture su scala.

Il problema principale che l’IA risolve è la limitazione umana. Nessun team può leggere, classificare ed estrarre manualmente insight da milioni di documenti. L’elaborazione intelligente dei documenti (IDP) automatizza queste attività, trasformando il DMS in un asset informativo dinamico. Si prevede che il mercato dell’IDP crescerà da 1,8 miliardi di dollari nel 2023 a 2,9 miliardi di dollari entro il 2032, riflettendo questo cambiamento.

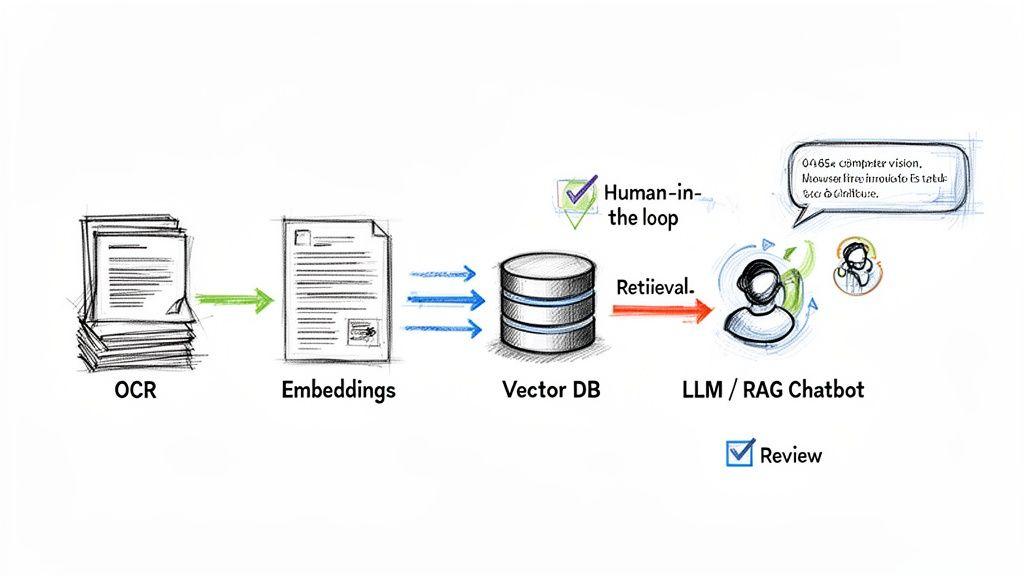

Questo flusso di lavoro illustra come file statici possano essere trasformati in una fonte interattiva di informazioni verificabili. Un’implementazione di successo dipende da componenti architetturali specifici e da un approccio pragmatico alla gestione dei rischi dell’IA.

Oltre le parole chiave con la ricerca semantica

La ricerca basata su parole chiave è fragile; fallisce se l’utente non conosce la terminologia precisa all’interno di un documento. L’utente non riceve risultati e conclude erroneamente che l’informazione non è disponibile.

La ricerca semantica risolve questo problema comprendendo il significato concettuale, non solo le corrispondenze lessicali.

Questo si ottiene usando modelli di embedding. Quando un documento viene ingerito, un modello converte il suo testo in un vettore ad alta dimensionalità — un “embedding” — che rappresenta numericamente il suo significato semantico. Questi embedding vengono memorizzati e indicizzati in un database vettoriale specializzato.

Durante una query di ricerca:

- La query dell’utente viene anch’essa convertita in un embedding.

- Il sistema esegue una ricerca dei vicini più prossimi nel database vettoriale per trovare gli embedding dei documenti semanticamente “più vicini” all’embedding della query.

- I documenti più rilevanti vengono restituiti, anche se non contengono le esatte parole chiave usate nella query.

Un utente che cerca “limitazioni di responsabilità nei nostri accordi con i fornitori” può così recuperare un contratto che usa solo la frase legale “caps on indemnity” — una connessione che una ricerca per parole chiave avrebbe perso.

Costruire basi di conoscenza con RAG

Una potente applicazione dell’IA in un DMS è la creazione di un sistema interno di question answering usando un’architettura di Retrieval-Augmented Generation (RAG). RAG mitiga il rischio delle “allucinazioni” dei Large Language Model (LLM) radicando le loro risposte nel contenuto fattuale dei documenti dell’organizzazione.

Il processo è concettualmente semplice ma richiede ingegneria accurata:

- Un utente invia una domanda in linguaggio naturale (es. “Qual è la nostra politica di notifica delle violazioni dei dati?”).

- Il sistema usa la ricerca semantica per recuperare i frammenti di testo più rilevanti dal corpus documentale.

- Questi frammenti recuperati vengono quindi passati a un LLM insieme alla domanda originale e a un prompt che gli istruisce: “Rispondi alla domanda dell’utente usando solo le informazioni fornite.”

Questa architettura trasforma la libreria di documenti in una base di conoscenza verificabile che può essere interrogata in linguaggio naturale.

Prerequisiti architetturali e rischi

Integrare un LLM non è un esercizio plug-and-play. Richiede uno stack tecnologico specifico e una comprensione pragmatica dei limiti del sistema.

Un approccio ingenuo che collega un LLM direttamente a un archivio documentale è una ricetta per risposte inaccurate e perdite di dati. L’architettura deve essere progettata per il controllo, la verifica e la sicurezza.

I componenti tecnici chiave includono:

- Database vettoriale: È necessario un sistema per memorizzare e interrogare gli embedding. Le opzioni includono soluzioni dedicate come Pinecone o Weaviate, o estensioni come pgvector per PostgreSQL.

- Framework di orchestrazione: Strumenti come LangChain o LlamaIndex forniscono le astrazioni necessarie per gestire la complessa sequenza di prompt, retrieval e interazioni con i modelli in una pipeline RAG.

- OCR avanzato: Per documenti non strutturati o scansionati, sono necessari modelli moderni di computer vision per estrarre accuratamente testo e dati strutturati prima che possano essere processati da un LLM.

È fondamentale ricordare che nessun sistema di IA è infallibile. Un processo human-in-the-loop (HITL) è imprescindibile per applicazioni ad alto rischio come l’analisi contrattuale o la verifica di conformità. Questo comporta la creazione di interfacce per esperti del dominio per rivedere, correggere e approvare gli output generati dall’IA, creando un ciclo di feedback che migliora la precisione del sistema nel tempo.

Incorporare sicurezza e conformità fin dalla progettazione

In qualsiasi serio sistema di gestione documentale, la sicurezza non è una funzionalità aggiuntiva; è un prerequisito architetturale. Trattare sicurezza e privacy come un ripensamento è una strategia ingenua che porta a violazioni dei dati e sanzioni regolamentari.

Un sistema difendibile incorpora queste protezioni nel suo nucleo architetturale fin dalla fase di progettazione iniziale. Ogni componente, dagli endpoint API ai bucket di storage, deve essere progettato con un principio di sicurezza-first. Questa è la distinzione tra un sistema sicuro per progettazione e uno che è sicuro per caso.

Livelli fondamentali di sicurezza

Un’architettura DMS sicura si basa su diversi livelli non negoziabili. Questi non sono best practice ma i requisiti di base per gestire dati B2B sensibili.

-

Controllo di accesso robusto: Il controllo granulare delle autorizzazioni degli utenti è fondamentale. Role-Based Access Control (RBAC) fornisce un punto di partenza definendo permessi per gruppi (es. ‘amministratori’, ‘utenti’). Tuttavia, per ambienti complessi, Attribute-Based Access Control (ABAC) è un modello superiore. ABAC abilita regole dinamiche e contestuali come: “Consenti accesso solo se l’utente è nel dipartimento Finance, la richiesta avviene durante l’orario lavorativo, e il documento è etichettato ‘Q3-Financials’.”

-

Crittografia end-to-end: I dati devono essere protetti sia in transito che a riposo. Questo richiede l’uso di protocolli di trasporto robusti come TLS 1.3 per i dati in movimento tra client e server, e standard di crittografia forti come AES-256 per i dati memorizzati su disco.

-

Log di audit immutabili: Per soddisfare i requisiti di conformità, è essenziale un registro verificabile e a prova di manomissione di tutta l’attività di sistema. Un log di audit immutabile registra ogni azione — visualizzazione, modifica, download, cancellazione — in modo che non possa essere alterato o eliminato. Questo fornisce la piena tracciabilità richiesta per le verifiche regolamentari.

Questi livelli lavorano in concerto per creare un sistema rinforzato in cui la sicurezza è una proprietà intrinseca, non un’opzione di configurazione. Questa filosofia è centrale per implementare Privacy by Design.

Mappare l’architettura ai mandati normativi

La conformità a regolamenti come GDPR, NIS2, DORA o HIPAA non è un esercizio di spunta di caselle; è il risultato diretto di scelte architetturali specifiche e capacità del sistema. Un DMS ben progettato fornisce i controlli tecnici necessari per far rispettare questi complessi quadri giuridici.

Questo si riflette nelle tendenze del mercato globale dei DMS. Il settore IT nordamericano, con una quota di mercato del 43,70%, è guidato da aziende tecnologiche che richiedono controlli dei dati a tenuta stagna per mitigare le minacce informatiche. Con le distribuzioni cloud che ora rappresentano oltre il 67,2% del mercato, le organizzazioni stanno sfruttando le funzionalità dei DMS per automatizzare la conformità a regolamenti come HIPAA, il che può ridurre gli errori di processamento manuale dei documenti fino al 40%. Puoi scoprire ulteriori approfondimenti su queste tendenze di mercato su Fortune Business Insights.

La conformità non è un flusso di lavoro separato; è l’output di un sistema ben progettato. L’architettura del tuo DMS dovrebbe rendere la conformità il percorso di minor resistenza.

Le funzionalità specifiche del DMS si collegano direttamente ai requisiti normativi:

-

Controlli sulla residenza dei dati: Il GDPR richiede il controllo sulla posizione fisica di archiviazione dei dati personali. Un’architettura DMS deve consentire l’applicazione di politiche, garantendo che i documenti relativi ai cittadini dell’UE siano memorizzati esclusivamente in data center all’interno dell’UE.

-

Policy di conservazione automatizzate: I regolamenti impongono specifici tempi di conservazione e cancellazione dei dati. Un DMS automatizza questo permettendo regole come: “Elimina automaticamente tutte le fatture dopo sette anni,” garantendo l’applicazione coerente delle policy senza intervento manuale.

-

Legal hold (sospensione legale): In caso di contenzioso o indagine, un requisito di sospensione legale può sovrascrivere le policy di conservazione standard. Una funzionalità di legal hold permette ai team di conformità di bloccare documenti specifici, impedendone la modifica o la cancellazione fino a quando la sospensione non viene revocata.

-

Classificazione dei dati: Etichettare i documenti in base alla sensibilità (es. ‘Pubblico’, ‘Interno’, ‘Confidenziale’) consente l’automazione delle policy di sicurezza. Queste etichette possono governare regole che limitano l’accesso ai documenti ‘Confidenziali’ a gruppi di utenti specifici o ne impediscono il download.

Una roadmap per fasi di implementazione e migrazione

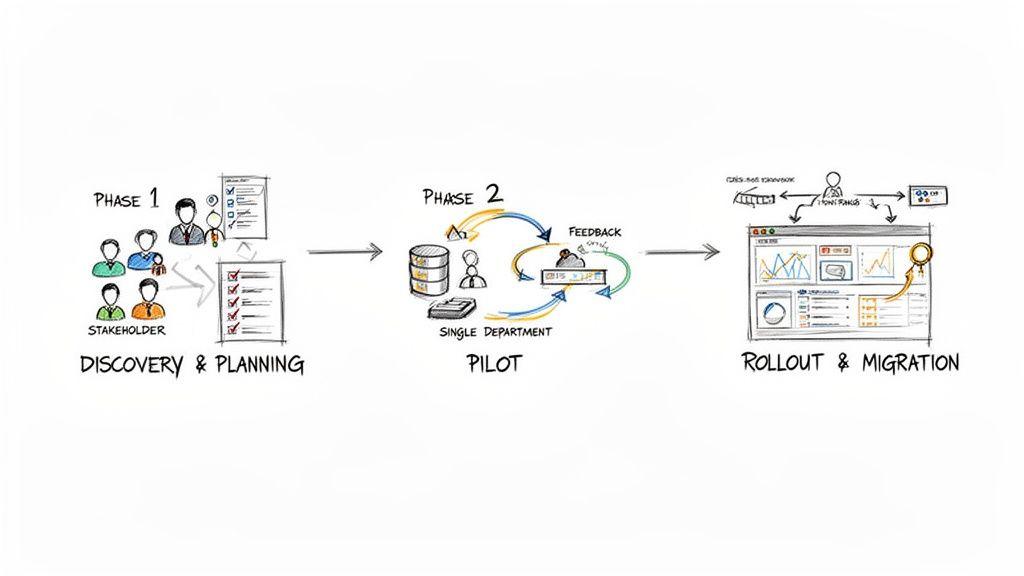

Distribuire un sistema di gestione documentale con un lancio “big bang” è una strategia ad alto rischio che spesso porta a interruzioni operative e scarsa adozione da parte degli utenti. Una roadmap pragmatica e per fasi è essenziale per ridurre i rischi del progetto, gestire lo scope e fornire valore misurabile in ogni fase. L’implementazione dovrebbe seguire un processo strutturato in tre fasi: dalla definizione strategica a un pilot controllato e, infine, a un’implementazione su larga scala. Questo approccio metodico mitiga i rischi e garantisce l’allineamento con gli obiettivi aziendali.

Fase 1: Scoperta e Pianificazione

Questa fase fondamentale definisce il problema da risolvere e le metriche per il successo. Si concentra esclusivamente sui requisiti e sulla governance prima che venga scritto alcun codice o che siano acquistate licenze. Gli errori commessi qui saranno amplificati nelle fasi successive.

Le attività chiave includono:

- Identificazione degli stakeholder: Coinvolgere rappresentanti di legale, finanza, operations e altri dipartimenti che si basano su flussi di lavoro incentrati sui documenti. Il loro contributo è imprescindibile per progettare un sistema che si allinei ai processi aziendali reali.

- Mappatura dei flussi di lavoro: Analizzare e documentare i processi documentali critici così come esistono attualmente. Identificare colli di bottiglia, lacune di sicurezza e fonti di lavoro manuale. Questa analisi costituisce il business case per il progetto.

- Politica di governance dei dati: Prima di migrare qualsiasi dato, stabilire regole chiare. Definire uno schema di classificazione dei dati (Pubblico, Interno, Riservato), impostare programmi di conservazione e formalizzare le politiche di controllo degli accessi. Questo documento funge da progetto per la configurazione del DMS.

Fase 2: Implementazione Pilota

La fase pilota verifica le ipotesi del piano in un ambiente reale e controllato. L’obiettivo è convalidare la tecnologia scelta, raccogliere feedback dagli utenti e ottenere un successo iniziale per costruire slancio nel progetto. Un pilot limita la portata di eventuali problemi imprevisti, a differenza di un lancio iniziale su larga scala ad alto rischio.

Selezionare un singolo caso d’uso ben definito, come la gestione dei contratti per l’ufficio legale o l’elaborazione delle fatture per la finanza. Questo test controllato consente di:

- Convalidare l’architettura: Confermare che il DMS si integri correttamente con l’infrastruttura esistente, come i provider di identità e l’archiviazione cloud.

- Raccogliere feedback dagli utenti: Raccogliere il feedback da un piccolo gruppo di utenti finali sull’interfaccia, sulla funzionalità di ricerca e sulla progettazione dei flussi di lavoro. Questo input è fondamentale per affinare il sistema prima di un rollout più ampio.

- Dimostrare vittorie iniziali: Un pilot di successo funge da prova di concetto interna, dimostrando il valore del sistema e assicurando il coinvolgimento degli altri dipartimenti per l’implementazione completa.

Fase 3: Rollout completo e migrazione dei dati

La fase finale comporta la scalabilità della soluzione in tutta l’organizzazione ed l’esecuzione della strategia di migrazione dei dati. Questa fase riguarda tanto la gestione del cambiamento quanto la tecnologia. Una comunicazione chiara e la formazione degli utenti sono fondamentali per un lancio di successo.

La migrazione dei dati legacy richiede un approccio metodico, non un ingenuo ‘lift-and-shift’, che rischia di creare una discarica digitale.

- Pulizia e classificazione: Prima della migrazione, eseguire una revisione delle condivisioni di file esistenti per identificare e archiviare o eliminare dati ridondanti, obsoleti e triviali (ROT).

- Migrazione a fasi: Migrare i dati dipartimento per dipartimento o flusso di lavoro per flusso di lavoro. Ciò minimizza le interruzioni operative e consente miglioramenti iterativi del processo.

- Monitorare e iterare: Dopo il lancio, monitorare continuamente le prestazioni del sistema, le metriche di adozione degli utenti e l’aderenza alle politiche di governance. Usare questi dati per informare miglioramenti continui del sistema e gli sforzi di formazione. Il lancio è l’inizio del ciclo di vita del sistema, non la fine.

Domande chiave sull’implementazione: risposte

Per CTO, product leader e responsabili IT che valutano un’implementazione DMS, sorgono costantemente diverse domande pratiche. Ecco risposte concise e pragmatiche.

Quali sono i maggiori costi nascosti in un progetto DMS personalizzato?

I costi imprevisti più significativi raramente si trovano nello sviluppo iniziale. Si riscontrano nella manutenzione continua, nell’applicazione di patch di sicurezza e nella scalabilità dell’infrastruttura. La migrazione dei dati da sistemi legacy è anche una fonte comune di sforamento del budget a causa della sua complessità.

Un approccio proattivo richiede un piano di manutenzione dettagliato e una strategia di migrazione a fasi sin dall’inizio. Questo permette un migliore controllo sul costo totale di proprietà (TCO) e mitiga il rischio del progetto.

Come scegliamo tra distribuzione on-premise e cloud?

La decisione è guidata da requisiti specifici di sicurezza, conformità e operatività. Per la maggior parte delle organizzazioni, una distribuzione cloud (SaaS o IaaS) è la scelta pragmatica, offrendo superiore scalabilità, minori investimenti di capitale iniziali e accesso remoto semplificato.

Una soluzione on-premise fornisce controllo assoluto sui dati e sull’architettura di sicurezza. Questo è spesso un requisito non negoziabile per organizzazioni in settori altamente regolamentati come governo o finanza. Tuttavia, comporta un onere sostanzialmente maggiore per la gestione e la manutenzione dell’infrastruttura interna.

Come possiamo misurare il ROI di un nuovo sistema di gestione documentale?

Misurare il ritorno sull’investimento richiede l’analisi sia di metriche quantitative che qualitative.

- Metriche quantitative: Monitorare riduzioni di costo dirette in archiviazione fisica, stampa e spedizione. Ancora più importante, misurare i guadagni di produttività quantificando la riduzione del tempo che i dipendenti trascorrono a cercare informazioni.

- Metriche qualitative: Valutare i miglioramenti nella posizione di conformità, nella sicurezza dei dati e nella velocità decisionale. Pur essendo più difficile assegnare un valore monetario preciso, questi spesso rappresentano i benefici strategici maggiori.

Un programma pilota è il metodo più efficace per stabilire una previsione di ROI credibile. Fornisce dati reali sui guadagni di efficienza e sui risparmi di costo, permettendo una proiezione basata sui dati anziché sulla speculazione.

Costruire un sistema di gestione documentale affidabile, sicuro e scalabile richiede più del semplice codice; richiede un partner con profonda competenza tecnica e un approccio pragmatico, orientato al business. In Devisia, siamo specializzati nella creazione di software personalizzato che offre valore misurabile. Per saperne di più sul nostro approccio.