Per un leader tecnico, il software di business analytics non è una raccolta di grafici, ma un sistema progettato per convertire i dati operativi grezzi in intelligence strategica. Il problema centrale è comune: le organizzazioni sono ricche di dati provenienti da innumerevoli strumenti SaaS, database e log, ma mancano di insight affidabili e azionabili. Non si tratta di un fallimento del reporting; si tratta di un problema architetturale.

Andare oltre i dashboard verso una vera Business Intelligence

Molte organizzazioni raccolgono enormi quantità di dati operativi ma non riescono a sbloccarne il valore. Senza un sistema robusto per acquisire, elaborare e analizzare questi dati, essi diventano una passività: isolati in silos, rumorosi e fonte di più confusione che chiarezza. L’obiettivo è passare da dashboard reattivi a sistemi decisionali proattivi e intelligenti.

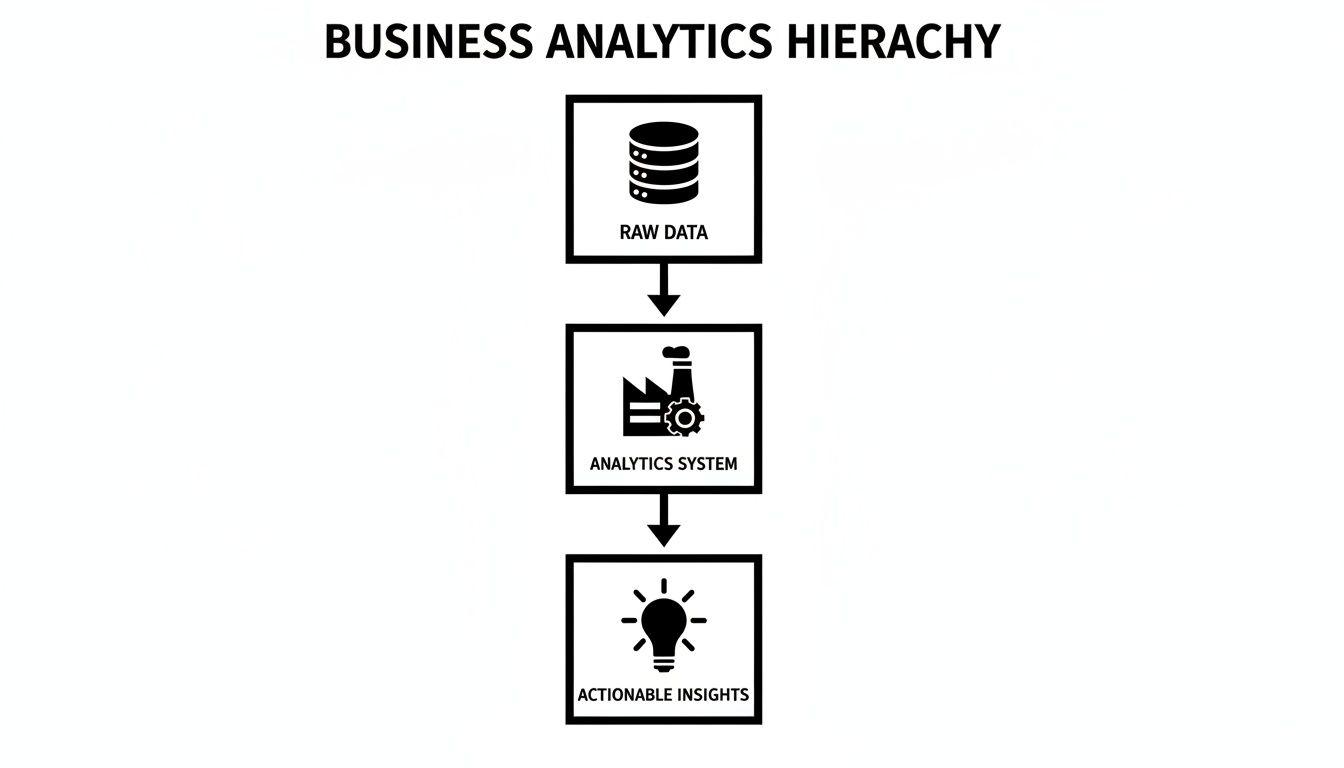

Considerate l’architettura di un sistema municipale di trattamento dell’acqua. L’acqua grezza proveniente da varie fonti (fiumi, bacini) è analoga ai dati grezzi provenienti da database, API e flussi di eventi. L’impianto di trattamento rappresenta il software di business analytics, svolgendo funzioni critiche:

- Ingestion: Raccolta dei dati grezzi da tutte le fonti.

- Transformation: Filtraggio, pulizia e strutturazione dei dati per soddisfare gli standard di qualità. Questo corrisponde al data modeling e ai processi ETL/ELT.

- Distribution: Consegna di insight elaborati e affidabili, tramite una rete governata, agli utenti finali.

Una mentalità architetturale

Osservare l’analytics attraverso questa lente riformula il problema. Un semplice dashboard collegato direttamente a un database di produzione è l’equivalente di bere acqua di fiume non trattata. I dati sono non filtrati, privi di contesto, e interrogarli direttamente può degradare le prestazioni dell’applicazione core. È un approccio comune ma ingenuo che introduce un rischio operativo significativo.

Un sistema di business analytics adeguato è infrastruttura. La sua progettazione richiede scelte architetturali deliberate in merito a raccolta dati, archiviazione, trasformazione e governance. Questo è l’unico modo per garantire che gli insight forniti siano accurati, sicuri, conformi e affidabili.

Un errore frequente è trattare il business analytics come un componente aggiuntivo del reporting. La vera intelligence richiede di applicare alla pipeline dati lo stesso rigore ingegneristico che si applica al prodotto core. È un sistema fondamentale, non un ripensamento dell’ultimo minuto.

Questa mentalità pragmatica è cruciale. Per founder e CTO, la conversazione deve spostarsi da “Quali grafici ci servono?” a “Qual è l’architettura più affidabile e sicura per convertire gli scarti operativi in asset strategici?” Rispondere correttamente a questa domanda determina se il vostro software di business analytics diventerà un motore scalabile di crescita o una raccolta di report fragili e scollegati.

Progettare una moderna architettura dati

La spina dorsale ingegneristica del vostro software di business analytics ne determina prestazioni, affidabilità e costo totale di proprietà. Un approccio moderno va oltre sistemi rigidi e monolitici verso un’architettura flessibile e componibile, in cui archiviazione dati, elaborazione e visualizzazione sono componenti disaccoppiati.

Il repository dati centrale è il fondamento di questo design. La scelta non riguarda semplicemente dati strutturati o non strutturati, ma la selezione del modello di archiviazione ottimale per specifici carichi di lavoro e pattern di query. Questa decisione influisce direttamente su prestazioni, costo operativo e flessibilità futura.

Modelli di archiviazione dati: Warehouse, Lake e Lakehouse

Scegliere il giusto modello di archiviazione è la prima decisione architetturale critica. Ogni opzione presenta trade-off distinti in termini di struttura, prestazioni e flessibilità. Una scelta ingenua in questa fase può creare un debito tecnico significativo e colli di bottiglia nelle prestazioni.

- Data Warehouse: Un repository altamente strutturato ottimizzato per query SQL rapide e reporting aziendale. I dati vengono puliti, strutturati e caricati in uno schema predefinito (schema-on-write), rendendolo ideale per analisi coerenti e ripetibili. La sua rigidità, tuttavia, lo rende inadatto ai dati grezzi e non strutturati o alla data science esplorativa.

- Data Lake: Un vasto repository che memorizza dati grezzi nel loro formato nativo (schema-on-read). Offre la massima flessibilità per i data scientist che lavorano con tipi di dati eterogenei (log, immagini, testo), ma senza una forte governance può degradarsi in un “data swamp” disorganizzato e inutilizzabile. Anche le prestazioni delle query possono rappresentare un problema significativo.

- Data Lakehouse: Un modello ibrido che combina i vantaggi di entrambi. Implementa strutture e funzionalità di gestione simili a quelle di un data warehouse (ad es. transazioni ACID) direttamente sopra storage a basso costo tipico dei data lake. Questa architettura supporta sia la BI tradizionale sia i carichi di lavoro di machine learning sullo stesso repository dati.

Questo diagramma illustra il flusso dati ad alto livello, da sorgenti di dati grezzi eterogenee attraverso il sistema analytics per produrre insight strutturati e azionabili.

La visualizzazione chiarisce che il sistema analytics è il motore critico che trasforma input caotici in output strutturati e strategici.

Da ETL rigido a pipeline ELT flessibili

Anche il metodo per spostare i dati nel repository si è evoluto. L’approccio tradizionale ETL (Extract, Transform, Load) richiede la trasformazione dei dati prima del caricamento nel warehouse. Questo processo è fragile; qualsiasi modifica alla logica di trasformazione richiede di reingegnerizzare l’intera pipeline.

Le architetture moderne cloud-native privilegiano ELT (Extract, Load, Transform). Con questo pattern, i dati grezzi vengono caricati direttamente prima nel data lake o nel warehouse. Le trasformazioni vengono eseguite successivamente, all’interno del repository, sfruttando le risorse di calcolo scalabili della piattaforma.

Il passaggio a ELT è un cambiamento architetturale strategico, non solo tecnico. Disaccoppia l’ingestion dei dati dal data modeling, consentendo maggiore agilità. I dati grezzi vengono preservati e team diversi possono applicare le proprie trasformazioni per vari casi d’uso senza interrompere la pipeline di ingestion principale.

Questo disaccoppiamento è un principio fondamentale di un’architettura componibile, che evita soluzioni monolitiche e legate a un singolo vendor a favore di componenti specializzati e interoperabili.

Lo stack analytics componibile

Uno stack componibile tratta ogni funzione—ingestion, storage, transformation, visualization—come un servizio sostituibile connesso tramite API ben definite. Questo approccio riduce il rischio di vendor lock-in e consente di scegliere per ogni attività il miglior strumento della categoria. Uno stack moderno tipico include:

- Data Connectors: Strumenti come Fivetran o Airbyte gestiscono la “E” e la “L” di ELT, acquisendo in modo affidabile dati da centinaia di sorgenti nel repository centrale.

- Transformation & Orchestration: Framework come dbt e Airflow gestiscono la “T”, pianificando ed eseguendo workflow complessi di trasformazione dati con gestione delle dipendenze e degli errori.

- Visualization Engines: Piattaforme come Tableau, Power BI, o alternative open source come Metabase si connettono ai dati preparati per creare dashboard e report.

Assemblare questi componenti crea un sistema resiliente e adattabile. Se emerge uno strumento di visualizzazione superiore, può essere sostituito senza riorganizzare l’intera pipeline dati. Questa filosofia si allinea con una Service-Oriented Architecture (SOA), uno stile architetturale che riduce i rischi di manutenzione dei sistemi strettamente accoppiati e offre un vantaggio strategico per la scalabilità di lungo periodo.

La decisione strategica Build vs. Buy

Scegliere tra software di business analytics pronto all’uso e una soluzione personalizzata è una decisione critica con implicazioni strategiche di lungo periodo. Definisce il controllo sui dati, la scalabilità operativa e la differenziazione competitiva. La scelta corretta dipende dal vostro contesto specifico, dalle capacità tecniche e dagli obiettivi di business.

Acquistare un abbonamento a una piattaforma offre velocità. Potete collegare le sorgenti dati e distribuire dashboard in pochi giorni. Tuttavia, questa rapidità comporta trade-off: vendor lock-in, spese operative ricorrenti e limiti di personalizzazione. I workflow di business devono conformarsi alle capacità dello strumento.

Costruire una soluzione personalizzata offre piena proprietà e controllo. Il sistema può essere progettato con precisione in base alla vostra logica di business unica, alla vostra postura di sicurezza e ai vostri modelli dati. Questo percorso richiede un investimento iniziale significativo in ingegneria e un impegno a lungo termine per manutenzione, sicurezza ed evoluzione. Non è un progetto; è un prodotto con un ciclo di vita.

Domande chiave di valutazione

Un’analisi superficiale in questa fase porta spesso a costruire una soluzione che avrebbe dovuto essere acquistata, oppure ad acquistare uno strumento che genera più attrito di quanto ne risolva. È necessaria una valutazione pragmatica.

Considerate queste domande:

- L’analytics è un elemento differenziante core del business? Se il vostro metodo di analisi dei dati fornisce un vantaggio competitivo unico, potrebbe essere necessario sviluppare una soluzione personalizzata per proteggere quella proprietà intellettuale.

- Quanto sono specializzati i nostri dati e workflow? Gli strumenti standard eccellono con dati standard. Se i vostri processi implicano trasformazioni complesse e specifiche del dominio, una soluzione custom potrebbe essere più efficiente nel lungo periodo.

- Quali sono i nostri requisiti di compliance e data residency? Per organizzazioni che gestiscono dati sensibili sotto regolamenti come GDPR, NIS2 o DORA, una soluzione personalizzata offre controllo granulare su posizione dei dati, elaborazione e sicurezza, garantendo una compliance verificabile.

- Qual è la nostra reale capacità e competenza ingegneristica? Siate onesti riguardo alla capacità del vostro team di costruire e mantenere una piattaforma dati complessa. Non è un progetto secondario; richiede ownership dedicata e competenze specialistiche.

La decisione dipende dal fatto che stiate risolvendo un problema generico o uno unico. Per dashboard aziendali standard, acquistare è quasi sempre la scelta corretta. Se le esigenze di analytics sono inseparabili dalla proposta di valore core del vostro prodotto, costruire diventa un imperativo strategico.

Scenari che illustrano la scelta

Considerate due scenari. Una startup in fase seed deve validare rapidamente il product-market fit. Per loro, acquistare uno strumento pronto all’uso è la scelta logica. Consente di concentrare le scarse risorse ingegneristiche sul prodotto core, ottenendo al contempo metriche essenziali di utilizzo.

Confrontatelo con un’azienda enterprise del settore dei servizi finanziari che costruisce un sistema predittivo di rilevamento frodi utilizzando modelli di rischio proprietari. I requisiti di sicurezza, la necessità di un controllo totale dei dati e gli algoritmi unici rendono una soluzione personalizzata, basata su AI, l’unica strada percorribile. Costruire una piattaforma su misura è un’impresa seria, e la nostra guida su come costruire software custom senza creare problemi futuri offre una prospettiva architetturale più approfondita.

I trade-off sono significativi. La tabella seguente fornisce un confronto pragmatico.

Build vs. Buy: un confronto pragmatico

| Considerazione | Costruire software personalizzato | Acquistare software pronto all’uso |

|---|---|---|

| Costo iniziale e tempo | Elevato investimento iniziale di capitale nello sviluppo; da mesi ad anni. | Costo iniziale basso (abbonamento); da giorni a settimane per l’implementazione. |

| Costo totale di proprietà | Spese operative continue per manutenzione, hosting e stipendi degli sviluppatori. | Canoni di abbonamento prevedibili ma perpetui che scalano con l’utilizzo. |

| Personalizzazione | Illimitata. Adattata con precisione a workflow e logiche di business unici. | Limitata. I workflow devono adattarsi alle funzionalità e ai vincoli dello strumento. |

| Vantaggio competitivo | Alto potenziale. Può essere un differenziatore core e proprietà intellettuale. | Basso. È probabile che i concorrenti usino gli stessi o strumenti simili. |

| Controllo e sicurezza | Controllo completo sui dati, sull’architettura di sicurezza e sull’implementazione della conformità. | Dipende dalla postura di sicurezza e dalle politiche sui dati del vendor. |

| Onere di manutenzione | Il tuo team è responsabile di tutti gli aggiornamenti, correzioni di bug, patch di sicurezza e uptime. | Il vendor si occupa di tutta la manutenzione, degli aggiornamenti e del supporto. |

Nessuno dei due percorsi è intrinsecamente superiore; servono obiettivi strategici diversi.

Questo contesto è particolarmente rilevante nei mercati maturi. Il Nord America, ad esempio, è destinato a rappresentare una quota del 38% del mercato globale del software di business analytics per le imprese nel 2025. Si prevede che il mercato della regione raggiungerà i 57,0 miliardi di USD quell’anno, mentre le aziende trasformano i log delle prestazioni dei sistemi in insight in grado di migliorare l’efficienza operativa fino al 30%. Puoi scoprire ulteriori approfondimenti sul mercato dell’analytics aziendale da SkyQuest. Questa crescita evidenzia il valore strategico attribuito ai dati, rendendo la decisione build vs. buy più critica che mai.

Integrazione dell’IA per l’analytics predittivo e prescrittivo

La business intelligence standard risponde a domande storiche: “Quali sono state le vendite del trimestre scorso?” Il vantaggio strategico, però, deriva dalla capacità di prevedere. Integrare l’intelligenza artificiale nel tuo software di business analytics consente questa transizione dal reporting storico agli insight predittivi e prescrittivi.

Si tratta di una decisione ingegneristica deliberata per andare oltre l’analytics descrittivo (“cosa è successo”) verso gli ambiti più preziosi dell’analytics predittivo (“cosa probabilmente succederà”) e prescrittivo (“cosa dovremmo fare al riguardo”). Un approccio ingenuo, come collegare direttamente un chatbot a un database, è un anti-pattern che introduce rischi inaccettabili legati a prestazioni, sicurezza e accuratezza dei dati.

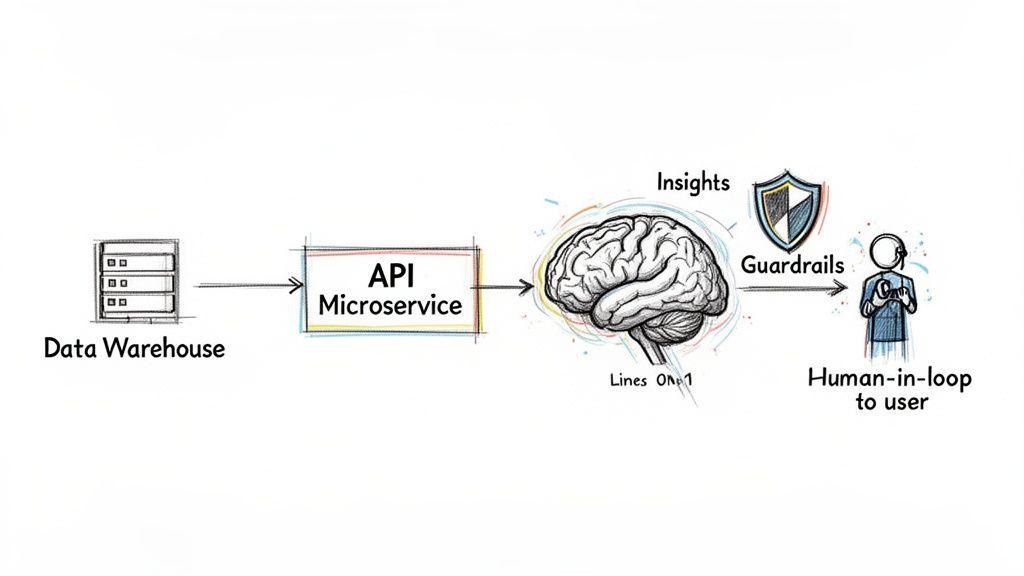

Un’integrazione IA robusta richiede un’architettura studiata con attenzione. I modelli IA devono essere trattati come servizi che richiedono la stessa disciplina ingegneristica, sicurezza e monitoraggio di qualsiasi altro componente del tuo stack tecnologico. Questo approccio garantisce affidabilità, gestisce i costi e mantiene il controllo sui dati.

Pattern pratici di integrazione IA

Diversi pattern architetturali forniscono una solida base per integrare l’IA in un flusso di lavoro di analytics. Questi pattern danno priorità a manutenibilità, scalabilità e governance, evitando le insidie di sistemi monolitici e strettamente accoppiati.

Un pattern comune ed efficace utilizza microservizi guidati da API per servire i modelli IA. La piattaforma di analytics comunica con un modello tramite un endpoint API ben definito, disaccoppiando il ciclo di vita del modello dal front end dell’analytics. Ciò consente ai team di data science di riaddestrare e distribuire nuove versioni del modello senza interrompere l’applicazione rivolta agli utenti.

Le implementazioni pratiche includono:

- Query in linguaggio naturale: Un LLM può essere integrato per tradurre domande in linguaggio semplice—ad esempio, “Mostrami i nostri primi dieci clienti per fatturato nell’UE il mese scorso”—in query SQL precise. Ciò richiede un’attenta progettazione dei prompt e un livello di validazione per prevenire l’esecuzione di query errate o malevole.

- Rilevamento delle anomalie: I modelli di serie temporali possono essere distribuiti per monitorare in modo proattivo lo stato del sistema o i KPI aziendali. Un’API può ricevere un flusso di metriche (ad esempio, i tempi di risposta dell’applicazione) e attivare un allarme al rilevamento di una deviazione dai pattern normali, consentendo un’azione preventiva.

- Workflow agentici: Un agente IA automatizzato può eseguire analisi dei dati in più fasi. Ad esempio, a un agente potrebbe essere assegnato il compito di indagare su un calo delle vendite recuperando prima i dati di vendita, poi incrociandoli con i dati delle campagne di marketing e infine riassumendo i risultati in un report strutturato.

L’obiettivo è incorporare l’intelligenza all’interno di un sistema affidabile e tollerante ai guasti. Ciò significa progettare per il fallimento, con fallback chiari, monitoraggio e validazione per garantire che, se un modello fallisce o restituisce un risultato non valido, il sistema lo gestisca con grazia senza compromettere l’integrità dei dati o la sicurezza.

Governance e guardrail: una base non negoziabile

L’IA introduce nuovi vettori di rischio. Un LLM senza vincoli collegato ai tuoi dati può allucinare risposte errate, esporre informazioni sensibili o generare costi significativi attraverso chiamate API eccessive. La governance è quindi una disciplina ingegneristica critica, non un ripensamento amministrativo.

Implementare guardrail robusti è la prima linea di difesa. Questi includono controlli tecnici come la validazione degli input per rifiutare query fuori ambito e filtri sui contenuti per impedire l’elaborazione o l’esposizione di informazioni personali identificabili (PII). Questo definisce un confine operativo rigoroso per l’IA.

Un processo di validazione human-in-the-loop (HITL) è essenziale per le decisioni critiche. Se un modello raccomanda una modifica significativa dei prezzi, tale raccomandazione non deve essere eseguita automaticamente. Deve invece essere segnalata per la revisione da parte di un esperto umano, che può applicare il contesto di business e fornire l’approvazione finale. Questo crea un ciclo di feedback vitale per il miglioramento del modello.

Infine, un rigoroso monitoraggio dei costi e il rate limiting sono controlli operativi essenziali. Impediscono che una query automatizzata o un loop logico generino una fattura inaspettatamente elevata dal tuo fornitore di servizi IA.

La tua roadmap di implementazione e il framework di governance

Distribuire software di business analytics è un programma strategico che richiede una roadmap chiara e una governance solida, non un progetto tecnico una tantum. Il lancio “big bang”—costruire un sistema massiccio e all-in-one in isolamento—è un approccio ad alto rischio, noto per sforamenti di budget, ritardi nelle scadenze e un prodotto finale che non riesce a risolvere i problemi aziendali previsti.

Una strategia migliore è adottare una mentalità product, dando priorità alla consegna incrementale di valore di business. Questo approccio in fasi mitiga il rischio, accelera il ritorno sull’investimento e costruisce la fiducia degli stakeholder.

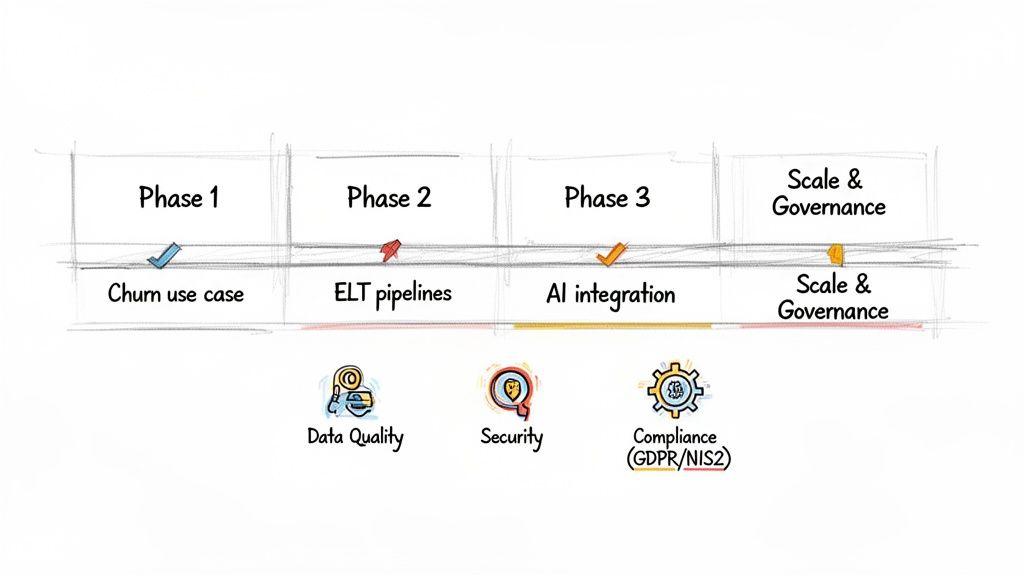

Il rilascio in fasi: un approccio pragmatico

Inizia con un singolo caso d’uso ad alto impatto per dimostrare rapidamente il valore e stabilire una pipeline dati di base. Concentrando gli sforzi ingegneristici su un problema ben definito, puoi offrire risultati tangibili rapidamente. Un punto di partenza comune è l’analisi del churn dei clienti, poiché ha un impatto diretto e misurabile sul fatturato.

- Fase 1: realizzare un caso d’uso core: Concentrati sulla costruzione della pipeline dati necessaria per tracciare il churn. Questo comporta l’identificazione delle fonti dati (ad esempio, database degli abbonamenti, log delle attività degli utenti), l’implementazione di un processo ELT affidabile e la creazione di una dashboard semplice per visualizzare le metriche chiave del churn.

- Fase 2: espandere e arricchire: Una volta dimostrato il ROI, espandi il sistema. Ingestisci nuove fonti dati, come ticket di assistenza clienti o dati di engagement marketing, per arricchire l’analisi del churn e passare dal monitoraggio di cosa sta accadendo alla comprensione del perché.

- Fase 3: introdurre analytics avanzati: Con una solida base dati, integra modelli predittivi. Un modello potrebbe prevedere quali clienti sono ad alto rischio di abbandono, consentendo interventi proattivi da parte dei team di customer success.

- Fase 4: scalare e standardizzare: Replicare questo successo in altri ambiti di business. Applica l’architettura e i principi di governance già definiti per affrontare altri problemi, come l’attribuzione marketing o l’efficienza operativa, costruendo progressivamente una piattaforma di analytics completa.

Questa roadmap iterativa garantisce che ogni fase del progetto sia ancorata alle esigenze di business e produca risultati misurabili.

Costruire la governance fin dal primo giorno

La governance non è burocrazia; è il framework che garantisce che i dati siano accurati, sicuri e utilizzati in modo responsabile. Progettarla fin dall’inizio previene il debito tecnico e i fallimenti di conformità. Trattare la governance come un ripensamento porta a una “palude di dati”—un repository pieno di informazioni inaffidabili e inutilizzabili.

I pilastri chiave di un framework di governance solido includono:

- Gestione della qualità dei dati: Implementa controlli automatizzati e regole di validazione all’interno delle pipeline dati per rilevare incoerenze, duplicati ed errori prima che corrompano le analisi downstream.

- Controllo degli accessi: Implementa il controllo degli accessi basato sui ruoli (RBAC) per garantire che gli utenti possano accedere solo ai dati che sono autorizzati a visualizzare. Questo è fondamentale per la sicurezza e la privacy by design.

- Conformità by design: Progetta il sistema fin dal primo giorno per soddisfare requisiti normativi come GDPR, NIS2 e DORA. Ciò include tecniche di anonimizzazione dei dati, policy di conservazione dei dati verificabili e log immutabili degli accessi ai dati.

La governance dovrebbe essere automatizzata e integrata nella tua architettura. I controlli manuali sono fragili e non scalano. L’obiettivo è rendere il comportamento conforme la strada di minor resistenza per tutti i team.

Il contesto globale rafforza questa esigenza. La regione Asia-Pacifico è il mercato in più rapida crescita per il software di business analytics per le imprese, trainata dalla rapida digitalizzazione. La transizione alla BI cloud, che nel 2025 deteneva una quota di mercato del 53% a livello globale, sta accelerando in quella regione. Le società di servizi IT indiane, ad esempio, stanno utilizzando l’analytics per automatizzare i workflow, riducendo i tempi di implementazione del 25% mentre gestiscono petabyte di dati. Questa rapida espansione sottolinea che un solido framework di governance è essenziale per una crescita sostenibile.

Costruire questo framework richiede standard chiari. Per una guida pratica, consulta la nostra guida alla creazione di un Codice di condotta per i team di engineering e AI. Una roadmap di implementazione ben definita, abbinata a un modello di governance robusto, trasforma un’iniziativa di analytics da progetto ad alto rischio in un motore affidabile per le decisioni strategiche.

Dai dati azionabili alle decisioni strategiche

Il principale insegnamento è che il software di business analytics non è uno strumento di commodity, ma un sistema strategico che richiede un’engineering intenzionale. Il percorso dai dati grezzi a una decisione sicura si basa su scelte architetturali deliberate, ciascuna con compromessi materiali in termini di costo, affidabilità e sicurezza.

Un approccio superficiale—trattare l’analytics come un esercizio di dashboarding dell’ultimo minuto—porta inevitabilmente a sistemi fragili e inaffidabili che generano più confusione che chiarezza. L’approccio corretto inizia con una moderna architettura dati progettata per supportare le tue specifiche esigenze operative e strategiche.

I pilastri di un sistema resiliente

Il prossimo passo critico è una valutazione rigorosa della decisione build vs. buy. Questa scelta determina il controllo sui tuoi dati, la capacità di personalizzazione e il costo totale di proprietà. Allo stesso modo, l’integrazione dell’IA richiede un focus su governance e affidabilità per fornire vera intelligenza, non solo rischio.

Adottare un piano di implementazione iterativo e orientato al valore consente di dimostrare rapidamente il ROI ed evita la comune modalità di fallimento “big bang”. Questo approccio incrementale è ciò che trasforma i dati da asset passivo a motore attivo delle decisioni strategiche.

Pensare in modo critico a questi pilastri—architettura, build vs. buy, governance dell’IA e implementazione in fasi—è ciò che distingue una semplice raccolta di grafici da un motore resiliente e scalabile per la crescita. Basando la tua strategia di analytics su questi principi ingegneristici pragmatici, costruisci un sistema che fornisce insight di cui ci si può fidare. Questa base consente alla tua organizzazione di agire con sicurezza, trasformando dati complessi in un chiaro vantaggio competitivo. In definitiva, un sistema di analytics ben progettato diventa il sistema nervoso centrale di un business data-driven, abilitando decisioni più rapide e più intelligenti a ogni livello.

Domande Frequenti

Risposte dirette alle domande più comuni dei leader tecnici che valutano o implementano software di business analytics.

Come Possiamo Garantire la Qualità dei Dati su Più Sorgenti?

I problemi di qualità dei dati sono una delle principali cause di fallimento dei progetti di analytics. La soluzione è architetturale, non manuale.

Per prima cosa, integra controlli di validazione e qualità dei dati direttamente nelle tue pipeline ELT. Strumenti come dbt (Data Build Tool) ti permettono di definire e automatizzare test per valori nulli, tipi di dato errati o outlier durante il processo di trasformazione. In secondo luogo, stabilisci un chiaro modello di ownership dei dati in cui team specifici siano responsabili della qualità dei dati dei rispettivi domini.

Questa combinazione di validazione automatizzata e responsabilità umana produce dati affidabili.

Qual È Il Rischio Di Sicurezza Più Comune Da Evitare?

L’errore più pericoloso e comune è concedere agli strumenti di visualizzazione l’accesso diretto a un database di produzione. Questo anti-pattern crea un percorso diretto verso dati sensibili, aggira i controlli di sicurezza e può causare un grave degrado delle prestazioni dei sistemi operativi.

Un’architettura sicura collega gli strumenti di analytics esclusivamente a un data warehouse o data mart dedicato, in sola lettura. All’interno del warehouse, implementa il controllo degli accessi basato sui ruoli (RBAC) e il mascheramento dei dati per garantire che gli utenti accedano solo ai dati che sono autorizzati a vedere. Questo approccio isola i carichi di lavoro di analytics e integra la sicurezza by design.

Concedere agli strumenti di business intelligence l’accesso diretto a un database di produzione è un anti-pattern architetturale. Collega direttamente le tue analytics alle operazioni, introducendo vulnerabilità di sicurezza e degrado delle prestazioni difficili da districare in seguito.

Come Gestiamo I Costi Dell’Integrazione Dell’AI?

Per le analytics basate sull’AI, i principali fattori di costo sono il consumo delle API e le risorse di calcolo per l’addestramento dei modelli. Per controllare questi costi, implementa limiti rigorosi di rate limit e avvisi di budget su tutte le API dei servizi AI di terze parti. Questo evita che uno script fuori controllo generi una fattura enorme e inattesa.

Per i modelli personalizzati, concentrati su un preprocessing efficiente dei dati e sulla selezione della dimensione del modello appropriata per il compito: modelli più grandi non sono sempre migliori e comportano costi più elevati. Infine, implementa strategie di caching. Archiviare e riutilizzare i risultati di query frequenti o costose è una tecnica semplice ma efficace per ridurre le chiamate API ridondanti e gestire le spese operative.

In Devisia, progettiamo e costruiamo software di business analytics affidabili e manutenibili e sistemi abilitati all’AI progettati attorno ai tuoi flussi di lavoro. Ti aiutiamo a trasformare dati complessi in un chiaro vantaggio strategico. Scopri come possiamo aiutarti a costruire una piattaforma di analytics resiliente.