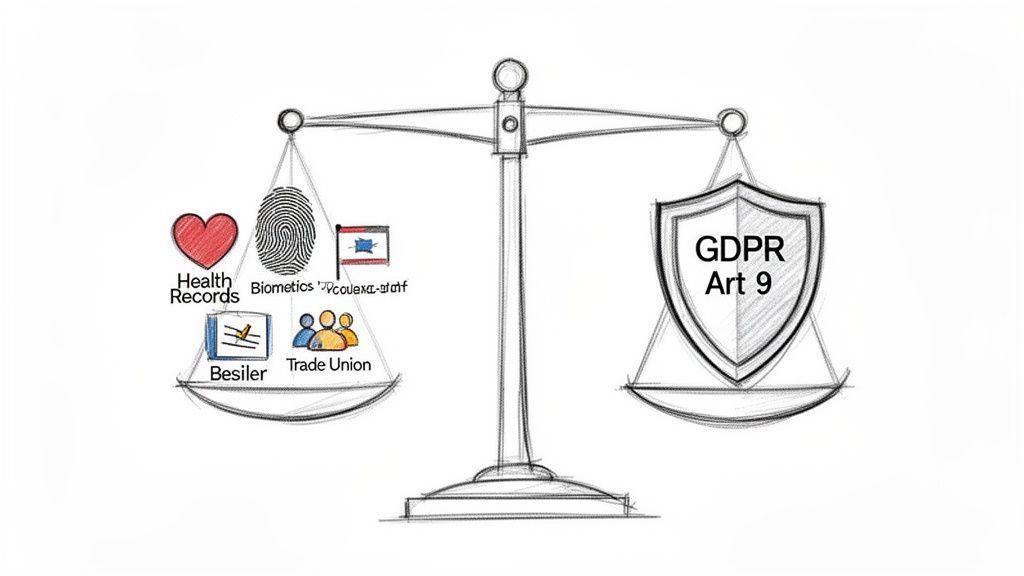

Se c’è una parte del GDPR che richiede l’attenzione dei responsabili tecnologici, è l’Articolo 9. Regola ciò che il regolamento definisce «categorie particolari di dati»—le informazioni personali più sensibili che un sistema possa trattare.

Per qualsiasi software, e in particolare per i sistemi di AI, un uso improprio di questi dati non è semplicemente una questione di conformità; è una minaccia diretta alla fattibilità del prodotto e alla reputazione dell’azienda.

Il problema: l’alto rischio dei dati appartenenti a categorie particolari

Per fondatori, CTO e responsabili di prodotto, comprendere l’Articolo 9 non è una formalità legale da delegare del tutto. È un vincolo architetturale fondamentale. Costruire un sistema che tratti questi dati senza una strategia chiara e difendibile spesso porta a prodotti non conformi per progettazione, costringendo a costose riprogettazioni o esponendo l’azienda a rischi regolatori significativi.

La sfida centrale è che l’Articolo 9 opera sul principio del divieto per impostazione predefinita. Il punto di partenza è che sei vietato dal trattare questi dati. Puoi procedere solo se soddisfi una delle poche condizioni specifiche e strettamente definite. Questo inverte il modello tipico di trattamento dei dati e impone obblighi rigorosi sin dall’inizio.

Cosa sono le categorie particolari di dati?

Le categorie particolari di dati si distinguono perché la loro esposizione non autorizzata potrebbe avere un impatto grave sui diritti e sulle libertà fondamentali di una persona. È la differenza tra conoscere l’indirizzo di spedizione di un utente e conoscere la sua diagnosi medica.

L’Art. 9 del GDPR fornisce un elenco specifico di ciò che costituisce categorie particolari di dati.

| Categoria di dati | Definizione e contesto software |

|---|---|

| Origine razziale o etnica | Dati che rivelano l’origine di una persona. Possono essere dedotti nell’analisi dei profili utente o in strumenti di monitoraggio della diversità. |

| Opinioni politiche | Informazioni sulle opinioni politiche di una persona. Spesso presenti in analisi del sentiment sui social media o in piattaforme di sondaggi. |

| Credenze religiose o filosofiche | Dati sul sistema spirituale o di credenze di un individuo. Possono emergere in forum comunitari o nei questionari di app lifestyle. |

| Appartenenza a sindacati | Informazioni che confermano l’appartenenza a un sindacato. Direttamente rilevante per sistemi HR e di payroll. |

| Dati genetici | Dati derivanti dall’analisi del DNA. Utilizzati in health-tech, servizi genealogici e piattaforme di ricerca biomedica. |

| Dati biometrici per l’identificazione | Dati impiegati per l’identificazione univoca (es. impronte digitali, scansioni facciali). Comuni in sistemi di sicurezza, autenticazione e controllo degli accessi. |

| Dati relativi alla salute | Informazioni sulla salute fisica o mentale, inclusa la storia medica e i trattamenti. Il nucleo di qualsiasi app health-tech o di benessere. |

| Dati relativi alla vita sessuale o all’orientamento sessuale | Informazioni private sulla vita personale di un individuo. Possono essere dedotte o raccolte in app di incontri o piattaforme social. |

Un approccio ingenuo o superficiale comporta un rischio significativo. Per esempio, uno strumento HR apparentemente innocuo che analizza il morale del team potrebbe involontariamente dedurre condizioni di salute o simpatie sindacali, ricadendo l’intero sistema sotto la rigorosa portata dell’Articolo 9.

Il punto critico per qualsiasi responsabile tecnico è questo: l’Articolo 9 ti obbliga a trattare certi dati come altamente sensibili. Devono essere identificati, isolati e gestiti con misure tecniche e organizzative specifiche, supportate da una giustificazione esplicita e legalmente valida. Un approccio “prima processa, poi chiedi” è una ricetta per la non conformità.

Le implicazioni aziendali della non conformità

La mancata conformità all’Articolo 9 va oltre le sanzioni, che possono arrivare fino a 20 milioni di euro o al 4% del fatturato annuo globale. Erode la fiducia dei clienti e può rendere un prodotto invendibile nell’UE. Un prodotto SaaS che elabora dati sanitari senza una base giuridica valida, come il consenso esplicito, è fondamentalmente non conforme.

Questa guida fornisce una roadmap pragmatica per team di ingegneria e prodotto. Suddivideremo come identificare questi dati nel software reale, spiegheremo le basi legali per il loro trattamento e presenteremo pattern architetturali per costruire sistemi conformi.

Identificare le categorie particolari di dati nei vostri sistemi

Conoscere le definizioni dell’Articolo 9 del GDPR è una cosa; identificare categorie particolari di dati in un ambiente software live è un’altra. Per ingegneri e product manager, questo non è un’astrazione legale. Si tratta di riconoscere dati ad alto rischio che scorrono attraverso le vostre API, risiedono nei vostri database o vengono elaborati dai vostri modelli AI—spesso senza un chiaro etichetta “sensibile”.

Un approccio superficiale, che presuma che i dati non siano “particolari” a meno che non siano esplicitamente taggati, è un rischio di conformità significativo. I vostri sistemi potrebbero trattare queste informazioni in modo implicito e, ai sensi del GDPR, l’ignoranza non è una difesa.

Casi d’uso ovvi

Alcune applicazioni sono semplici da valutare. Quando la funzione core di un prodotto è costruita attorno a informazioni sensibili, identificare le categorie particolari di dati è la parte facile. La sfida è assicurarsi che l’intera architettura sia progettata per gestirle fin dall’inizio.

- Dati relativi alla salute: Un’app per il benessere che monitora i livelli di stress, i pattern del sonno o l’apporto calorico sta trattando dati sulla salute. Uno strumento diagnostico AI che analizza immagini mediche rientra pienamente nell’Art. 9.

- Dati biometrici per l’identificazione: Questo include il motore di riconoscimento facciale per un sistema di login o un’API per lo scanner di impronte digitali integrata per l’autenticazione. Qualsiasi sistema che utilizzi tratti fisici o comportamentali univoci per identificare una persona sta trattando dati biometrici.

- Dati genetici: Una piattaforma che offre approfondimenti sull’ascendenza o un servizio B2B che fornisce report sanitari da analisi del DNA sta trattando direttamente dati genetici.

Il rischio nascosto dei dati dedotti

La vera sfida architetturale nasce dai dati che diventano categorie particolari tramite l’inferenza. Un sistema potrebbe non chiedere direttamente informazioni sensibili ma dedurle da altri punti dati apparentemente innocui. Questo è un punto cieco comune per molti team tecnici.

Un modello AI che analizza contenuti generati dagli utenti non ha bisogno di un campo “opinione politica” per classificare gli individui. Elaborando testi da forum o recensioni di prodotto, può inferire le inclinazioni politiche, le credenze religiose o persino lo stato di salute di una persona.

Quell’atto di inferenza è trattamento di categorie particolari di dati. Attiva gli stessi rigorosi requisiti dell’Art. 9 del GDPR come se aveste raccolto l’informazione in modo esplicito.

Scenari reali

Per costruire sistemi robusti e conformi, i team tecnici devono essere formati per identificare queste situazioni meno ovvie. Considerare come i dati possono essere combinati o analizzati è una parte critica della privacy by design.

- Una SaaS per la gestione delle comunità: Se la vostra piattaforma permette agli utenti di creare gruppi, uno di questi potrebbe chiamarsi “Local 123 Union Members”. Il vostro sistema sta ora trattando dati relativi all’appartenenza a un sindacato.

- Una funzionalità di analytics in una piattaforma e-commerce: Un algoritmo che segmenta i clienti per abitudini di acquisto potrebbe identificare individui che acquistano testi religiosi o prodotti sanitari specifici, potenzialmente trattando dati su credenze religiose o salute.

- Una piattaforma HR aziendale: Uno strumento che traccia la partecipazione dei dipendenti a eventi potrebbe rivelare chi ha partecipato a eventi Pride LGBTQ+, trattando quindi dati sull’orientamento sessuale.

L’obiettivo è promuovere una mentalità proattiva. Prima di trattare qualsiasi nuovo dataset, ponete la domanda critica: “Questo dato, da solo o combinato con altre informazioni, potrebbe rivelare qualcosa su una persona che rientra nell’Articolo 9 del GDPR?” Rendere questa domanda uno standard nel processo di sviluppo è un passo fondamentale per gestire il rischio.

Trovare una base giuridica per il trattamento

L’Articolo 9 del GDPR inizia con un divieto. Per impostazione predefinita, il trattamento di qualsiasi categoria particolare di dati è vietato. Per farlo legalmente, è necessario stabilire un’eccezione valida dall’elenco specifico dell’Articolo 9(2). Questa è una decisione fondamentale che deve essere presa—e documentata—prima che i vostri sistemi trattino tali dati.

Scegliere una base giuridica errata può invalidare l’intera attività di trattamento, rendendo il vostro sistema non conforme per progettazione. Per la maggior parte dei software e dei sistemi AI, solo poche condizioni sono rilevanti, e ognuna impone requisiti tecnici e organizzativi significativi.

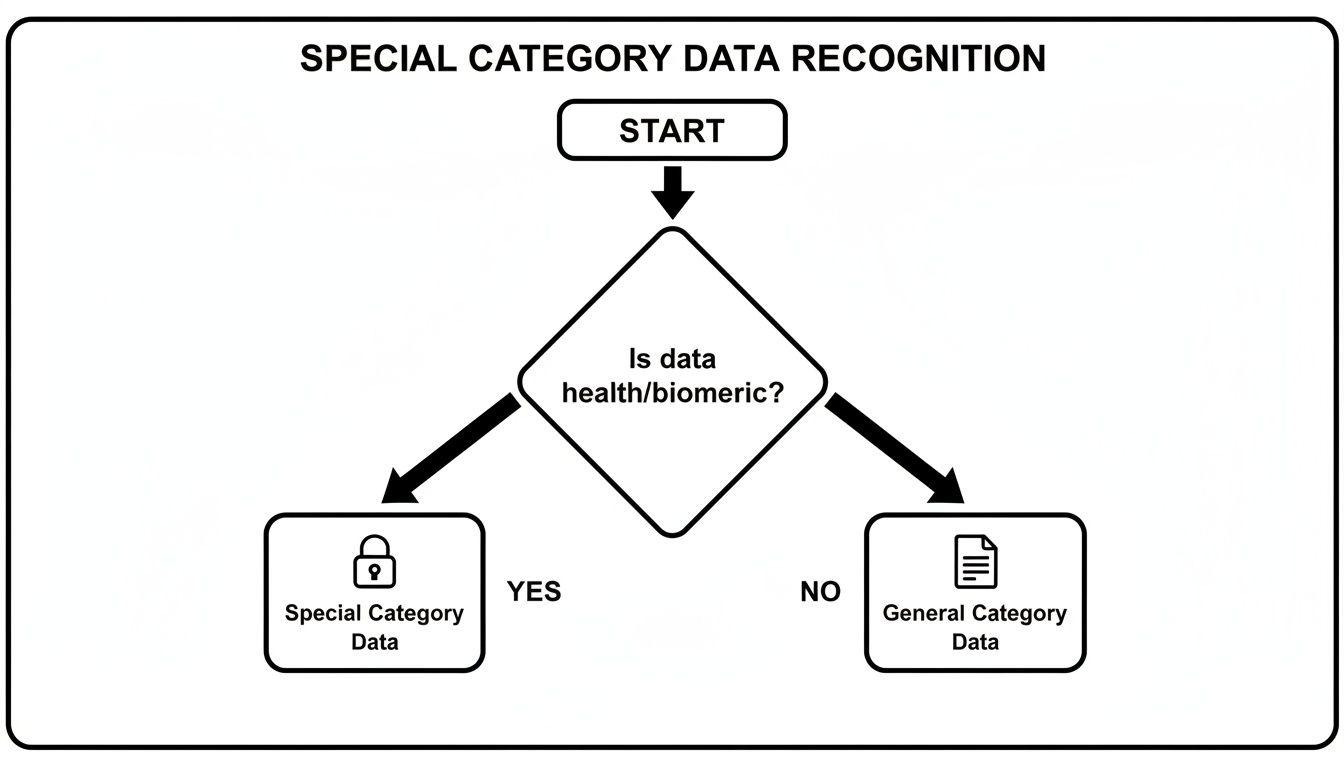

Il primo passo è sempre la classificazione. State davvero trattando categorie particolari di dati? Questo diagramma di flusso aiuta a chiarire quel punto decisionale iniziale e critico.

Una volta che i dati superano quella soglia di “particolare”, l’obbligo è trovare e documentare una condizione specifica e valida ai sensi dell’Articolo 9 per poterli trattare.

Lo standard: il consenso esplicito

Per la maggior parte del software commerciale, la condizione più affidabile e difendibile è il consenso esplicito, come definito nell’Articolo 9(2)(a). Si tratta di uno standard molto più elevato rispetto al consenso usato per le comunicazioni di marketing.

Il consenso esplicito deve essere un’indicazione liberamente prestata, specifica, informata e inequivoca della volontà dell’utente, manifestata mediante un chiaro atto positivo. Deve essere separato dai termini generali ed è tanto facile da revocare quanto da dare.

Questo standard legale si traduce direttamente in requisiti di sistema concreti:

- Scelte granulari: L’interfaccia deve permettere agli utenti di acconsentire a finalità di trattamento specifiche. Per esempio, un’app per il benessere dovrebbe richiedere il consenso separato per l’uso dei dati sulla salute per approfondimenti personali rispetto al loro utilizzo (anche pseudonimizzato) per la ricerca.

- Interfaccia inequivoca: Niente caselle preselezionate o consenso aggregato nei Termini di Servizio. Usate interruttori o caselle di controllo chiare con linguaggio semplice, ad esempio: “Acconsento che i miei dati sul sonno siano utilizzati per alimentare le mie raccomandazioni giornaliere.”

- Facile revoca: Gli utenti devono avere un modo semplice e ovvio per revocare il consenso nelle impostazioni dell’account. Questa azione deve innescare un processo automatizzato per cessare immediatamente tutto il trattamento correlato.

- Registri verificabili: Il sistema deve mantenere un solido registro dei consensi, registrando chi ha dato il consenso, a cosa, quando e come. Deve anche tracciare se e quando quel consenso è stato revocato. Questa è la vostra prova di conformità.

Altre condizioni rilevanti per il software B2B

Sebbene il consenso esplicito sia comune, alcune altre condizioni possono applicarsi in contesti specifici. Devono essere viste come strumenti mirati per compiti specifici, non come alternative più semplici.

- Diritto del lavoro e sicurezza sociale (Articolo 9(2)(b)): Questo consente il trattamento quando è necessario per obblighi legati al diritto del lavoro o alla sicurezza sociale. Una piattaforma HR che elabora i dati sanitari di un dipendente per gestire il congedo per malattia obbligatorio si baserebbe su questa disposizione. Tuttavia, il trattamento deve essere strettamente necessario per un obbligo giuridico specifico. Non può essere usato per giustificare una funzionalità aziendale opzionale di benessere, che probabilmente richiederebbe il consenso esplicito.

- Medicina preventiva o occupazionale (Articolo 9(2)(h)): Questo permette il trattamento per scopi come “medicina preventiva o occupazionale, per la valutazione della capacità lavorativa del dipendente, diagnosi medica, la fornitura di cure sanitarie o sociali…” Questo è un pilastro per l’health-tech. Il vincolo critico è che tale trattamento deve essere effettuato da—o sotto la responsabilità di—un professionista vincolato all’obbligo del segreto professionale, il che impone requisiti stringenti di controllo degli accessi sulla vostra architettura.

Un errore comune e costoso è l’applicazione errata delle basi giuridiche. Per esempio, “l’interesse legittimo” non è una base valida per il trattamento dei dati appartenenti a categorie particolari. È una condizione prevista dall’Articolo 6 per i dati personali generali, ma non rientra nelle eccezioni approvate dall’Articolo 9.

La scelta della base giuridica determina il design del tuo sistema, dai meccanismi di consenso alle politiche di controllo degli accessi e alle regole sul ciclo di vita dei dati.

Pattern architetturali per software conformi

Avere una base giuridica è un prerequisito; costruire un sistema che la applichi tecnicamente è la sfida ingegneristica. Per CTO e leader tecnici, un sistema conforme non riguarda solo le policy—riguarda l’architettura.

Non puoi trattare i dati di categorie particolari come altri dati utente. Richiedono una gestione, una conservazione e dei controlli di accesso differenti. Questa mentalità—la privacy come scelta architetturale—è l’unico modo per costruire software affidabile e difendibile che gestisca le informazioni coperte dall’Art. 9 del GDPR.

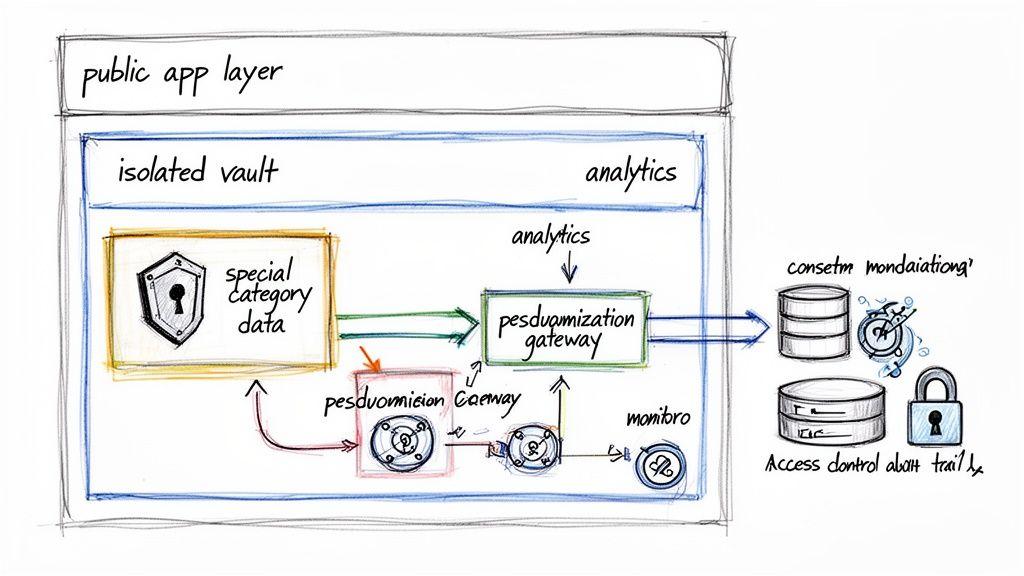

La soluzione: segregazione dei dati e il modello “Vault”

Un pattern architetturale robusto per gestire dati sensibili è la segregazione dei dati, spesso implementata come un “data vault”. Invece di permettere che informazioni sensibili si mescolino con i dati utente generali, le isoli in un database o servizio separato e fortificato.

Questo vault ha regole rigorose:

- Archiviazione isolata: il vault dovrebbe essere uno schema di database distinto o un’istanza di database separata. Questo crea una barriera fisica o logica, minimizzando il raggio d’azione se un’altra parte del sistema viene compromessa.

- API minimaliste: l’accesso è concesso tramite un set limitato di API progettate per esporre solo ciò che è assolutamente necessario. Questi endpoint non dovrebbero restituire dati sensibili grezzi a meno che non vi sia uno scopo specifico e autorizzato.

- Controlli di accesso rigorosi: solo un numero ristretto di servizi o ruoli altamente privilegiati possono accedere al vault. I servizi applicativi standard che gestiscono i profili utente non dovrebbero avere credenziali o permessi per vedere questi dati isolati.

- Audit intensivo: ogni operazione di lettura o scrittura che coinvolge il vault è registrata in una traccia di audit immutabile, annotando chi ha accesso a cosa, da dove e perché.

Questo approccio garantisce che anche se una parte meno critica dell’applicazione viene violata, i tuoi dati più sensibili rimangono protetti. Per approfondire, esplora i mezzi di conformità per il software moderno.

Implementare la minimizzazione dei dati in pratica

La minimizzazione dei dati è un principio cardine del GDPR, ma per i dati dell’Articolo 9 è non negoziabile. L’obiettivo è ridurre l’esposizione al rischio conservando solo i dati di cui hai assolutamente bisogno, per il tempo strettamente necessario.

Una tecnica efficace è la pseudonimizzazione. Questo processo sostituisce identificatori personali diretti con un pseudonimo non identificabile.

Distinzione cruciale: la pseudonimizzazione non è anonimizzazione. Con la pseudonimizzazione, i dati originali possono ancora essere ri-identificati usando una chiave separata. Questo riduce il rischio preservando l’utilità dei dati per analisi o addestramento di modelli. La vera anonimizzazione, dove la ri-identificazione è impossibile, è molto più difficile da ottenere e spesso distrugge il valore dei dati.

Da una prospettiva di design dei sistemi, ciò significa che la tua architettura deve:

- Conservare la chiave di mappatura che collega i pseudonimi alle identità reali in un luogo separato e altamente sicuro—idealmente, all’interno del tuo data vault.

- Condurre analisi e attività di machine learning sul dataset pseudonimizzato, non sui dati grezzi identificabili.

- Implementare politiche automatizzate di conservazione che eliminino permanentemente i dati di categorie particolari una volta scaduta la loro base giuridica.

Costruire un sistema gestito di consenso verificabile

Quando la tua base giuridica è il consenso esplicito, il tuo sistema deve essere in grado di provarlo. Questo richiede più di una semplice casella UI; serve un database dedicato e verificabile per la gestione del consenso. Considera questo database come un registro immutabile che registra ogni evento relativo al consenso.

| Tipo di evento | Dati da registrare | Esempio |

|---|---|---|

| Consenso espresso | ID utente, Scopo specifico per cui è stato espresso il consenso, Timestamp, Versione dell’Informativa sulla privacy/Avviso | user_123 ha espresso consenso per health_data_for_recommendations il 2024-10-26T10:00:00Z sotto privacy_policy_v2.1 |

| Consenso revocato | ID utente, Scopo specifico per cui è stata revocata l’autorizzazione, Timestamp | user_123 ha revocato il consenso per health_data_for_recommendations il 2024-11-15T14:30:00Z |

Quando un utente revoca il consenso, questo sistema deve innescare azioni automatiche a valle, come inviare un webhook al tuo data warehouse per eliminare i dati dell’utente o aggiungere il loro ID a una lista “do not process” per futuri addestramenti di modelli. Questa automazione a circuito chiuso è essenziale per rispettare i diritti degli utenti in tempo reale.

Applicato dal 25 maggio 2018, l’Articolo 9 ha rimodellato lo sviluppo software. Il suo impatto è chiaro; studi indicano che dall’implementazione del GDPR, le aziende UE hanno ridotto l’archiviazione e il trattamento dei dati rispetto ai loro omologhi statunitensi, segnalando uno spostamento tangibile verso la minimizzazione dei dati. Puoi approfondire l’impatto del GDPR sui mercati digitali per comprendere queste tendenze.

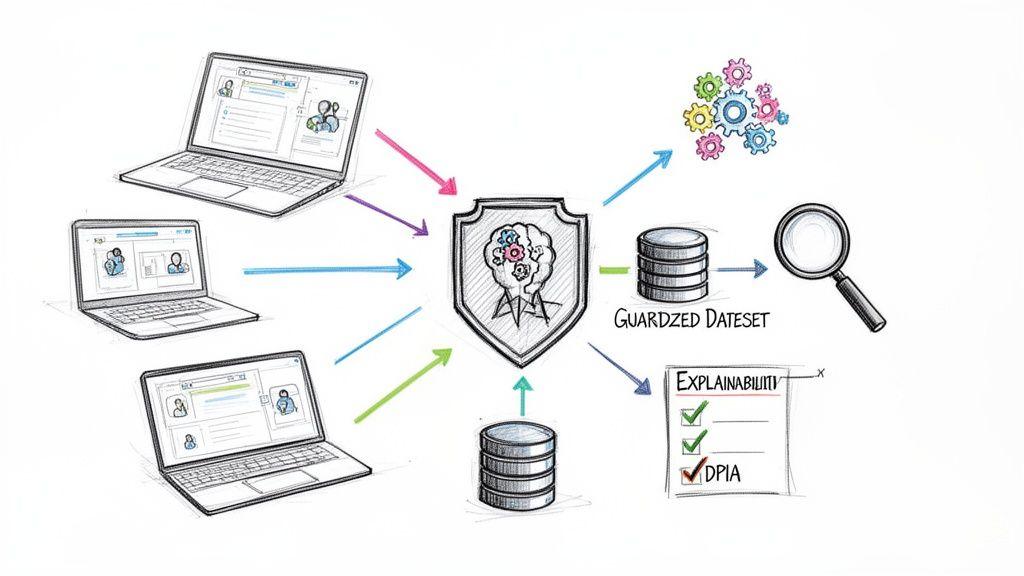

Misure tecniche di protezione per AI e Machine Learning

Quando usi AI e machine learning per trattare dati di categorie particolari, il fattore di rischio aumenta significativamente. Per CTO e ingegneri ML, questo richiede di costruire misure tecniche robuste direttamente nei modelli e nelle pipeline dati. Un approccio ingenuo qui può essere un colpo fatale per il tuo prodotto AI.

Nel momento in cui la tua AI entra in contatto con dati coperti dall’Art. 9 del GDPR, il potenziale di abuso, decisioni discriminatorie e violazioni della privacy diventa molto reale. Le tue pratiche ingegneristiche devono essere altrettanto serie.

Il DPIA: il tuo primo passo obbligatorio

Prima di scrivere codice per addestrare un modello su dati di categorie particolari, devi completare una Data Protection Impact Assessment (DPIA). Questo non è un adempimento opzionale da completare dopo il lancio; è un checkpoint obbligatorio richiesto dal GDPR per qualsiasi trattamento ad alto rischio. L’AI che utilizza dati sensibili è la definizione stessa di alto rischio.

Una DPIA è un processo strutturato per affrontare domande difficili:

- Cosa stiamo esattamente trattando e perché?

- Questo trattamento è necessario e proporzionato?

- Quali sono i rischi per i diritti e le libertà degli interessati?

- Quali misure tecniche e organizzative concrete adotteremo per mitigare tali rischi?

Saltare una DPIA è una violazione diretta del GDPR e segnala ai regolatori una mancanza di impegno serio verso i principi di protezione dei dati. Per approfondire, consulta la nostra guida su come condurre una privacy impact assessment.

Proteggere i dataset di addestramento

I tuoi dati grezzi di addestramento sono una responsabilità significativa. La prima linea di difesa è ridurne la sensibilità senza distruggere l’utilità. Una forte pseudonimizzazione è una salvaguardia pratica ed efficace. Ciò significa sostituire gli identificatori diretti nel tuo dataset di addestramento con hash irreversibili o token casuali.

Un punto architetturale cruciale: la chiave che collega i token agli utenti reali deve essere conservata in un ambiente completamente separato e altamente sicuro. Il tuo ambiente di addestramento ML non dovrebbe mai avere accesso a questa chiave.

Architetture avanzate per la privacy

Per sistemi che trattano le informazioni più sensibili, considera tecnologie che aumentano la privacy (PETs) che limitano l’esposizione dei dati per design.

- Federated Learning: invece di raccogliere tutti i dati su un server centrale, il modello viene addestrato direttamente sul dispositivo dell’utente. Solo gli aggiornamenti del modello vengono inviati indietro, non i dati personali grezzi. Questo mantiene le informazioni sensibili, come metriche sanitarie su un telefono, sotto il controllo dell’utente.

- Differential Privacy: questa tecnica aggiunge “rumore” statistico a un dataset o ai risultati di una query. Permette di ottenere insight aggregati rendendo matematicamente difficile determinare se i dati di un singolo individuo siano stati parte del calcolo.

Questi metodi sono complessi e comportano compromessi in termini di accuratezza del modello e sforzo ingegneristico. Ma per applicazioni ad alto rischio, sono un modo potente e difendibile per dimostrare un impegno alla privacy by design.

Il diritto a una spiegazione

Quando un’AI prende una decisione automatizzata utilizzando dati di categorie particolari—ad esempio valutando un rischio sanitario—quella decisione non può essere una scatola nera. Il GDPR concede agli individui il diritto a informazioni significative sulla logica alla base di queste decisioni.

Questo significa che la spiegabilità del modello non è solo una caratteristica desiderabile; è un requisito di conformità. Il tuo sistema deve essere in grado di fornire una motivazione chiara per il suo output. Costruire strumenti per la spiegabilità deve essere parte integrante del processo di sviluppo ML fin dal primo giorno.

Conclusione: una checklist azionabile

Trasformare l’Art. 9 del GDPR in pratica richiede azioni chiare e pragmatiche. Questa checklist è pensata per founder, CTO e product manager che costruiscono software reale. Non si tratta di spuntare caselle, ma di costruire sistemi affidabili e di fiducia fin dalle fondamenta.

Strategia fondamentale

- Identificare con rigore: Non dare nulla per scontato. Identifica e classifica attivamente qualsiasi dato che potrebbe rientrare nell’Articolo 9, inclusi i dati inferiti.

- Predefinire il consenso esplicito: Per la maggior parte del software commerciale, progetta i tuoi sistemi attorno al consenso esplicito come base giuridica primaria. Non tentare di usare “l’interesse legittimo”—non è una condizione valida ai sensi dell’Art. 9.

- Documentare le decisioni: Mantieni un registro chiaro dei dati che tratti, della tua base giuridica e delle misure di salvaguardia implementate. Questa documentazione è la tua prima linea di difesa in caso di audit.

Azioni architetturali core

- Costruire un “Data Vault”: Isola i dati di categorie particolari tramite segregazione rigorosa usando database o schemi separati con accesso API minimo e controllato e logging intensivo.

- Incorporare la pseudonimizzazione: Rendi la pseudonimizzazione un passaggio predefinito nelle tue pipeline dati per analisi e addestramento di modelli. Proteggi la chiave di ri-identificazione separatamente.

- Automatizzare consenso e conservazione: Implementa un sistema di gestione del consenso verificabile che registra tutti gli eventi relativi al consenso e attiva workflow automatizzati per rispettare le scelte degli utenti e far rispettare le politiche di conservazione dei dati.

Governance per progetti ad alto rischio

- Obbligo di DPIA: Una Data Protection Impact Assessment (DPIA) deve essere il primo passo obbligatorio per qualsiasi nuovo sistema che tratti dati di categorie particolari. Non iniziare lo sviluppo senza di essa.

- Pianificare la spiegabilità: Se usi AI per decisioni automatizzate, costruisci strumenti di spiegabilità del modello fin dal primo giorno per fornire motivazioni chiare agli esiti.

- Revisionare regolarmente: La conformità non è un progetto una tantum. Pianifica revisioni regolari delle tue attività di trattamento dei dati, soprattutto man mano che il prodotto evolve, per garantire che le tue salvaguardie e basi giuridiche rimangano valide.

Integrando questi passaggi, costruirai un quadro robusto per gestire le informazioni sensibili degli utenti. Per uno strumento dettagliato per valutare i tuoi sistemi, considera la nostra checklist gratuita AI Risk & Privacy Checklist.

FAQ Art. 9 del GDPR

I team tecnici spesso affrontano le stesse domande pratiche durante l’implementazione dell’Articolo 9. Ecco risposte dirette alle domande comuni.

Qual è la vera differenza tra anonimizzazione e pseudonimizzazione?

I dati anonimizzati hanno avuto tutti gli identificatori personali rimossi in modo irreversibile, perciò non possono essere ricondotti a un individuo. Rientrano fuori dal campo di applicazione del GDPR. I dati pseudonimizzati sono ancora dati personali. Gli identificatori diretti vengono sostituiti con un sostituto (ad es., un token utente), ma i dati possono essere ri-identificati utilizzando una chiave separata. Questo rende la pseudonimizzazione una tecnica efficace di riduzione del rischio, poiché permette il trattamento dei dati (come l’addestramento di modelli) senza esporre le informazioni personali grezze negli ambienti di sviluppo. La chiave di ri-identificazione deve essere conservata in un luogo separato e altamente sicuro.

Possiamo usare “interesse legittimo” per i dati di categorie particolari?

No. Si tratta di un errore critico e pericoloso.

‘Interesse legittimo’ è una base giuridica per il trattamento dei dati personali generali ai sensi dell’articolo 6. Non si applica ai dati appartenenti a categorie particolari coperti dall’articolo 9. Per trattare dati appartenenti a categorie particolari, è necessario soddisfare una delle condizioni specifiche elencate nell’articolo 9(2), come il consenso esplicito.

Come gestiamo il ritiro del consenso per i modelli di IA?

Quando un utente revoca il consenso, è necessario cessare il trattamento dei suoi dati da quel momento in poi. Al minimo, bisogna segnalarne i dati ed escluderli da qualsiasi futuro addestramento o riaddestramento del modello.

La questione più complessa riguarda i dati già incorporati in un modello addestrato. I regolatori tendono sempre più a considerare l’uso continuato di tali informazioni da parte di un modello come un trattamento in corso. Questo può richiedere la possibilità di riaddestrare il modello da zero, escludendo i dati della persona interessata. La capacità di gestire il ritiro del consenso deve essere una considerazione architetturale fondamentale nella tua strategia MLOps fin dall’inizio.

Building reliable, compliant software requires more than just following rules; it demands a product mindset and a commitment to long-term maintainability. Devisia è specializzata nel trasformare visioni aziendali complesse in prodotti digitali solidi e sistemi abilitati all’IA, con privacy e sicurezza come scelte architetturali fondamentali. Scopri di più sul nostro approccio.