Ad esempio, il gruppo di auto-scaling di produzione potrebbe eseguire dieci grandi istanze, mentre la regione di warm standby opera con sole due istanze piccole. Al momento del failover, il traffico viene reindirizzato e l’infrastruttura standby viene immediatamente scalata per gestire l’intero carico di produzione. Questa transizione è molto più rapida rispetto al Pilot Light perché l’applicazione è già in esecuzione. L’efficienza del recupero cloud-native offre un vantaggio significativo rispetto alle soluzioni on-premise tradizionali. Un’analisi più approfondita di queste differenze architetturali è disponibile nella nostra guida su cloud computing vs on-premise solutions. La capacità di recuperare più rapidamente è uno dei fattori chiave per l’adozione del cloud nelle industrie regolamentate.

Il pattern Hot Standby (Active-Active)

Questo è il livello più alto di resilienza. Un Hot Standby, spesso implementato come architettura active-active o multisito, prevede l’esecuzione di ambienti di produzione su larga scala in due o più regioni geograficamente separate contemporaneamente. Un bilanciatore di carico globale distribuisce il traffico tra di esse, instradando gli utenti verso la località più vicina o più sana.

Se una regione fallisce, il bilanciatore di carico reindirizza automaticamente tutto il traffico alle regioni rimanenti sane. Non è richiesta alcuna intervento manuale.

Un’architettura Hot Standby autentica produce un failover quasi istantaneo che spesso è impercettibile per gli utenti finali. Questo pattern offre il più basso RTO e RPO possibile, tipicamente misurati in secondi.

- Casi d’uso: Essenziale per sistemi mission-critical in cui qualsiasi downtime ha conseguenze gravi, come piattaforme di transazioni finanziarie, sistemi di prenotazione aerea e servizi infrastrutturali core.

- Compromessi: Il vincolo principale è il costo. Questo pattern raddoppia di fatto la spesa infrastrutturale e introduce una significativa complessità operativa, in particolare nel mantenimento della coerenza dei dati tra siti attivi. Tuttavia, per le aziende in cui il costo del downtime è eccezionalmente elevato, questa architettura è un investimento necessario.

Da un piano teorico a una capacità comprovata

Un piano di disaster recovery esistente solo come documento PDF è una passività, non un bene. Durante una crisi reale — un’interruzione regionale o un guasto critico del servizio — la pressione operativa è enorme. In ambienti ad alto stress, le procedure di recupero manuali sono soggette a errore umano, passi mancati o panico.

Per costruire una resilienza genuina, un piano teorico deve essere trasformato in una capacità comprovata e testata. Questa trasformazione si basa su due pilastri: automazione e test rigorosi. Una strategia DR non testata fornisce un falso senso di sicurezza che svanirà nel momento in cui sarà più necessaria.

Automatizzare il recupero con Infrastructure as Code

La base di un processo DR affidabile è Infrastructure as Code (IaC). Aspettarsi che un ingegnere provisioni manualmente server, configuri reti e distribuisca servizi a memoria durante un’interruzione è una ricetta per downtime prolungati e deriva di configurazione.

Strumenti come Terraform, AWS CloudFormation o Azure Resource Manager consentono di definire l’intera infrastruttura in file di configurazione dichiarativi. Questo codice diventa la singola fonte di verità per l’architettura del tuo ambiente di produzione.

Durante un failover, non si segue una checklist di clic sulla console; si esegue uno script. Questo cambia fondamentalmente il processo di recupero:

- Coerenza: L’ambiente di recupero è una replica esatta e priva di errori del sito primario.

- Velocità: Il provisioning di uno stack completo tramite IaC è di ordini di grandezza più veloce rispetto agli sforzi manuali.

- Ripetibilità: L’ambiente può essere smantellato e ricostruito in modo coerente, essenziale per test efficaci.

L’obiettivo è automatizzare il processo di failover al punto che diventi routine. Se la tua procedura di disaster recovery è un evento drammatico che richiede tutti gli sforzi, non è sufficientemente matura.

Costruire runbook eseguibili

I runbook statici in documenti Word diventano rapidamente obsoleti e sono impraticabili durante una crisi. Un runbook moderno ed efficace non è un documento da leggere; è uno script da eseguire. Dovrebbe consistere in una serie di comandi automatizzati, chiamate API e template IaC.

Un runbook solido è un componente vivo del tuo codebase, versionato in Git e aggiornato insieme all’applicazione. Deve coprire l’intero ciclo di vita del failover, dalla decisione di dichiarare un disastro alle verifiche finali di convalida che confermano il ripristino del servizio. Trattare i runbook come codice garantisce che rimangano attuali e siano soggetti agli stessi standard di revisione dell’applicazione stessa. Questo principio di workflow automatizzati e versionati è centrale anche nel nostro approccio alla costruzione di robusti pipeline CI/CD.

La necessità di test rigorosi e regolari

Un piano non testato è un piano inutile. L’unico modo per verificare che una strategia di disaster recovery funzioni è eseguirla. Test regolari scoprono dipendenze nascoste, configurazioni obsolete e assunti errati prima che possano causare guasti durante una vera interruzione.

Tipi di esercitazioni di Disaster Recovery:

- Esercitazioni tabletop: Una simulazione a basso impatto in cui il team percorre verbalmente il runbook passo dopo passo. È un modo efficace per identificare lacune logiche e confermare che i membri del team comprendano i loro ruoli e responsabilità.

- Test di guasto dei componenti: Rompere deliberatamente un componente non critico in un ambiente di recupero isolato. Questo valida che gli script di rilevamento e risoluzione automatizzati funzionino come previsto.

- Esercitazioni di failover completo: Il test definitivo. Consiste nel simulare un guasto regionale completo reindirizzando una porzione del traffico live (o tutto il traffico) al sito standby. Questo è l’unico metodo per convalidare realmente il tuo RTO e RPO in condizioni reali.

Eseguire questi test con una cadenza regolare — trimestralmente per tabletop e test dei componenti, e almeno annualmente per un drill completo — costruisce la “memoria muscolare” di cui il team ha bisogno. Trasforma il disaster recovery da una procedura d’emergenza temuta in una disciplina operativa praticata.

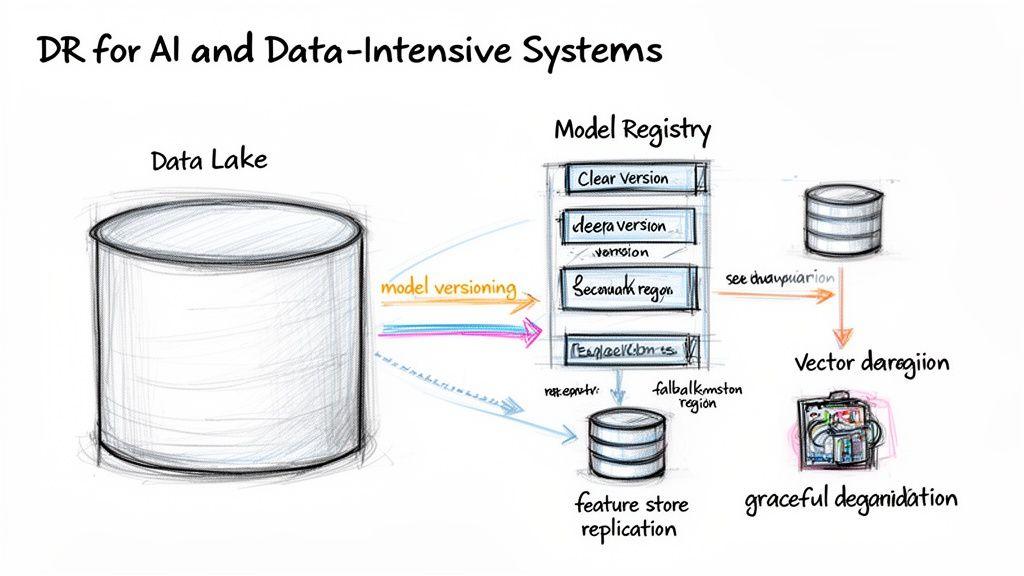

DR per sistemi AI e ad alta intensità di dati

Il problema con i piani di disaster recovery tradizionali è che sono inadeguati per le modalità di guasto uniche dei moderni sistemi AI. Playbook progettati per applicazioni stateless e database standard falliscono quando si confrontano con data lake su scala di petabyte, grandi database vettoriali o repository complessi di modelli ML.

La sfida inizia con il volume dei dati. Tentare di copiare terabyte di dati tra regioni durante una crisi è lento, costoso e poco pratico. Questo crea un RPO inaccettabile e richiede strategie di replica e recupero più sofisticate e native per la piattaforma dati.

Proteggere integrità dei dati e dei modelli

Il rischio maggiore va oltre i dati grezzi e riguarda l’integrità dell’intera pipeline AI. Un recupero di successo non riguarda solo il ripristino dei byte; riguarda l’assicurare che il sistema produca risultati corretti e affidabili dopo il failover. Questo richiede il mantenimento di una sincronizzazione perfetta tra dati applicativi, modelli ML e i dati delle feature usati per l’addestramento.

Una mancata coerenza può risultare in un sistema “recuperato” che produce output insensati, distorti o errati. Per mitigare questo rischio, il piano DR deve affrontare:

- Versionamento e replicazione dei modelli: Il model registry è un componente critico con stato. Deve essere trattato con la stessa importanza del database primario e replicato tra le regioni. Perdere la versione del modello di produzione rende l’applicazione inutilizzabile.

- Coerenza del Feature Store: Lo stato del feature store deve essere sincronizzato con i database applicativi. Qualsiasi deriva può portare a errori di predizione catastrofici dopo un failover.

- Recupero del database vettoriale: Per applicazioni che utilizzano ricerca semantica o Retrieval-Augmented Generation (RAG), il database vettoriale è mission-critical. Il piano di recupero deve garantire che gli embeddings siano perfettamente allineati con i loro contenuti sorgente per evitare di rendere la funzionalità di ricerca inutile.

Costruire resilienza per le dipendenze da API di terze parti

Molte applicazioni AI dipendono da API di terze parti di fornitori come OpenAI, Anthropic o Google, creando una dipendenza critica al di fuori del controllo dell’organizzazione. Un’interruzione presso uno di questi fornitori può disabilitare funzionalità core dell’applicazione.

Una solida strategia DR deve tenere conto di questo rischio legato ai fornitori. Aspettare passivamente che la terza parte risolva il problema non è una strategia.

Fare affidamento su un singolo fornitore AI senza una soluzione di fallback è una vulnerabilità architetturale critica. La domanda non è se l’API avrà un’interruzione, ma cosa farà il tuo sistema quando succederà.

Strategie efficaci per gestire questo rischio di dipendenza includono:

- Implementare circuit breaker: Questo pattern di progettazione rileva automaticamente quando un’API esterna sta fallendo e interrompe temporaneamente le richieste, impedendo che l’applicazione venga sopraffatta dai timeout.

- Progettare per fallback: Progettare il sistema in modo da fare failover a un modello o fornitore alternativo. Se l’API LLM primaria non è disponibile, le richieste possono essere instradate a un modello secondario, anche se con prestazioni leggermente inferiori.

- Degradazione controllata delle funzionalità: Se un fallback non è fattibile, il sistema dovrebbe degradarsi in modo controllato. Invece di mostrare un errore criptico, potrebbe disabilitare temporaneamente la funzionalità AI e notificare l’utente, permettendo al resto dell’applicazione di rimanere funzionante.

Al contrario, l’AI può anche migliorare le capacità di DR. Il machine learning può essere utilizzato per analisi predittive dei guasti e spostamento automatico del carico di lavoro, che è un fattore chiave dietro la crescente analisi di mercato sul disaster recovery basato su cloud.

Queste modalità di guasto uniche sono critiche da affrontare già nella progettazione del sistema. La nostra AI Risk & Privacy Checklist gratuita è stata sviluppata per aiutare i team a identificare e mitigare questi rischi specializzati.

Bilanciare conformità e costi

Per qualsiasi CTO o responsabile della compliance, una strategia di disaster recovery è un artefatto aziendale critico che deve soddisfare sia i regolatori sia il reparto finanziario. Un’architettura tecnicamente robusta ma non conforme o finanziariamente insostenibile è una strategia fallita.

Le normative moderne non suggeriscono soltanto la resilienza; la richiedono. Framework come GDPR, NIS2 e DORA includono requisiti specifici e legalmente vincolanti per la continuità operativa e la protezione dei dati. Un piano DR deve dimostrare la capacità di mantenere la resilienza operativa e proteggere l’integrità dei dati durante un guasto.

Progettare per sovranità dei dati e regolamentazione

La compliance deve essere parte integrante dell’architettura DR, non un ripensamento. Questo richiede un’attenta considerazione della residenza e del trattamento dei dati, anche durante un’emergenza.

- GDPR e sovranità dei dati: I requisiti del GDPR seguono i dati dei cittadini UE ovunque vengano trattati. Un sito di recovery deve garantire lo stesso livello di protezione dei dati del sito primario. Passare a una regione DR fuori dall’UE, per esempio, potrebbe costituire un trasferimento dei dati ad alto rischio e non conforme che attirerà l’attenzione dei regolatori.

- DORA e resilienza operativa: Per il settore dei servizi finanziari, DORA è esplicita. Richiede alle imprese non solo di avere un piano DR ma di testarlo regolarmente per dimostrare che le funzioni aziendali critiche possono essere ripristinate entro tempi predefiniti. Un piano non testato è un piano non conforme.

Un’architettura che esegue il failover verso una regione non conforme non risolve un disastro. Scambia una crisi tecnica con una crisi legale. La strategia di DR deve rispettare i confini geografici e giuridici associati ai dati che protegge.

Gestire i costi cloud in modo sostenibile

Mentre la resilienza è non negoziabile, un’implementazione ingenua può portare a costi cloud insostenibili. Un sito hot-standby che rispecchia l’ambiente di produzione rispecchia anche i suoi costi, raddoppiando di fatto la spesa per l’infrastruttura. La governance finanziaria è essenziale per rendere una strategia di DR sostenibile nel lungo periodo.

Le piattaforme cloud offrono numerosi meccanismi per controllare i costi senza compromettere gli obiettivi di recovery.

Strategie pratiche di ottimizzazione dei costi includono:

- Utilizzare Reserved Instances o Savings Plans: Per le risorse di calcolo che devono funzionare continuamente (come nei modelli Pilot Light o Warm Standby), l’impegno su un piano di uno o tre anni può garantire sconti significativi rispetto ai prezzi on-demand.

- Sfruttare architetture serverless: Quando possibile, utilizzare funzioni serverless (ad es., AWS Lambda o Azure Functions) e servizi gestiti. Questo minimizza il costo delle risorse inattive, poiché si paga solo per l’esecuzione durante un test o un effettivo failover.

- Implementare un rigoroso tagging e monitoraggio: Non puoi controllare ciò che non misuri. Etichetta meticolosamente tutte le risorse correlate al DR per tracciare i loro costi. Configura avvisi di fatturazione per rilevare anomalie di spesa prima che diventino problemi significativi.

La rapida crescita del mercato del Disaster Recovery as a Service (DRaaS) sottolinea la necessità di bilanciare resilienza ed economicità. Il mercato è previsto in forte espansione, trainato dalla domanda di soluzioni efficienti nel cloud pubblico, come dettagliato nelle recenti statistiche e tendenze sul disaster recovery. Questo spostamento dell’industria riflette una tendenza verso soluzioni DR scalabili, conformi e pragmatiche dal punto di vista finanziario.

Costruire la resilienza fin dalla progettazione

Un disaster recovery efficace non è un prodotto aggiuntivo; è una caratteristica intrinseca di un sistema ben progettato. Il processo inizia con una discussione a livello di business per definire il Recovery Time Objective (RTO) e il Recovery Point Objective (RPO). Queste due metriche fungono da vincoli principali per tutte le decisioni tecniche successive, dettando la complessità architetturale, la prontezza operativa e i costi.

Principi fondamentali per un’architettura resiliente

Esiste uno spettro di pattern architetturali — dal Backup and Restore al Hot Standby — per soddisfare questi obiettivi di RTO e RPO, ciascuno con un profilo di costo differente. La scelta corretta è un compromesso deliberato tra il livello di resilienza richiesto e il budget disponibile.

Tuttavia, un pattern scelto è utile solo se dimostrato funzionante. Una strategia di DR efficace deve essere automatizzata con Infrastructure as Code (IaC) e convalidata tramite test regolari e rigorosi. Un piano di DR non testato crea un falso senso di sicurezza funzionalmente equivalente a non avere alcun piano.

Il disaster recovery è una capacità operativa, non un documento statico. Richiede automazione per eliminare l’errore umano sotto pressione e test incessanti per costruire memoria muscolare organizzativa.

Infine, i sistemi moderni presentano sfide uniche. Le applicazioni basate su AI e quelle ad alta intensità di dati richiedono strategie di ripristino specializzate che affrontino la coerenza dei dati, l’integrità dei modelli e le dipendenze da API di terze parti.

La conclusione è chiara: la resilienza deve essere una scelta progettuale consapevole. Richiede l’equilibrio tra un’implementazione tecnica precisa e le realtà pratiche del business, garantendo che i sistemi siano progettati non solo per funzionare, ma per sopravvivere.

At Devisia, aiutiamo le organizzazioni a integrare la resilienza direttamente nella loro architettura software. Se hai bisogno di un partner tecnico per progettare e implementare una strategia di disaster recovery pragmatica, manutenibile e conveniente per i tuoi prodotti digitali, possiamo aiutarti.

Scopri di più sul nostro approccio per costruire sistemi software affidabili su devisia.pro