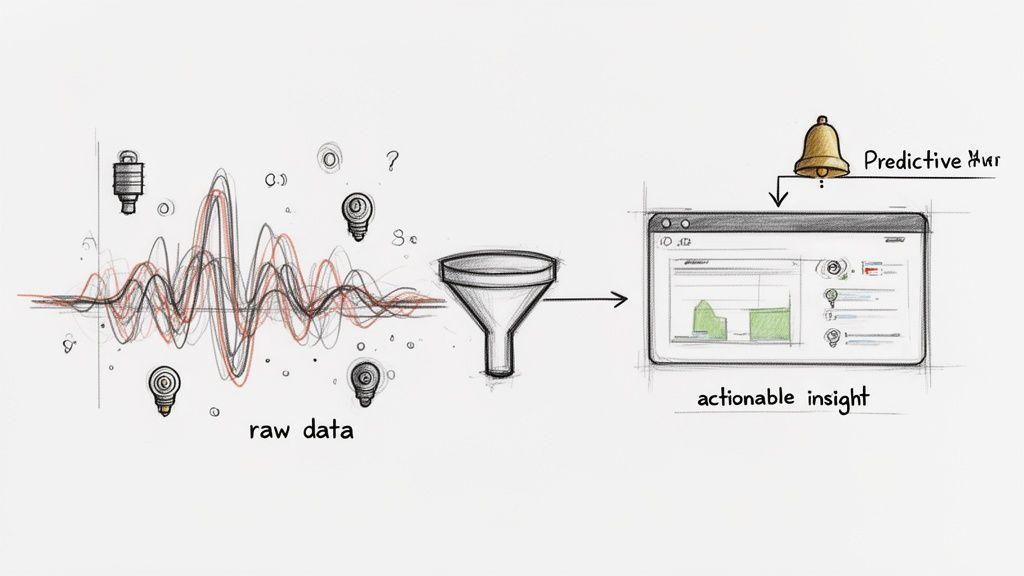

Combinare Intelligenza Artificiale e Internet of Things (AIoT) non significa solo connettere dispositivi; significa incorporare intelligenza in essi. Questo approccio architetturale è ciò che finalmente trasforma l’ondata travolgente di dati grezzi provenienti dall’hardware connesso in insight precisi e azionabili.

Il problema è che l’Internet of Things (IoT) è riuscito a connettere miliardi di dispositivi, ma questo ha generato una nuova sfida: le organizzazioni ora stanno affogando in un torrente di letture dei sensori, log e dati di telemetria. Da soli, questi dati hanno poco valore. Il problema non è mai stato la mancanza di dati; era l’incapacità di estrarne significato.

Una strategia di intelligenza artificiale per l’IoT colma questa lacuna. Integrando modelli di AI in una pipeline di dati IoT, si costruiscono sistemi in grado di apprendere, ragionare e agire con un grado di autonomia. Non si tratta di aggiungere un altro termine alla moda allo stack tecnologico. È una decisione architetturale fondamentale su come generare risultati di business dai dati operativi.

Dai dati grezzi al valore operativo

Per i CTO e i responsabili di prodotto, questo segna uno spostamento critico dalla raccolta passiva dei dati verso la generazione attiva di intelligenza. L’obiettivo è progettare sistemi che non siano solo connessi, ma anche consapevoli del contesto e reattivi. Un approccio ingenuo — semplicemente raccogliere più dati — peggiora solo il problema, aumentando i costi di storage senza migliorare i risultati.

Questa guida fornisce una roadmap pragmatica per costruire sistemi AIoT sicuri, scalabili e dal costo efficace. Ci concentriamo su considerazioni di implementazione e compromessi architetturali, trattando:

- Pattern architetturali chiave: Valutazione di modelli edge, cloud e ibridi in base a latenza, costo, sicurezza e vincoli di conformità.

- Governance dei dati by design: Come incorporare framework come GDPR e NIS2 nell’architettura di sistema fin dal primo giorno, non come un ripiego.

- Scenari pratici di implementazione: Andare oltre i diagrammi per esaminare come costruire workflow AIoT affidabili che funzionino in ambienti operativi reali.

Il mercato riflette questa urgenza operativa. Il mercato globale dell’Artificial Intelligence nell’IoT è proiettato raggiungere USD 221,77 miliardi entro il 2032. Questa crescita è una risposta diretta alla necessità di gestire i dati da una flotta in continua espansione di dispositivi connessi, che si prevede si avvicinerà a 40 miliardi entro il 2030. Puoi esplorare la ricerca completa sulle tendenze di mercato AIoT per comprendere la portata di questo cambiamento tecnologico.

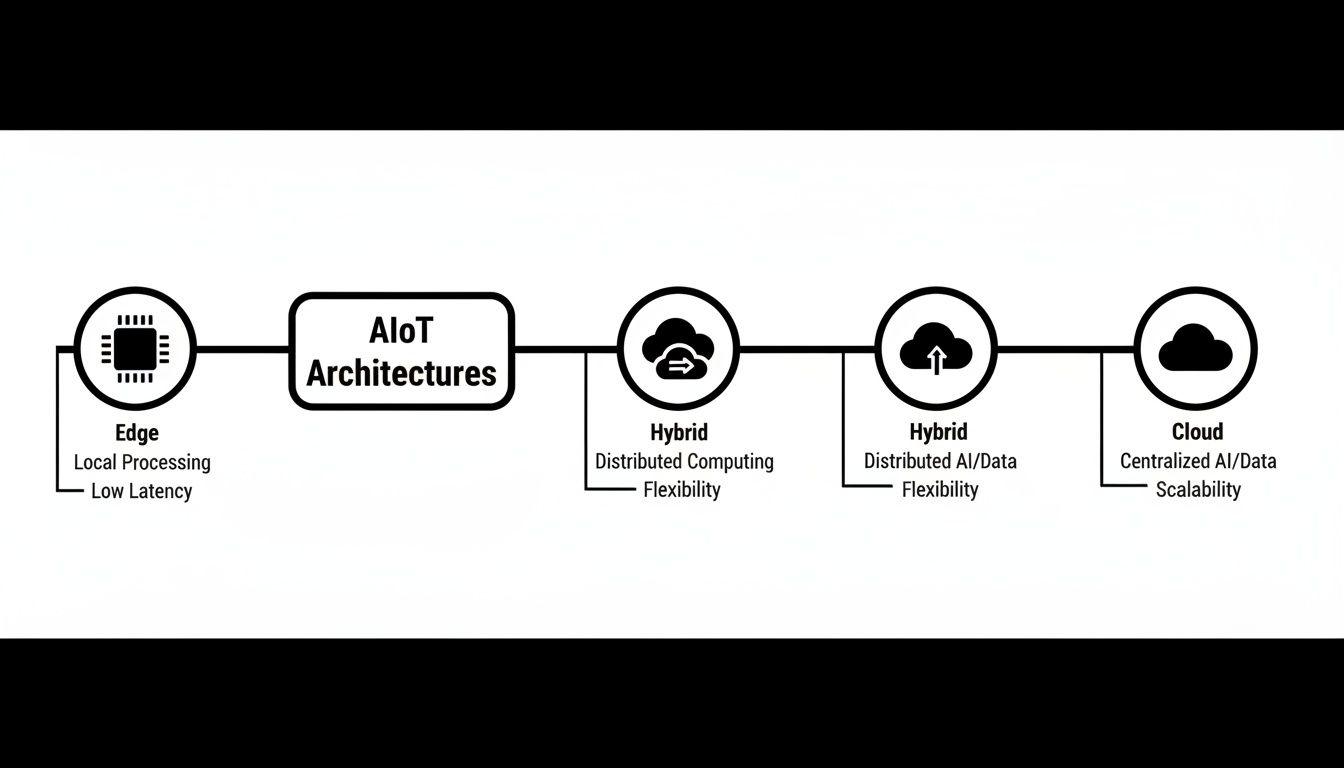

Scegliere il giusto blueprint architetturale AIoT

Selezionare l’architettura giusta per il tuo sistema intelligenza artificiale IoT è una delle decisioni ingegneristiche più critiche che prenderai. Determina direttamente le prestazioni della soluzione, i costi operativi, la postura di sicurezza dei dati e la scalabilità. La domanda fondamentale è: dove avviene effettivamente l’elaborazione dei dati — il «pensiero»?

Un approccio superficiale è inviare tutti i dati da ogni dispositivo a un cloud centrale per l’elaborazione. Per molti scenari reali, però, questo non è solo impraticabile; può essere pericoloso. Immagina una fabbrica che utilizza la visione artificiale per il controllo qualità in tempo reale su una linea di produzione. Aspettare il round-trip al cloud per identificare un difetto è operativamente insostenibile.

Il modello di Edge Computing

In un’architettura orientata all’edge, l’elaborazione AI avviene direttamente sul dispositivo IoT o nelle sue immediate vicinanze. Questo può essere un sensore potente, un gateway locale all’interno di una fabbrica o un piccolo server in un punto vendita.

I dati vengono analizzati alla fonte. Solo i risultati essenziali — come riepiloghi, anomalie o allarmi — vengono trasmessi al cloud. Questo modello è necessario per qualsiasi applicazione che richieda una risposta quasi istantanea.

- Latenza ultra-bassa: Le decisioni vengono prese in millisecondi, indipendentemente dai ritardi di rete. Questo è imprescindibile per veicoli autonomi, robotica industriale o sistemi critici di monitoraggio dei pazienti.

- Privacy fin dalla progettazione: Informazioni sensibili, come flussi video da una struttura sicura o dati sanitari personali, possono essere elaborate localmente senza uscire dal perimetro. Questo è un principio fondamentale per costruire sistemi conformi al GDPR.

- Riduzione dei costi di banda: Trasmettere flussi ad alta risoluzione da migliaia di dispositivi diventa proibitivo. L’elaborazione al bordo riduce drasticamente il volume di dati inviati in rete.

Tuttavia, l’edge computing introduce i propri compromessi. Gestire, aggiornare e mettere in sicurezza una flotta distribuita di dispositivi intelligenti è una sfida operativa complessa. Inoltre, la potenza di calcolo disponibile su un dispositivo edge è intrinsecamente limitata rispetto alle vaste risorse di un ambiente cloud.

Il modello di Cloud Computing

Un modello cloud puro aggrega i dati grezzi di tutti i dispositivi IoT in un data lake o in un data warehouse centrale. Qui puoi applicare potenti modelli di AI per effettuare analisi su larga scala, addestrare nuovi modelli su massicci dataset storici e generare intelligence aziendale di alto livello.

Questa architettura è efficace quando la risposta immediata non è il requisito principale. Si adatta bene a un progetto di smart city che analizza i pattern di traffico a lungo termine per ottimizzare i tempi dei semafori o a una società di servizi che prevede la domanda energetica su un’intera regione.

Il rischio principale di un modello cloud-only per una soluzione di intelligenza artificiale IoT è la sua fragilità. Dipendere completamente dalla connettività cloud crea un singolo punto di guasto. Se la connessione di rete viene persa, i tuoi dispositivi «intelligenti» diventano semplici raccoglitori di dati, incapaci di funzionare autonomamente.

Il modello ibrido: un default pragmatico

Per la maggior parte dei sistemi AIoT di livello enterprise, né un modello edge puro né uno cloud puro sono sufficienti. L’architettura ibrida offre un equilibrio pragmatico, permettendo di eseguire i compiti di elaborazione dove risultano più efficaci.

In questa configurazione, le operazioni sensibili al tempo e il filtraggio iniziale dei dati avvengono all’edge. Per esempio, un dispositivo su una turbina eolica potrebbe analizzare in tempo reale i dati di vibrazione per rilevare un’anomalia. Se identifica un potenziale guasto, può generare un allarme locale immediato inviando contemporaneamente un pacchetto di dati condensato al cloud per un’analisi forense più approfondita. Nel cloud, quell’evento specifico può quindi essere correlato con i dati di migliaia di altre turbine per identificare tendenze sistemiche o perfezionare i modelli di manutenzione predittiva.

Questo approccio bilanciato fornisce la bassa latenza dell’edge e le potenti capacità analitiche del cloud, risultando in un sistema resiliente ed efficiente. Aiuta anche a mitigare il vendor lock-in spesso associato a piattaforme proprietarie tutto-in-uno, consentendo maggiore flessibilità architetturale.

Confronto tra modelli architetturali AIoT

Questa tabella riassume i compromessi tra architetture Edge, Cloud e Ibride attraverso dimensioni tecniche e di business chiave.

| Dimensione | Edge Computing | Cloud Computing | Modello Ibrido |

|---|---|---|---|

| Latenza | Millisecondi; ideale per il controllo in tempo reale. | Elevata; dipende dalla connessione di rete. | Bassa latenza per i compiti edge, elevata per l’analisi cloud. |

| Privacy dei dati | Elevata; i dati sensibili restano on-premise. | Inferiore; i dati vengono trasmessi a terzi. | Elevata; i dati sensibili possono essere elaborati localmente in prima istanza. |

| Costo della banda | Basso; vengono inviati solo i dati essenziali. | Alto; vengono trasmessi flussi di dati grezzi. | Moderato; bilanciato tra traffico locale e cloud. |

| Scalabilità | Complessa da gestire su larga scala. | Altamente scalabile con le risorse del provider cloud. | Il meglio di entrambi; analytics scalabili con una flotta edge gestibile. |

| Capacità offline | Elevata; le funzioni core operano senza rete. | Nessuna; il dispositivo è inutile senza connessione. | Elevata; le funzioni critiche girano localmente e si sincronizzano quando online. |

| Complessità del modello | Limitata dall’hardware del dispositivo. | Virtualmente illimitata; supporta modelli grandi e complessi. | Modelli semplici all’edge, modelli complessi nel cloud. |

| Costo iniziale | Alto; richiede investimento in hardware capace. | Basso; servizi cloud pay-as-you-go. | Moderato; bilanciamento tra costi hardware e cloud. |

Il modello ibrido è spesso il punto di partenza più pratico, offrendo una base solida che può adattarsi man mano che i requisiti del sistema evolvono.

Dalla rilevazione delle anomalie ai workflow automatizzati

Una volta che hai un’architettura solida, la sfida successiva è applicare modelli di AI all’interno dei flussi di dati IoT per trasformare le letture dei sensori in azioni di valore. Si tratta di scegliere lo strumento giusto per il compito giusto. Per esempio, un modello di visione artificiale su un dispositivo edge può identificare difetti microscopici su una linea di produzione in tempo reale, mentre un modello acustico può rilevare un cambiamento sottile nel rumore di una macchina che segnala l’avvicinarsi di un guasto al cuscinetto. Qui intelligenza artificiale e IoT passano da concetto a potente strumento operativo.

Uso degli embeddings per il rilevamento contestuale delle anomalie

Una delle tecniche più pratiche in AIoT è l’utilizzo di embeddings — rappresentazioni numeriche ricche dei dati — per identificare anomalie sottili. Un semplice avviso basato su soglia potrebbe segnalare che la temperatura di una macchina è alta. È un inizio, ma gli embeddings offrono un contesto più profondo.

Convertendo dati complessi dei sensori (vibrazione, temperatura, consumo energetico) in un unico vettore, un modello può imparare la normale relazione tra queste metriche. Quando quella relazione devia, anche se le singole metriche restano entro le proprie soglie “normali”, si segnala un problema in fase di sviluppo che gli avvisi isolati non coglierebbero.

Orchestrare workflow automatizzati tramite agenti

Questi insight diventano più potenti quando integrati in un workflow di agenti automatizzati. Un agente AI è un sistema progettato per eseguire una sequenza di azioni per raggiungere un obiettivo, coordinando diversi strumenti e fonti di dati.

Considera uno scenario reale: un agente AI ha il compito di monitorare una flotta di generatori industriali. Il suo workflow non è una semplice regola «se-allora», ma un processo multi-step progettato per affidabilità ed efficienza. Un’implementazione ingenua potrebbe portare a falsi positivi o a invii di interventi non necessari.

Un processo robusto si presenta così:

- Allarme iniziale: L’agente riceve un avviso di alta temperatura dai sensori di un generatore.

- Analisi contestuale: Invece di mandare ciecamente un tecnico, l’agente interroga un database vettoriale. Usa i dati dell’allarme (temperatura, carico, tempo di esercizio) per trovare eventi storici simili e li incrocia con i log di manutenzione.

- Riconoscimento di pattern: L’agente scopre che questo pattern di allarmi ha preceduto un guasto alla pompa del circuito di raffreddamento nell’85% dei casi passati. Conferma inoltre che non è stata eseguita manutenzione recente sul sistema di raffreddamento.

- Azione automatizzata: Armato di questo contesto, l’agente usa un’API per controllare il turno del personale reperibile e prenota il tecnico disponibile con la giusta specializzazione. Contemporaneamente crea un ordine di lavoro con un riepilogo delle sue conclusioni, evidenziando l’alta probabilità di un problema alla pompa del circuito di raffreddamento.

Progettare per affidabilità e controllo dei costi

Costruire workflow di questo tipo richiede un’orchestrazione robusta per garantire che il sistema sia affidabile, verificabile e sostenibile nei costi. Un’implementazione superficiale può rapidamente portare a guasti a catena o a bollette cloud fuori controllo. Qui la scelta architetturale è critica.

Come illustra il diagramma, un modello ibrido spesso offre l’equilibrio ottimale. Permette l’elaborazione immediata e locale all’edge mentre abilita analisi complesse e su larga scala nel cloud — la combinazione esatta necessaria per workflow agentici sofisticati. Per farlo funzionare, è necessario concentrarsi su diversi principi ingegneristici chiave:

- Osservabilità robusta: È necessaria una soluzione di monitoraggio unificata per tracciare l’intero workflow, incluso lo stato dei dispositivi, la latenza delle chiamate API, le prestazioni del modello AI e il costo di ogni passaggio.

- Caching intelligente: L’agente nel nostro esempio non dovrebbe interrogare nuovamente il database vettoriale per ogni minima variazione di temperatura. Un caching intelligente riduce le chiamate ridondanti ai modelli e le richieste API, essenziale per gestire i costi operativi.

- Meccanismi di sicurezza e intervento umano nel ciclo: Cosa succede se l’API di scheduling non è disponibile? L’agente deve avere un piano di fallback, ad esempio l’invio di una notifica ad alta priorità a un operatore umano. Per decisioni irreversibili o ad alto rischio, un passo di “intervento umano nel ciclo” è imprescindibile. Per un approfondimento su come strutturare questi sistemi, scopri di più sul nostro approccio pragmatico alla struttura dei sistemi AI.

Orchestrando questi componenti, si passa da una raccolta di dispositivi intelligenti a un sistema intelligente e coerente che migliora attivamente le operazioni.

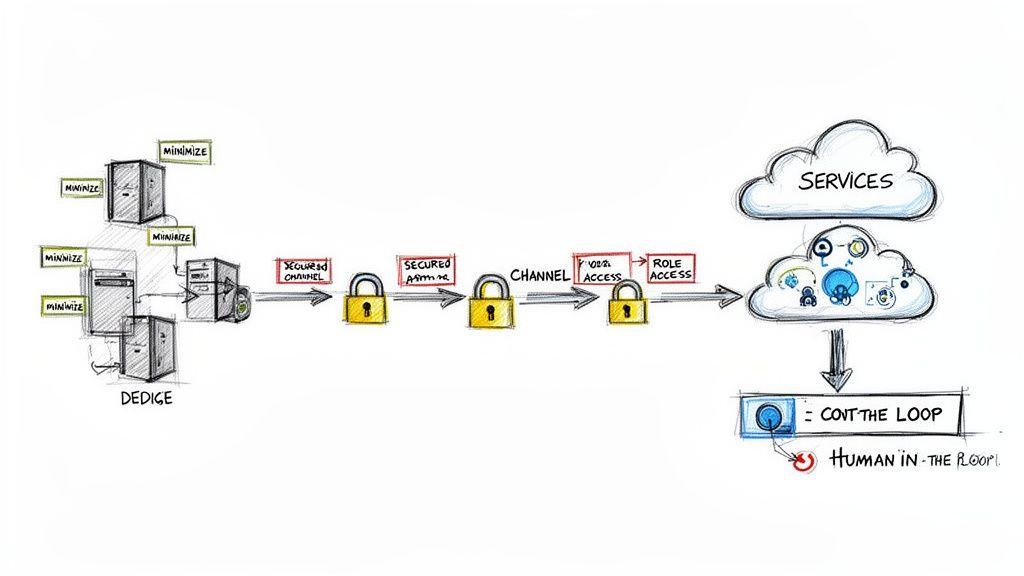

Progettare per la sicurezza e la governance dei dati

In qualsiasi sistema di intelligenza artificiale IoT, la sicurezza e la governance dei dati non sono funzionalità da aggiungere in seguito; sono imperativi architetturali. Tentare di “aggiungere” la conformità alla fine di un progetto porta inevitabilmente a costosi riprogettazioni, sanzioni normative e perdita di fiducia da parte dei clienti. La proliferazione dei dati e il processo decisionale automatizzato amplificano significativamente la superficie d’attacco e i rischi per la privacy.

Affrontare il quadro normativo come problema ingegneristico

Le normative moderne non sono documenti legali astratti; sono requisiti ingegneristici concreti. Framework come il GDPR dell’UE, la direttiva NIS2 e il Digital Operational Resilience Act (DORA) hanno implicazioni dirette su come progettare e gestire soluzioni AIoT.

- GDPR (Regolamento generale sulla protezione dei dati): Impone il “privacy by design”. In un contesto AIoT, questo significa praticare la minimizzazione dei dati alla fonte — per esempio, processare i dati su un dispositivo edge per evitare di trasmettere informazioni personali non necessarie al cloud.

- NIS2 (Direttiva sulla sicurezza delle reti e dell’informazione): Richiede misure di sicurezza robuste per le infrastrutture critiche, traducendosi in crittografia end-to-end obbligatoria per tutti i dati in transito e a riposo, insieme a controlli di accesso rigorosi.

- DORA (Digital Operational Resilience Act): Focalizzato sul settore finanziario, esige che le organizzazioni possano resistere e recuperare da interruzioni correlate all’ICT. Necessita architetture resilienti con meccanismi di fail-safe integrati e piani di risposta agli incidenti ben definiti.

Ignorare questi framework espone un’organizzazione a significative responsabilità legali e finanziarie. L’unico approccio difendibile è costruire sistemi che siano sicuri e conformi per loro stessa progettazione.

Strategie pratiche di mitigazione del rischio

Una postura di sicurezza efficace si costruisce a strati, direttamente nell’architettura AIoT. Una strategia fondamentale è la minimizzazione dei dati all’edge. Ad esempio, una telecamera intelligente che monitora il traffico pedonale in un negozio non ha bisogno di trasmettere video in alta definizione al cloud. Un dispositivo edge può analizzare il flusso localmente, estrarre un conteggio anonimo e trasmettere solo quell’intero. Le registrazioni raw possono essere eliminate immediatamente, eliminando architetturalmente il rischio di una violazione di dati personali.

Un altro componente critico è il robusto Controllo degli accessi basato sui ruoli (RBAC). Questo assicura che utenti e sistemi automatizzati abbiano solo le autorizzazioni minime necessarie per svolgere le loro funzioni. Un tecnico di manutenzione non dovrebbe avere le credenziali per accedere all’analisi finanziaria, e un agente AI che ottimizza il consumo energetico non dovrebbe poter modificare le configurazioni della linea di produzione.

La sicurezza è una scelta architetturale, non una funzione. In AIoT, questo significa progettare sistemi con controlli espliciti che assumano che le minacce non siano una questione di se, ma di quando.

Questa mentalità proattiva è essenziale. Con un aumento riportato del 300% degli incidenti di cybersecurity legati all’IoT lo scorso anno, costruire sistemi resilienti è un imperativo di business. Le poste in gioco sono particolarmente alte nella manifattura, dove l’AIoT sta contribuendo a ridurre i costi della supply chain del 20-30%. Questa tendenza è particolarmente pronunciata nella regione Asia Pacifico, dove il mercato AIoT è in forte crescita. Leggi di più sul mercato AIoT in crescita nell’Asia Pacifico.

Implementazione di guardrail e supervisione umana

Infine, per qualsiasi sistema in cui un’AI possa attivare azioni nel mondo fisico, i guardrail e i controlli human-in-the-loop (HITL) sono obbligatori. I guardrail sono controlli automatizzati che impediscono a un modello AI di intraprendere azioni che violano regole di sicurezza o aziendali predefinite.

Per decisioni davvero critiche, tuttavia, la conferma umana è essenziale. Immagina un sistema AIoT che rileva una grande anomalia sulla linea di produzione principale di una fabbrica. Invece di avviare automaticamente uno shutdown — una decisione che potrebbe costare milioni — il sistema dovrebbe presentare la sua analisi e raccomandazione a un operatore umano. La decisione finale di fermare la produzione spetta a una persona che possiede conoscenze contestuali che l’AI non ha. Questo approccio equilibrato combina l’efficienza dell’automazione con la saggezza del giudizio umano.

Gestire costi e scalabilità nel tuo sistema AIoT

Per qualsiasi soluzione di intelligenza artificiale IoT per essere praticabile, deve essere gestibile sia tecnicamente che finanziariamente. Un proof-of-concept che diventa proibitivo a scala è un progetto fallito. La scalabilità non riguarda solo la gestione di più dispositivi; è un problema finanziario. Ogni chiamata API, gigabyte trasferito e secondo di calcolo cloud contribuisce al conto operativo. Senza visibilità e controllo chiari, i costi possono aumentare in modo imprevedibile.

Stabilire un’osservabilità unificata

Il primo passo verso il controllo è un’osservabilità completa. L’approccio ingenuo di monitorare componenti individuali in isolamento crea punti ciechi. È necessaria una dashboard unificata per tracciare l’intera pipeline dei dati dal dispositivo edge fino all’insight finale.

- Integrità del dispositivo: Monitora il carico della CPU, l’utilizzo della memoria e la connettività di rete sui dispositivi edge per prevenire guasti hardware.

- Latenza della pipeline dei dati: Traccia quanto tempo impiega il dato a muoversi dal sensore all’insight per identificare colli di bottiglia di rete o ritardi di elaborazione.

- Prestazioni del modello AI e drift: Monitora continuamente l’accuratezza del modello. Le prestazioni di un modello possono degradare nel tempo man mano che le condizioni reali cambiano — un fenomeno noto come model drift.

- Costo per transazione: Attribuisci i costi ad azioni o dispositivi specifici. Sapere che un certo tipo di query costa £0.05 permette una pianificazione finanziaria precisa e il calcolo del ROI.

Strategie concrete per il controllo dei costi

Una volta ottenuta un’osservabilità chiara, puoi implementare tattiche specifiche per gestire la spesa. La spesa cloud incontrollata è spesso sintomo di scelte architetturali sbagliate, non di un costo inevitabile.

Un errore comune è trattare le chiamate ai modelli AI come una risorsa illimitata. In un’implementazione AIoT su larga scala, anche un modello a basso costo può generare spese immense se viene chiamato in modo distratto e ridondante.

Ecco tre strategie efficaci:

- Implementare caching intelligente: Riduci le chiamate ridondanti ai modelli AI memorizzando nella cache i risultati delle query comuni. Se più sensori riportano dati simili in una finestra breve, il sistema dovrebbe usare una risposta cache invece di attivare una nuova inferenza costosa.

- Usare limiti di frequenza e circuit breaker: Proteggi il tuo budget da un dispositivo mal configurato o da un bug software. Implementa limiti di frequenza rigorosi sulle chiamate API e usa circuit breaker per arrestare automaticamente i processi che superano soglie di costo, allertando immediatamente un operatore.

- Scegliere il giusto mix di modelli: Non ogni compito richiede un modello grande e proprietario. Usa un approccio a livelli: distribuisci modelli open-source piccoli ed efficienti all’edge per il filtraggio iniziale dei dati. Riserva modelli più potenti e costosi per analisi complesse nel cloud, ma solo dopo che un potenziale problema è stato identificato. Puoi approfondire come trovare il giusto equilibrio leggendo la nostra guida su on-premises vs. cloud computing.

Combinando l’osservabilità totale del sistema con tattiche disciplinate di controllo dei costi, puoi costruire una soluzione AIoT che scala in modo affidabile e conveniente.

La tua roadmap a fasi per l’implementazione AIoT

Implementare una soluzione di intelligenza artificiale IoT è un percorso a fasi, non un unico deployment ad alto rischio in stile “big bang”. Per fondatori e product leader, l’approccio più efficace è procedere per tappe, riducendo il rischio dell’investimento e convalidando il valore lungo il percorso.

Il percorso inizia con la discovery. Il primo passo è identificare un problema aziendale specifico e ad alto valore che un sistema AIoT può risolvere. Obiettivi vaghi come “migliorare l’efficienza” non sono sufficienti. Hai bisogno di una metrica concreta, come “ridurre i tempi di inattività non pianificati delle macchine del 15%.”

Inizia in piccolo con un pilota focalizzato

Con un caso di business chiaro, il passo successivo è un progetto pilota su piccola scala. Questo serve come verifica della realtà per convalidare le tue assunzioni tecniche e confermare che la tecnologia può fornire l’esito desiderato prima di impegnare risorse significative. Il pilota dovrebbe avere un ambito ridotto, come il monitoraggio di un piccolo numero di asset critici. L’obiettivo principale è confermare che i tuoi sensori raccolgono dati utili e che i modelli AI iniziali possono generare insight significativi. Questa è un’opportunità per fallire rapidamente e imparare a basso costo.

Questo approccio misurato è vitale. Con dispositivi IoT connessi a livello globale destinati a raggiungere 18.8 miliardi entro la fine del 2024 e le imprese che aumentano i loro budget per l’IoT, la tentazione di accelerare è forte. Un pilota di successo convalida il tuo approccio, permettendoti di scalare in un mercato previsto raggiungere USD 158.1 miliardi entro il 2034 senza assumere rischi ingestibili. Puoi scoprire di più sulla crescita dei dispositivi connessi e le sue implicazioni.

Adotta un modello di rilascio incrementale

Dopo un pilota riuscito, puoi scalare usando un modello di rilascio incrementale. Ciò significa aggiungere nuove capacità a strati, garantendo che ogni aggiunta fornisca valore misurabile e si basi su una fondazione stabile.

Il principio fondamentale è il miglioramento iterativo: inizia con un sistema semplice e robusto, poi aggiungi complessità. Questo ti permette di imparare e adattarti basandoti sul feedback reale, assicurando che il sistema evolva per risolvere bisogni aziendali concreti.

Un tipico roadmap di implementazione potrebbe apparire così:

-

Fase 1: Raccolta dati e avvisi di base. Inizia raccogliendo dati da un insieme più ampio di dispositivi e stabilendo una pipeline dei dati affidabile. Implementa avvisi semplici basati su soglie per notificare gli operatori di problemi immediati.

-

Fase 2: Analisi predittiva. Una volta che hai una solida baseline di dati storici, introduci modelli AI più sofisticati per prevedere eventi futuri, passando da una postura operativa reattiva a una proattiva.

-

Fase 3: Risposte automatizzate. Infine, permetti al sistema di intraprendere azioni automatiche basate sulle sue previsioni, come generare un ordine di lavoro per la manutenzione o regolare i parametri della macchina in tempo reale, con adeguata supervisione umana.

Questo progresso metodico garantisce che il tuo investimento in IoT basato sull’intelligenza artificiale sia fondato su risultati pratici, non su speculazioni. Per le organizzazioni che desiderano costruire sistemi resilienti, la nostra guida su varie soluzioni Internet of Things offre ulteriori approfondimenti pratici.

Domande frequenti su AIoT

Quando i CTO e i responsabili di prodotto iniziano a valutare IoT basato sull’intelligenza artificiale, emergono le stesse domande pratiche. Ecco risposte dirette basate sull’esperienza di implementazione nel mondo reale.

Qual è il primo passo per implementare una strategia AIoT?

Il primo passo non è tecnologico. È identificare un problema aziendale ad alto valore che possa essere risolto con dati intelligenti.

Inizia definendo una metrica chiara che desideri influenzare — ad esempio ridurre i tempi di inattività non programmata di una certa percentuale o ridurre gli sprechi energetici di un numero stabilito di chilowattora. Quindi, esegui un pilot su piccola scala con un numero limitato di dispositivi per convalidare che i dati raccolti possano incidere su quella metrica. Questo approccio riduce il rischio del progetto e assicura che stiate costruendo una soluzione per un bisogno reale, e non semplicemente adottando la tecnologia per se stessa.

Come gestiamo i costi di elaborazione dell’IA per migliaia di dispositivi IoT?

È necessario implementare una strategia architetturale a più livelli. Un’implementazione ingenua in cui ogni dispositivo chiama liberamente le API cloud è una ricetta per spese incontrollate.

Prima, elabora il più possibile i dati a livello edge per ridurre i costi di trasmissione e di elaborazione in cloud. Secondo, implementa un caching intelligente in modo che query identiche non attivino inferenze IA ridondanti.

Terzo, utilizza un approccio a livelli per i modelli IA. Un modello semplice e a basso costo può essere eseguito sull’edge per un primo screening, riservando un modello più potente e oneroso solo quando viene segnalato un potenziale problema. Infine, implementa rigide pratiche di osservabilità e limitazione della frequenza delle richieste per monitorare i costi in tempo reale e prevenire sforamenti di budget.

Possiamo integrare AIoT nelle nostre apparecchiature industriali legacy esistenti?

Sì, questo è uno scenario comune e pratico. Non è necessario sostituire l’intera infrastruttura per ottenere i benefici di un sistema IoT basato sull’intelligenza artificiale.

L’approccio più efficace è dotare le macchine legacy di sensori moderni e non invasivi (ad es., sensori di vibrazione, termici o acustici). Questi sensori si connettono a un gateway edge che raccoglie i dati, effettua un’elaborazione iniziale e poi li trasmette in modo sicuro per ulteriori analisi. Questo consente di ottenere insight guidati dall’IA, come la manutenzione predittiva, dai tuoi asset esistenti, prolungandone la vita operativa e migliorando l’efficienza senza la massiccia spesa in conto capitale e la disruption di una revisione completa.

A Devisia siamo specializzati nella creazione di prodotti digitali affidabili, manutenibili e sicuri. Dalle piattaforme SaaS scalabili ai sistemi abilitati all’IA con governance solida, forniamo un percorso chiaro dalla visione di business a software significativo. Scopri come la nostra mentalità di prodotto può aiutarti a costruire la tua prossima soluzione su https://www.devisia.pro.