Integrare “Retail AI” non significa acquistare un singolo prodotto futuristico. Significa progettare un insieme di sistemi software specializzati per risolvere problemi aziendali specifici, dalla riduzione degli sprechi di inventario alla personalizzazione delle interazioni con i clienti. Questi sistemi non sono magia; sono motori decisionali progettati per trasformare l’analisi manuale e lenta dei dati in azioni operative in tempo reale che guidano efficienza e ricavi.

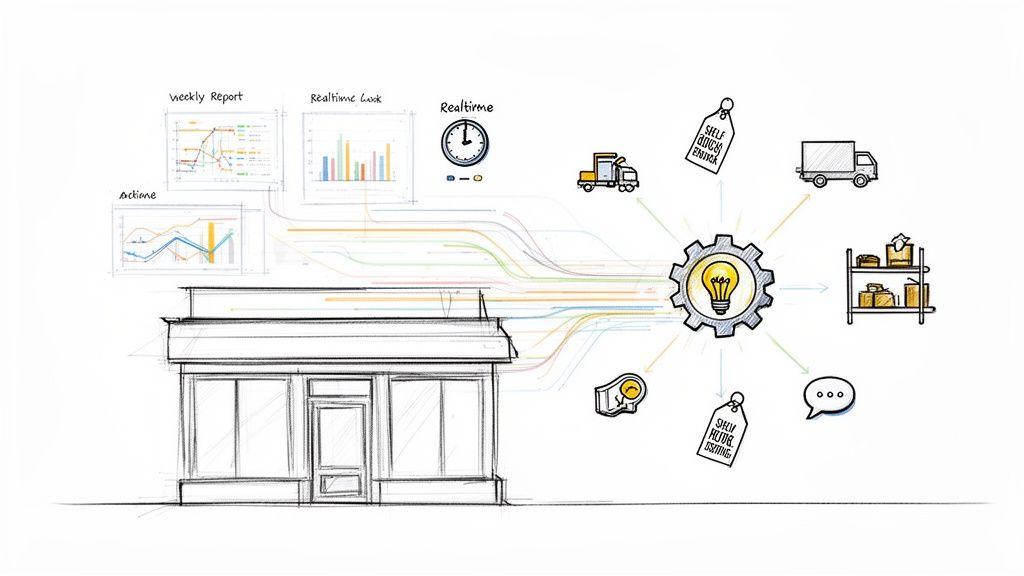

Per founder, CTO e responsabili di prodotto, l’opportunità sta nel considerare l’intelligenza artificiale per il retail come una capacità fondamentale incorporata nell’architettura aziendale, non come un esperimento isolato. Questo cambiamento di mentalità è cruciale per passare da un’analisi reattiva dei report storici di vendita ad azioni proattive e basate sui dati, come un sistema che segnala un possibile esaurimento scorte in un punto vendita specifico nel pomeriggio di oggi. L’obiettivo è potenziare le decisioni umane con velocità e precisione computazionali.

Il problema: andare oltre l’hype verso un’implementazione pratica

Molte aziende retail faticano con inefficienze operative ed esperienze cliente poco differenziate. Il problema non è la mancanza di dati, ma l’incapacità di elaborarli a una velocità e su una scala tali da consentire azioni immediate. I metodi tradizionali si basano sull’analisi manuale, che è lenta, soggetta a errori e incapace di gestire la complessità delle operazioni retail moderne. Questo porta a problemi persistenti che erodono i margini e la fidelizzazione dei clienti.

Dall’analisi manuale all’azione automatizzata

La funzione principale di un sistema AI nel retail è automatizzare il processo di trasformazione di vasti dataset—comportamento dei clienti, livelli di inventario, logistica della supply chain, trend di mercato—in output azionabili. Questa capacità spiega perché il mercato globale dell’AI nel retail, valutato a 3,2 miliardi di USD nel 2023, dovrebbe raggiungere 13,86 miliardi di USD entro il 2026, riflettendo un tasso di crescita annuale composto di circa 52%. Con l’88% dei dirigenti che prevede di aumentare la spesa in AI, l’attenzione è sul comprimere i cicli decisionali da settimane a minuti.

Nel suo nucleo, l’implementazione dell’AI nel retail è una scelta architetturale. Dà priorità alla costruzione di sistemi scalabili, manutenibili e governabili per operazioni guidate dai dati rispetto alla dipendenza da reazioni basate sull’intuizione. Questo approccio ingegneristico rende il business più resiliente e reattivo.

Problemi fondamentali risolti dai sistemi AI per il retail

Un approccio pragmatico all’implementazione dell’AI si concentra sulla risoluzione di sfide aziendali persistenti piuttosto che sull’adozione della tecnologia fine a sé stessa. Questa prospettiva rende tangibile il valore e fornisce un percorso chiaro per generare ROI.

I principali problemi affrontati da sistemi AI ben progettati includono:

- Percorsi cliente impersonali: I motori di raccomandazione basati su regole spesso falliscono. I sistemi AI possono analizzare la cronologia di navigazione, i dati di acquisto e il contesto semantico per offrire raccomandazioni di prodotto pertinenti.

- Inefficienza dell’inventario: Le previsioni tradizionali portano a esaurimenti di scorte e sovrastoccaggio. I modelli di machine learning possono prevedere la domanda con maggiore precisione analizzando più variabili, riducendo sia gli sprechi sia le vendite perse.

- Punti ciechi operativi: Le operazioni dei negozi fisici sono spesso una scatola nera. La computer vision può automatizzare il monitoraggio della disponibilità sugli scaffali o analizzare i modelli di afflusso di clienti, fornendo dati quantitativi per ottimizzare la disposizione del negozio e l’allocazione del personale.

Concentrarsi su questi problemi concreti è la base per una trasformazione digitale nel retail di successo. Consente ai leader tecnici di costruire sistemi che risolvono i problemi attuali pur essendo architettonicamente pronti per i requisiti futuri.

Allineare le soluzioni AI alle principali sfide del retail

Un’implementazione efficace dell’AI nel retail richiede di mappare sfide aziendali specifiche alle capacità tecniche appropriate. Questo approccio demistifica lo stack tecnologico e chiarisce il percorso dal problema alla soluzione, aspetto essenziale per founder e CTO che prendono decisioni strategiche di architettura. L’obiettivo è comprendere con precisione quali strumenti AI risolvono quali problemi e come vengono progettati.

Ecco una panoramica delle applicazioni più comuni.

Migliorare la personalizzazione con LLM ed embeddings

Problema: Le raccomandazioni di prodotto generiche basate su regole frustrano i clienti e riducono i tassi di conversione. Questi sistemi non comprendono l’intento dell’utente né le relazioni semantiche tra i prodotti.

Soluzione: I moderni sistemi di intelligenza artificiale per il retail utilizzano Large Language Model (LLM) ed embeddings per comprendere sfumature e intenzioni.

-

Embeddings: Sono rappresentazioni vettoriali numeriche di dati non strutturati come descrizioni di prodotto, immagini o percorsi di navigazione dell’utente. Consentono al sistema di cogliere la “somiglianza semantica.” Ad esempio, il modello apprende che una “giacca leggera per la primavera” è concettualmente più vicina a un “windbreaker” che a un “parka invernale,” anche se le parole chiave non coincidono. Questo consente raccomandazioni più pertinenti dal punto di vista contestuale.

-

LLM: Questi modelli eccellono nell’interpretare richieste in linguaggio naturale. Un cliente può digitare “outfit per una cena estiva all’aperto,” e un LLM può tradurre questa richiesta ambigua in una query strutturata che il catalogo prodotti può elaborare. Può anche interpretare richieste complesse e multiformi come “scarponi da trekking resistenti e impermeabili per piedi larghi sotto le £200” in un insieme preciso di filtri.

Questa combinazione sposta il motore di raccomandazione dal suggerire ciò che hanno acquistato altre persone a ciò che questo specifico utente è più propenso a desiderare.

Ottimizzare l’inventario con il forecasting predittivo

Problema: La gestione tradizionale dell’inventario è un delicato gioco di equilibrio ad alto rischio. L’eccesso di scorte immobilizza capitale, mentre la carenza di scorte porta a vendite perse e insoddisfazione dei clienti. Le previsioni basate solo sulle vendite storiche non sono sufficienti per gestire la volatilità del mercato.

Soluzione: I modelli di machine learning (ML) possono generare previsioni della domanda più accurate analizzando simultaneamente decine di variabili.

Il cambiamento architetturale chiave è dal riordino reattivo al rifornimento predittivo. Un modello ML integra più variabili per anticipare la domanda futura con maggiore precisione, incidendo direttamente sui risultati economici minimizzando sia gli sprechi sia le opportunità mancate.

Un sistema di forecasting ben progettato sintetizza dati provenienti da più fonti:

- Dati di vendita storici: Analisi dei trend e della stagionalità fino al livello del singolo SKU.

- Fattori esterni: Integrazione di segnali reali come previsioni meteo, eventi locali o trend dei social media.

- Calendari promozionali: Considerazione di come sconti pianificati o campagne di marketing influenzeranno la domanda di articoli specifici.

Questa analisi multifattoriale consente il posizionamento preciso dei prodotti all’interno della rete retail, ottimizzando i livelli di stock a livello di sistema.

Migliorare le operazioni del negozio con la computer vision

Problema: Per i rivenditori fisici, l’ambiente del negozio è spesso una scatola nera povera di dati. Monitorare la disponibilità sugli scaffali, il flusso dei clienti e le lunghezze delle code è in genere un processo manuale, lento e costoso.

Soluzione: La computer vision automatizza il monitoraggio e l’analisi in negozio. Collegando i modelli AI alle telecamere già presenti nel punto vendita, i retailer possono ottenere intelligence operativa in tempo reale. Un modello di visione fine-tuned può essere addestrato a rilevare scaffali vuoti, identificare prodotti riposti nel posto sbagliato o riconoscere code lunghe alle casse, attivando avvisi automatici al personale tramite API di inventario e gestione.

L’adozione dell’AI non è più una strategia di nicchia. Fino al 90% dei retailer sta implementando l’AI, spinto dalle aspettative dei clienti—il 71% degli acquirenti ora si aspetta l’AI come parte della propria esperienza. La tendenza sta accelerando, con Adobe che segnala un aumento anno su anno del 1.950% del traffico retail derivante dalle interazioni in chat durante il Cyber Monday 2024. Puoi approfondire questi trend della tecnologia retail.

Progettare per scalabilità, manutenzione e sicurezza

Portare l’intelligenza artificiale per il retail da proof of concept a capacità aziendale centrale dipende interamente dalla sua architettura. Un modello che funziona bene in un ambiente di sviluppo è inutile se non può essere integrato in modo affidabile e sicuro nei sistemi di produzione.

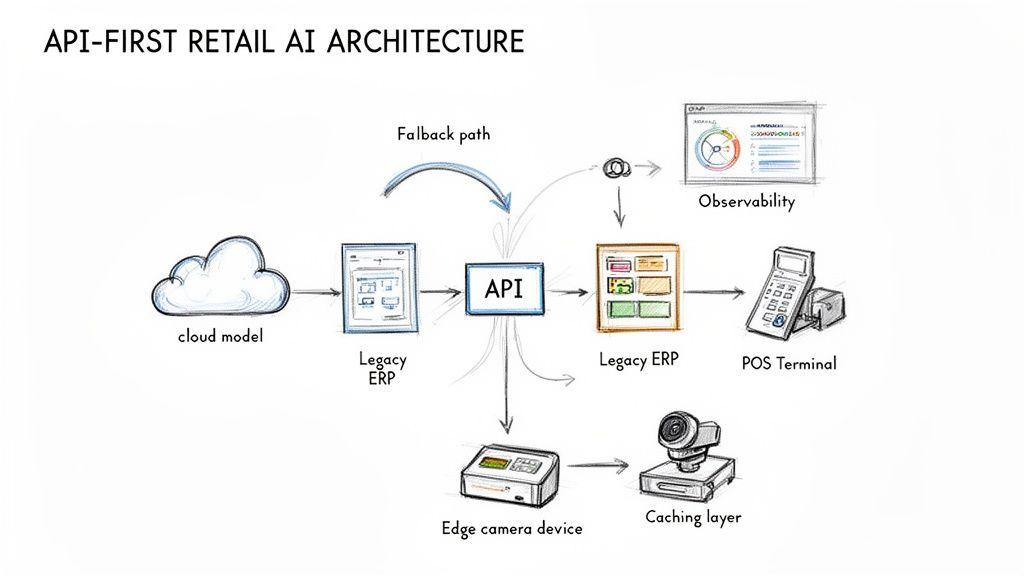

Per CTO e responsabili tecnici, la sfida non è solo costruire un modello, ma progettare un sistema che sia manutenibile, scalabile ed economico. Ciò richiede pattern architetturali collaudati che colleghino i servizi AI a una rete complessa di sistemi esistenti, inclusi Enterprise Resource Planning (ERP), Product Information Management (PIM) e Point of Sale (POS).

Una strategia di integrazione API-first

Il pattern più robusto per integrare l’AI in un ambiente retail è un approccio API-first. Questa strategia considera le capacità AI—sia modelli sviluppati su misura sia servizi di provider come OpenAI—come servizi modulari e indipendenti, consumati tramite API ben definite.

Questa scelta architetturale offre diversi vantaggi:

- Disaccoppiamento: I sistemi core (ad es. piattaforma e-commerce, software di inventario) non sono vincolati in modo rigido a uno specifico modello AI. Ciò consente di aggiornare, sostituire o testare in A/B modelli diversi senza re-ingegnerizzare l’intero backend.

- Interoperabilità: Fornisce un’interfaccia standard per consentire ai moderni strumenti AI di comunicare con sistemi monolitici legacy. Un API gateway può fungere da traduttore, convertendo una richiesta da un ERP legacy in un formato che un LLM cloud-based può elaborare.

- Accesso controllato: Le API fungono da collo di bottiglia naturale per implementare sicurezza, autenticazione e rate limiting. Questo garantisce che i servizi siano utilizzati correttamente e aiuta a gestire i costi operativi.

Questo approccio tratta l’AI come un altro servizio all’interno di un’architettura moderna orientata ai microservizi, un paradigma familiare e gestibile per i team di ingegneria.

Un design API-first è fondamentale per rendere operativa l’AI nel retail. Trasforma un modello da asset autonomo a componente riutilizzabile e governabile che può essere integrato in modo sicuro in più funzioni aziendali, dalle app rivolte al cliente ai workflow di back office.

Il compromesso: inferenza in tempo reale vs elaborazione batch

Non tutte le attività di AI nel retail hanno gli stessi requisiti di performance. Un errore architetturale comune è applicare un modello di elaborazione valido per tutto, portando a costi eccessivi o a una cattiva esperienza utente. La decisione chiave è scegliere tra inferenza in tempo reale ed elaborazione batch.

L’inferenza in tempo reale è necessaria per le applicazioni rivolte al cliente, dove la bassa latenza è fondamentale.

- Casi d’uso: Raccomandazioni di prodotto personalizzate, prezzi dinamici, interazioni con chatbot.

- Esigenze architetturali: API a bassa latenza, endpoint accelerati da GPU ed eventualmente edge computing per scenari in negozio. L’infrastruttura deve essere dimensionata per la domanda di picco.

L’elaborazione batch è più adatta ed economica per le operazioni di back office, dove le decisioni non sono così sensibili al fattore tempo.

- Casi d’uso: Previsione della domanda, generazione massiva di descrizioni di prodotto, analisi della segmentazione clienti.

- Esigenze architetturali: questi lavori possono essere pianificati durante le ore di minor carico utilizzando istanze basate su CPU. L’attenzione è rivolta al throughput e all’efficienza, non al tempo di risposta immediato.

Scegliere il modello di elaborazione giusto per ciascun caso d’uso è una scelta strategica cruciale. Tentare di eseguire in tempo reale un modello di previsione di grandi dimensioni è proibitivamente costoso, mentre costringere un cliente ad aspettare minuti per una raccomandazione di prodotto distruggerà i tassi di conversione.

Progettare per resilienza, governance e controllo dei costi

I sistemi di AI, in particolare quelli che dipendono da API di terze parti, possono andare in errore. Un’API può diventare non disponibile, un modello potrebbe restituire un risultato inatteso oppure la latenza potrebbe aumentare improvvisamente. Un’architettura resiliente anticipa questi guasti e include meccanismi per gestirli in modo elegante. Un’implementazione ingenua che ignora governance e sicurezza non è solo debito tecnico: è una passività per il business.

I principali requisiti non funzionali includono:

- Osservabilità robusta: non puoi gestire ciò che non misuri. Il sistema richiede logging e monitoraggio completi per tenere traccia delle prestazioni del modello (accuratezza, drift), delle metriche operative (latenza, tassi di errore) e dei costi. Dashboard che correlano le chiamate API a specifiche funzioni di business sono essenziali per la governance finanziaria.

- Caching strategico: molte query guidate dall’AI sono ripetitive. Mettere in cache le risposte alle richieste comuni — come le raccomandazioni per un prodotto popolare o un riepilogo delle sue recensioni — riduce drasticamente le chiamate API, la latenza e i costi operativi.

- Fallback resilienti: quando un servizio basato su AI va in errore, il sistema deve degradare in modo elegante, non bloccarsi. Ad esempio, se una ricerca alimentata da AI va offline, il sistema dovrebbe tornare automaticamente a un algoritmo di ricerca più semplice, basato su regole.

- Privacy by design: questo principio impone che la privacy sia una scelta architetturale, non una funzionalità aggiuntiva. Tecniche come anonimizzazione dei dati (rimozione degli identificatori prima dell’elaborazione) e minimizzazione dei dati (raccolta solo dei dati necessari) sono fondamentali per la conformità a normative come il GDPR. Costruire su una solida strategia di dati first-party è cruciale.

- Sicurezza specifica per l’AI: i modelli stessi sono asset che possono essere attaccati. La tua architettura deve difendersi da minacce come gli attacchi di model inversion (in cui un aggressore ricostruisce retroattivamente i dati di addestramento) e il data poisoning (in cui dati malevoli vengono introdotti per corrompere il comportamento del modello). Ciò richiede controlli di accesso rigorosi sui dati di addestramento e monitoraggio continuo degli output del modello per rilevare anomalie.

Integrare questi principi nella tua architettura AI fin dal primo giorno crea un sistema non solo potente, ma anche pratico, sicuro e sostenibile dal punto di vista finanziario.

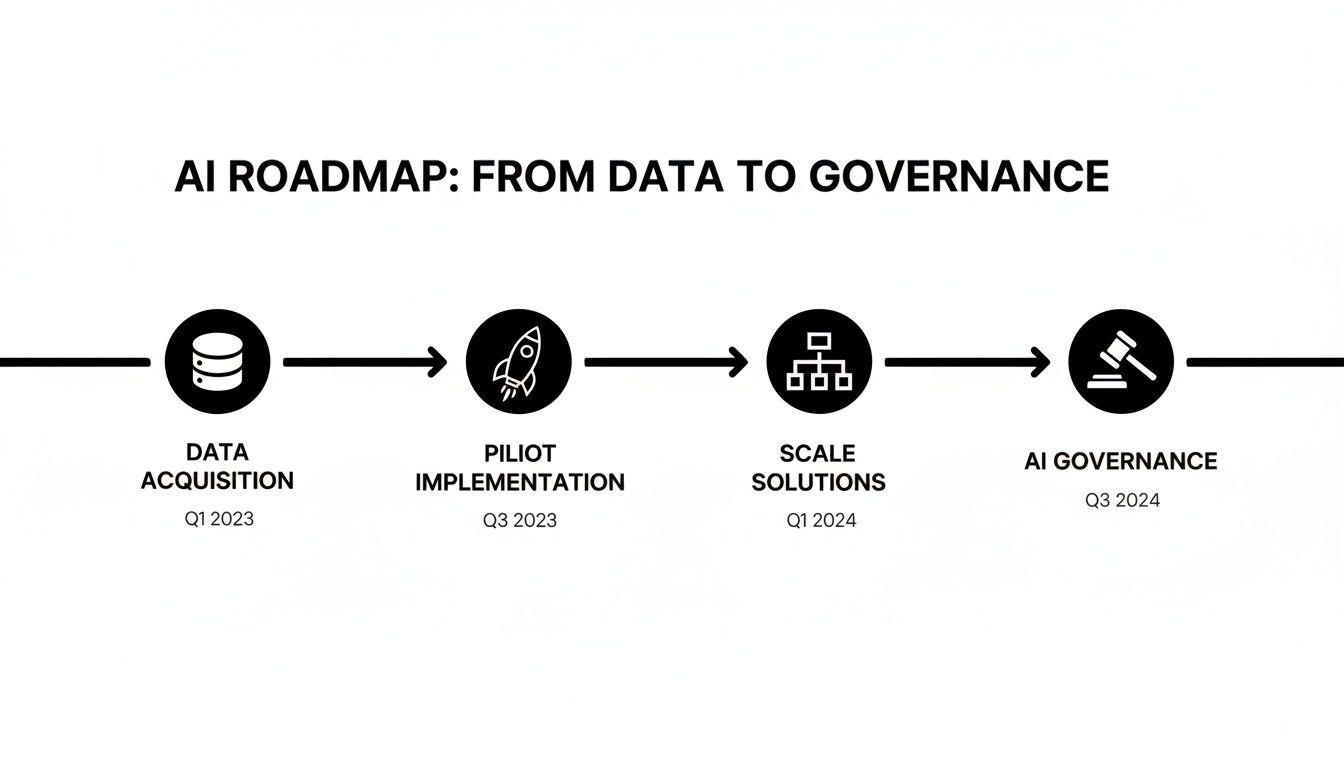

Una roadmap di implementazione in fasi per l’AI nel retail

Tentare di implementare l’intelligenza artificiale nel retail in tutta un’organizzazione in un solo colpo è una causa comune di fallimento. Porta a sforamenti di budget, discontinuità operativa e soluzioni che non soddisfano i bisogni degli utenti. Una roadmap incrementale e suddivisa in fasi è l’unico approccio pragmatico. Offre valore misurabile a ogni passaggio, riduce il rischio e costruisce lo slancio interno necessario per giustificare investimenti futuri. Questo approccio tratta l’implementazione dell’AI come lo sviluppo di prodotto: iniziare in piccolo, dimostrare il valore e scalare in modo sistematico.

Fase 1: costruire la base dati

Nessun modello di AI può funzionare senza dati puliti, accessibili e affidabili. Questa fase iniziale è la più critica e consiste nel costruire l’infrastruttura dati che alimenterà tutto il lavoro successivo. L’obiettivo principale è unificare le informazioni provenienti da sistemi eterogenei come POS, ERP e piattaforme di e-commerce. Ciò richiede la standardizzazione dei formati, la pulizia dei dati e la creazione di un repository centrale (ad es. un data lake o un data warehouse). Il successo non si misura dagli output dell’AI, ma dall’accessibilità e affidabilità dei dati.

Fase 2: avviare un singolo caso d’uso interno ad alto impatto

Con una base dati in atto, il passo successivo è un progetto pilota a perimetro ristretto, progettato per risolvere un problema interno specifico e ad alto impatto. Questo approccio dimostra rapidamente il valore e consente di testare l’architettura in un ambiente a basso rischio. In questa fase vanno evitati i casi d’uso rivolti ai clienti. Un ottimo candidato è uno strumento di ricerca basato su AI per i team interni di prodotto e merchandising. Ciò consente al personale di interrogare il catalogo prodotti in linguaggio naturale, riducendo drasticamente il tempo necessario per attività come trovare prodotti comparabili o costruire collezioni per campagne di marketing.

Il successo di questo pilot si misura tramite l’adozione interna e i guadagni di efficienza. Quando i product manager utilizzano lo strumento ogni giorno perché consente loro di risparmiare ore di lavoro manuale, il business case per l’AI viene validato, costruendo credibilità per la fase successiva.

Questa timeline illustra le quattro fasi, mostrando come una roadmap AI di successo progredisca dall’infrastruttura di base alla governance estesa all’intera azienda.

Come mostra la visualizzazione, ogni fase si basa sulla precedente, garantendo che la complessità venga introdotta in modo incrementale e che la governance sia un filo conduttore continuo.

Fase 3: scalare il progetto vincente e avviare un caso d’uso complementare

Una volta che il primo pilot ha dimostrato il suo valore, la Fase 3 procede su due binari: scalare la soluzione iniziale e introdurre un secondo caso d’uso complementare. La scalabilità implica irrobustire l’architettura del pilot, migliorarne le prestazioni e integrarla formalmente nei flussi di lavoro quotidiani, facendola passare da esperimento a sistema di produzione. Un secondo caso d’uso adatto è la generazione automatica di descrizioni prodotto. Affinando un LLM sul tone of voice del brand dell’azienda, il sistema può generare solide bozze iniziali di testi prodotto, liberando il team contenuti per attività più strategiche. Puoi leggere di più su altre applicazioni dell’AI nel retail sul nostro blog.

Fase 4: stabilire governance e integrazione a livello enterprise

La fase finale si concentra sulla creazione di un quadro centrale di governance dell’AI. L’obiettivo è garantire che tutti i futuri progetti AI siano costruiti in modo sicuro, etico ed economicamente efficiente, sfruttando componenti riutilizzabili e best practice. È qui che viene creato un centro di eccellenza per standardizzare gli strumenti e supervisionare la conformità.

Le attività chiave includono:

- Costruire componenti riutilizzabili: creare una libreria di modelli, API e pattern architetturali collaudati.

- Implementare un monitoraggio centralizzato: distribuire dashboard per tracciare costi, prestazioni e model drift su tutti i servizi AI.

- Formalizzare le policy di governance: documentare regole chiare per la gestione dei dati, la validazione dei modelli e i flussi human-in-the-loop per garantire la conformità a normative come GDPR e NIS2.

Il successo in questa fase si misura dalla capacità dell’organizzazione di distribuire rapidamente nuove soluzioni AI sicure ed efficaci. L’AI nel retail smette di essere una serie di progetti scollegati e diventa una capacità strategica centrale.

Modello di maturità dell’implementazione dell’AI nel retail

| Fase | Obiettivo principale | Attività chiave | Metriche di successo |

|---|---|---|---|

| 1: Fondazione | Stabilire un’infrastruttura dati pulita e accessibile. | Unificazione dei dati, creazione delle pipeline, configurazione del repository centrale. | Disponibilità dei dati, affidabilità, velocità di interrogazione. |

| 2: Pilot | Dimostrare il valore con un singolo caso d’uso interno a basso rischio. | Sviluppare e distribuire una soluzione mirata (ad es. ricerca interna). | Adozione del team, tempo risparmiato, guadagni di efficienza. |

| 3: Scalare | Scalare la prima soluzione e introdurre un secondo caso d’uso. | Rendere robusta l’architettura del pilot, distribuire un nuovo pilot (ad es. generazione contenuti). | ROI positivo sulla soluzione scalata, distribuzione riuscita del nuovo pilot. |

| 4: Enterprise | Integrare l’AI come capacità governata a livello aziendale. | Creare un centro di eccellenza, costruire componenti riutilizzabili, formalizzare la governance. | Velocità delle nuove implementazioni, efficienza dei costi, aderenza alla conformità. |

Seguendo questo approccio in fasi, trasformi l’AI da una raccolta di esperimenti isolati in un motore centrale di miglioramento continuo per l’intero business.

Misurare il ROI di business dell’AI nel retail

Un progetto AI ha successo solo se genera un impatto aziendale misurabile. Sebbene metriche tecniche come l’accuratezza del modello siano importanti per i team di engineering, la misura definitiva del successo per founder e CTO è il suo effetto sui Key Performance Indicators (KPI) di business. L’obiettivo dell’implementazione dell’intelligenza artificiale nel retail è migliorare risultati che incidono direttamente sul conto economico.

Il primo passo è stabilire una baseline di performance chiara prima di distribuire qualsiasi soluzione AI. Senza questo, è impossibile quantificare il miglioramento apportato dall’investimento.

Collegare i casi d’uso AI ai KPI di business

I KPI monitorati devono essere direttamente collegati al problema specifico che il sistema AI è stato progettato per risolvere. Una dashboard generica non è sufficiente. Bisogna concentrarsi sulle metriche che contano per ciascun caso d’uso per costruire prove chiare del ritorno finanziario.

Applicazioni AI diverse avranno misure di successo diverse:

- Ottimizzazione dell’inventario: i KPI includono il tasso di stockout (percentuale di tempo in cui un prodotto non è disponibile) e i costi di mantenimento delle scorte. L’obiettivo è ridurre entrambi.

- Personalizzazione e-commerce: il successo si misura con l’aumento del tasso di conversione, del valore medio dell’ordine (AOV) e del customer lifetime value (CLV).

- Servizio clienti basato su AI: l’attenzione è sull’efficienza operativa e sulla soddisfazione del cliente. Le metriche chiave includono il tempo medio di risposta dell’agente, il tasso di risoluzione al primo contatto e i punteggi Customer Satisfaction (CSAT).

Misurare il ROI dell’AI richiede un passaggio disciplinato dal monitoraggio delle prestazioni tecniche alla supervisione dei risultati di business. Collegando ogni iniziativa AI a una specifica metrica finanziaria o operativa, puoi costruire un caso chiaro, basato sui dati, che dimostra come l’investimento tecnologico stia creando valore tangibile.

Dalle metriche tecniche al ritorno finanziario

Una volta stabilite le baseline e monitorati i KPI corretti, i miglioramenti possono essere tradotti in un ritorno finanziario chiaro. Ad esempio, una riduzione del 5% degli stockout può essere collegata direttamente a una determinata quantità di ricavi recuperati. Analogamente, un aumento del 10% del tasso di conversione grazie a un nuovo motore di personalizzazione ha un valore monetario chiaro. Questo framework fornisce un business case solido, dimostrando che l’AI non è solo un altro progetto IT, ma un investimento strategico che contribuisce alla redditività.

Domande comuni sull’implementazione dell’AI nel retail

Quando il management pianifica i primi progetti di intelligenza artificiale nel retail, emergono costantemente alcune domande pratiche. Risposte chiare e pragmatiche sono essenziali per orientarsi tra i compromessi tecnici e di business insiti nella costruzione di sistemi AI efficaci.

Ecco le preoccupazioni più comuni che sentiamo da CTO, founder e responsabili IT.

Dovremmo sviluppare modelli personalizzati o usare API di terze parti?

Non si tratta di una decisione tra l’uno o l’altro; si tratta di selezionare lo strumento giusto per il compito specifico, tenendo conto del caso d’uso e della sensibilità dei dati. Per attività generiche come la sintesi delle descrizioni dei prodotti, un’API di un provider come OpenAI è spesso più veloce e più conveniente. Tuttavia, per funzioni specializzate che coinvolgono dati proprietari—come il rilevamento delle frodi o la previsione della domanda basata su una cronologia di vendite unica—un modello addestrato su misura crea un significativo vantaggio competitivo. Spesso una strategia ibrida è la soluzione ottimale: usare le API per le capacità generali e investire in modelli personalizzati per le funzioni aziendali fondamentali e differenzianti.

Qual è il più grande costo nascosto in un progetto di IA?

L’errore di budget più comune è sottostimare i costi che seguono lo sviluppo iniziale del modello. I maggiori costi nascosti si trovano nella gestione continua dei dati, nella manutenzione dell’infrastruttura e nella governance. Questo include la manutenzione delle pipeline di dati, l’archiviazione, il monitoraggio continuo del model drift e le risorse umane necessarie per la supervisione e i flussi di lavoro human-in-the-loop.

Concentrarsi solo sulla realizzazione iniziale senza prevedere questi costi operativi “Day 2” è una delle ragioni principali per cui i progetti di IA non riescono a generare un ROI di lungo periodo. Prevedere che le spese operative rappresentino una parte sostanziale del costo totale di proprietà.

Come garantiamo che i nostri sistemi di IA siano conformi a normative come il GDPR?

La conformità non può essere un ripensamento; deve essere progettata nell’architettura del sistema fin dall’inizio. Cercare di aggiungere in seguito funzionalità per la privacy è un punto di fallimento comune e critico.

Le principali strategie architetturali includono:

- Minimizzazione dei dati: Raccogliere ed elaborare solo i dati assolutamente essenziali per la funzione del modello.

- Anonimizzazione: Rimuovere gli identificatori personali dai dati prima che vengano utilizzati in qualsiasi processo di addestramento.

- Controlli di accesso: Implementare rigorosi controlli di accesso basati sui ruoli sia per i dati sia per i modelli.

- Cancellazione dei dati: Progettare sistemi in grado di rimuovere in modo efficace e permanente i dati per rispettare una richiesta di “Diritto all’oblio”.

In Devisia, realizziamo sistemi abilitati all’IA con un’attenzione all’architettura pragmatica, alla manutenibilità di lungo periodo e a una governance robusta. Se sei pronto a trasformare la tua visione di business in un prodotto digitale affidabile, scopri il nostro approccio su https://www.devisia.pro.